L'éditeur de Downcodes vous apporte les dernières informations technologiques ! La startup de Seattle, Moondream, a lancé moondream2, un étonnant modèle de langage visuel compact, qui fait des vagues dans l'industrie grâce à sa petite taille et ses performances puissantes. Ce modèle open source a obtenu de bons résultats lors de divers tests de référence, surpassant même ses concurrents avec des paramètres plus élevés à certains égards, ouvrant ainsi de nouvelles possibilités de reconnaissance d'image locale sur les smartphones. Examinons de plus près ce qui rend moondream2 unique et l'innovation technologique qui la sous-tend.

Récemment, Moondream, une startup de Seattle, a lancé un modèle de langage visuel compact appelé moondream2. Malgré sa petite taille, le modèle a obtenu de bons résultats lors de divers tests de référence et a attiré beaucoup d'attention. En tant que modèle open source, moondream2 promet d'activer des capacités de reconnaissance d'images locales sur les smartphones.

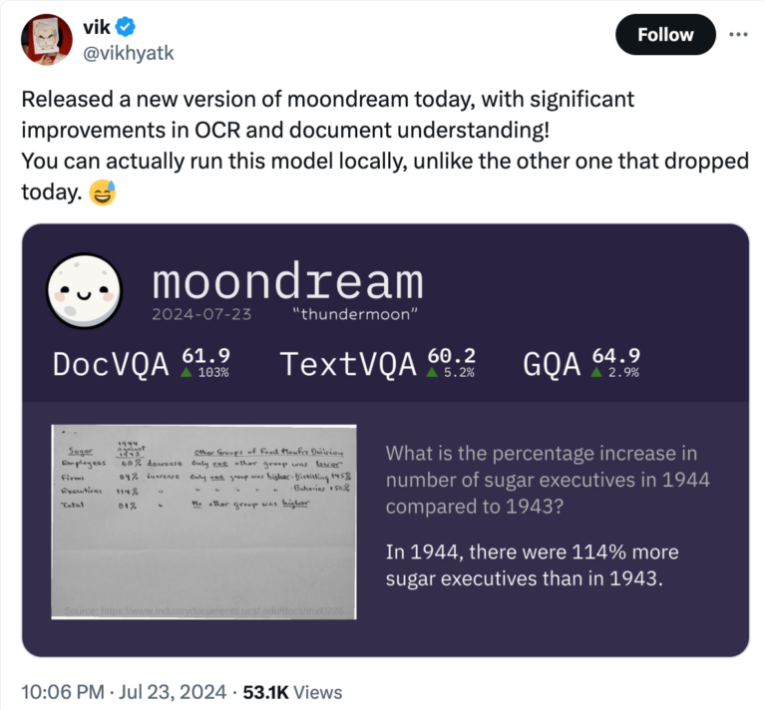

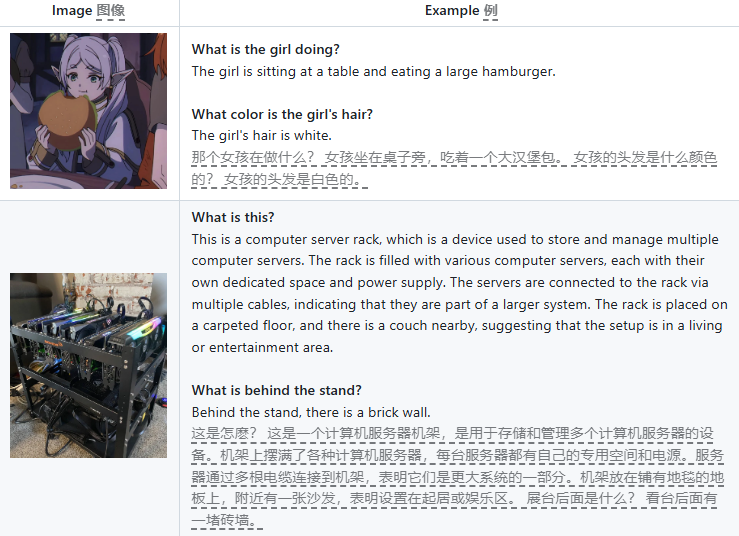

Moondream2 a été officiellement lancé en mars. Le modèle peut traiter les entrées de texte et d'image et a les capacités de répondre aux questions, d'extraction de texte (OCR), de comptage d'objets et de classification d'éléments. Depuis sa sortie, l'équipe Moondream a continué à mettre à jour le modèle, améliorant continuellement ses performances de base. La version de juillet montre des améliorations significatives dans l'OCR et la compréhension des documents, en particulier dans l'analyse des données économiques historiques. Les scores du modèle dans DocVQA, TextVQA et GQA dépassent tous 60 %, démontrant sa forte capacité lorsqu'il est exécuté localement.

Une caractéristique notable de moondream2 est sa taille compacte : il n'y a que 1,6 milliard de paramètres, ce qui lui permet de fonctionner non seulement sur des serveurs cloud, mais également sur des ordinateurs locaux et même sur certains appareils moins performants tels que les smartphones ou les ordinateurs monocarte.

Malgré sa petite taille, ses performances sont comparables à celles de certains modèles concurrents avec des milliards de paramètres, et surpassent même ces modèles plus grands sur certains benchmarks.

Dans une comparaison des modèles de langage visuel des appareils mobiles, les chercheurs ont souligné que bien que moondream2 ne dispose que de 170 millions de paramètres, ses performances sont équivalentes à celles d'un modèle de 700 millions de paramètres et que ses performances ne sont que légèrement inférieures à l'ensemble de données SQA. Cela montre que même si les petits modèles fonctionnent bien, ils ont encore du mal à comprendre des contextes spécifiques.

Vikhyat Korrapati, le développeur du modèle, a déclaré que moondream2 est construit sur d'autres modèles tels que SigLIP, les ensembles de données de formation Phi-1.5 et LLaVA de Microsoft. Le modèle open source est désormais disponible en téléchargement gratuit sur GitHub, avec une version de démonstration présentée sur Hugging Face. Sur la plateforme de codage, moondream2 a également attiré l'attention de la communauté des développeurs, recevant plus de 5 000 avis étoiles.

Le succès a attiré les investisseurs : Moondream a levé 4,5 millions de dollars lors d'un tour de table mené par Felicis Ventures, le fonds M12GitHub de Microsoft et Ascend. Le PDG de l'entreprise, Jay Allen, travaille chez Amazon Web Services (AWS) depuis de nombreuses années et dirige la startup en pleine croissance.

Le lancement de moondream2 marque la naissance d'une série de modèles open source optimisés par des professionnels qui nécessitent moins de ressources tout en offrant des performances similaires à celles des modèles plus grands et plus anciens. Même s'il existe quelques petits modèles locaux sur le marché, comme l'assistant intelligent d'Apple ou le Gemini Nano de Google, ces deux constructeurs externalisent toujours des tâches plus complexes vers le cloud.

visage câlin :https://huggingface.co/vikhyatk/moondream2

github :https://github.com/vikhyat/moondream

L’émergence de moondream2 annonce le développement vigoureux de modèles d’IA légers, offrant de nouvelles possibilités pour les applications d’IA localisées. Sa nature open source favorise également la participation active de la communauté des développeurs et insuffle une nouvelle vitalité au développement de la technologie de l’IA. Nous attendons avec impatience d’autres innovations similaires à l’avenir !