Les chercheurs de Meta AI ont proposé une méthode sans formation appelée AdaCache, conçue pour accélérer la vitesse d'inférence des modèles Transformer (DiT) de diffusion vidéo. DiTs fonctionne bien dans le domaine de la génération vidéo, mais sa grande taille de modèle et son mécanisme d'attention complexe conduisent à une vitesse d'inférence lente, limitant son application. AdaCache profite intelligemment du fait que « toutes les vidéos ne sont pas identiques » en mettant en cache les résultats des calculs et en personnalisant la stratégie de mise en cache pour chaque vidéo, améliorant ainsi considérablement l'efficacité de l'inférence tout en garantissant la qualité de la génération. L’éditeur de Downcodes vous expliquera cette technologie en détail.

La génération de vidéos continues de haute qualité nécessite des ressources informatiques importantes, en particulier sur des périodes plus longues. Bien que les derniers modèles de transformateurs de diffusion (DiT) aient fait des progrès significatifs dans la génération vidéo, ce défi est exacerbé par une inférence plus lente en raison de leur dépendance à l'égard de modèles plus grands et de mécanismes d'attention plus complexes. Pour résoudre ce problème, les chercheurs de Meta AI ont proposé une méthode sans formation appelée AdaCache pour accélérer les DiT vidéo.

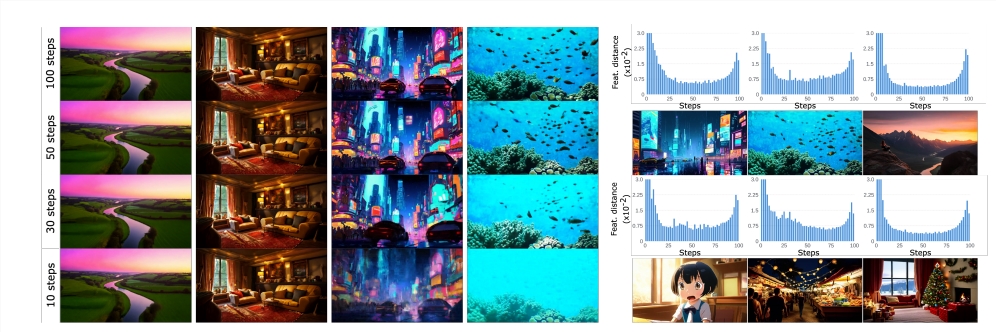

L'idée centrale d'AdaCache repose sur le fait que « toutes les vidéos ne sont pas identiques », ce qui signifie que certaines vidéos nécessitent moins d'étapes de débruitage que d'autres pour obtenir une qualité raisonnable. Sur cette base, cette méthode met non seulement en cache les résultats des calculs pendant le processus de diffusion, mais conçoit également une stratégie de mise en cache personnalisée pour chaque génération vidéo, maximisant ainsi le compromis entre qualité et latence.

Les chercheurs ont en outre introduit un système de régularisation de mouvement (MoReg), qui utilise les informations vidéo dans AdaCache pour contrôler l'allocation des ressources informatiques en fonction du contenu du mouvement. Étant donné que les séquences vidéo contenant des textures haute fréquence et de grandes quantités de contenu animé nécessitent davantage d’étapes de diffusion pour obtenir une qualité raisonnable, MoReg peut mieux allouer les ressources informatiques.

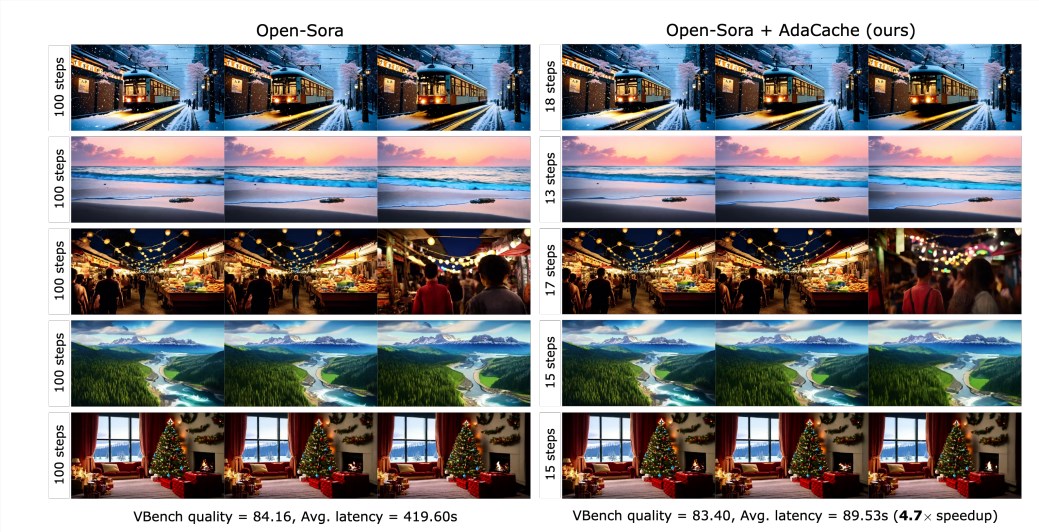

Les résultats expérimentaux montrent qu'AdaCache peut améliorer considérablement la vitesse d'inférence (par exemple, jusqu'à 4,7 fois plus rapide dans la génération vidéo Open-Sora720p-2s) sans sacrifier la qualité de la génération. De plus, AdaCache possède également une bonne capacité de généralisation et peut être appliqué à différents modèles de DiT vidéo, tels que Open-Sora, Open-Sora-Plan et Latte. AdaCache offre des avantages significatifs en termes de vitesse et de qualité par rapport à d'autres méthodes d'accélération sans formation telles que Δ-DiT, T-GATE et PAB.

Les études réalisées auprès des utilisateurs montrent que les utilisateurs préfèrent les vidéos générées par AdaCache aux autres méthodes et considèrent que leur qualité est comparable aux modèles de base. Cette étude confirme l'efficacité d'AdaCache et apporte une contribution importante au domaine de la génération vidéo efficace. Meta AI estime qu'AdaCache peut être largement utilisé et promouvoir la vulgarisation de la génération de vidéos longues haute fidélité.

Article : https://arxiv.org/abs/2411.02397

Page d'accueil du projet :

https://adacache-dit.github.io/

GitHub :

https://github.com/AdaCache-DiT/AdaCache

Dans l'ensemble, AdaCache fournit une méthode nouvelle et efficace pour une génération vidéo efficace, et son amélioration significative des performances et sa bonne expérience utilisateur la rendent très potentielle pour de futures applications. L'éditeur de Downcodes estime que l'émergence d'AdaCache favorisera le développement ultérieur de la génération de vidéos longues haute fidélité.