L'éditeur de Downcodes rapporte : L'équipe technique de Zhipu a publié aujourd'hui un modèle majeur de génération vidéo open source CogVideoX v1.5, qui est une autre mise à niveau majeure de la série depuis août. La nouvelle version a fait une percée significative dans les capacités de génération vidéo, prenant en charge des vidéos plus longues, des résolutions plus élevées et des fréquences d'images plus fluides, et combinée avec le modèle d'effet sonore CogSound récemment lancé pour créer une « nouvelle plate-forme vidéo claire » pour offrir aux utilisateurs une meilleure vidéo Premium. expérience de création. Cette mise à jour améliore non seulement la qualité vidéo, mais renforce également la capacité du modèle à comprendre une sémantique complexe, offrant ainsi aux développeurs des outils plus puissants.

Il est entendu que cette mise à jour a considérablement amélioré les capacités de génération vidéo, notamment en prenant en charge des durées vidéo de 5 et 10 secondes, une résolution 768P et des capacités de génération de 16 images. Dans le même temps, le modèle I2V (image vers vidéo) prend également en charge n'importe quel rapport de taille, améliorant encore la capacité à comprendre une sémantique complexe.

CogVideoX v1.5 contient deux modèles principaux : CogVideoX v1.5-5B et CogVideoX v1.5-5B-I2V, conçus pour fournir aux développeurs des outils de génération vidéo plus puissants.

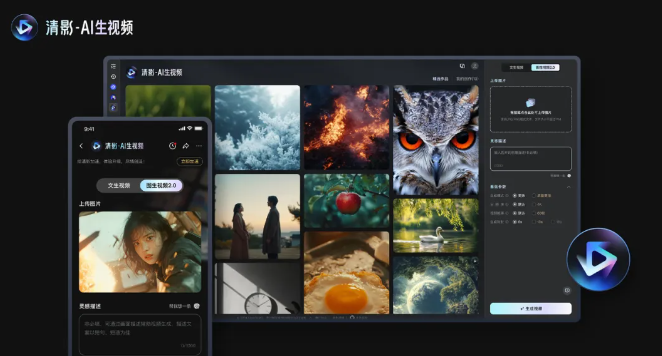

Ce qui est encore plus remarquable, c'est que CogVideoX v1.5 sera lancé simultanément sur la plate-forme Qingying et combiné avec le nouveau modèle d'effets sonores CogSound pour devenir le « Nouveau Qingying » . New Qingying fournira un certain nombre de services spéciaux, notamment des améliorations significatives de la qualité vidéo, des performances esthétiques et de la rationalité des mouvements, et prendra en charge la génération de vidéos ultra haute définition 4K de 10 secondes, de 60 images.

L'introduction officielle est la suivante :

Amélioration de la qualité : la capacité des vidéos Tusheng en termes de qualité, de performances esthétiques, de rationalité du mouvement et de compréhension sémantique de mots d'invite complexes a été considérablement améliorée.

Résolution Ultra-HD : prend en charge la génération de vidéos ultra haute définition de 10 s, 4K et 60 images.

Rapport variable : prend en charge n'importe quel rapport pour s'adapter à différents scénarios de lecture.

Sortie multicanal : la même commande/image peut générer 4 vidéos en même temps.

Vidéo AI avec effets sonores : Xinqingying peut générer des effets sonores qui correspondent à l'image.

En termes de traitement des données, l'équipe CogVideoX se concentre sur l'amélioration de la qualité des données, le développement d'un cadre de filtrage automatisé pour filtrer les mauvaises données vidéo et le lancement du modèle de compréhension vidéo de bout en bout CogVLM2-caption pour générer des descriptions de contenu précises. Ce modèle peut gérer efficacement des instructions complexes et garantir que la vidéo générée correspond aux besoins de l'utilisateur.

Afin d'améliorer la cohérence du contenu, CogVideoX utilise une technologie efficace d'encodeur automatique variationnel tridimensionnel (VAE 3D), qui réduit considérablement les coûts et les difficultés de formation. En outre, l'équipe a également développé une architecture Transformer qui intègre les trois dimensions du texte, du temps et de l'espace. En supprimant le module d'attention croisée traditionnel, l'effet interactif du texte et de la vidéo est amélioré et la qualité de la génération vidéo est améliorée.

À l'avenir, l'équipe technique de Zhipu continuera d'augmenter la quantité de données et l'échelle des modèles, et d'explorer une architecture de modèles plus efficace pour obtenir une meilleure expérience de génération vidéo. L'open source de CogVideoX v1.5 fournit non seulement aux développeurs des outils puissants, mais injecte également une nouvelle vitalité dans le domaine de la création vidéo.

Code : https://github.com/thudm/cogvideo

Modèle : https://huggingface.co/THUDM/CogVideoX1.5-5B-SAT

Souligner:

La nouvelle version de CogVideoX v1.5 est open source et prend en charge la vidéo 5/10 seconde, la résolution 768P et les capacités de génération de 16 images.

La nouvelle plate-forme Qingying est lancée, combinée au modèle d'effets sonores CogSound, pour fournir une génération vidéo 4K ultra haute définition.

Le traitement des données et l’innovation algorithmique garantissent la qualité et la cohérence des vidéos générées.

Dans l'ensemble, l'open source de CogVideoX v1.5 et le lancement de la nouvelle plateforme Qingying marquent une étape importante dans la technologie de génération vidéo IA, apportant des outils plus puissants et un espace créatif plus large aux développeurs et créateurs. Nous sommes impatients de voir des applications plus intéressantes basées sur CogVideoX à l'avenir.