2024/10/21 : Mini-InternVLシリーズを発売しました。これらのモデルは、最小限のサイズで優れたパフォーマンスを実現します。4B モデルは、わずか 5% のモデル サイズで 90% のパフォーマンスを達成します。詳細については、プロジェクトページとドキュメントをご確認ください。

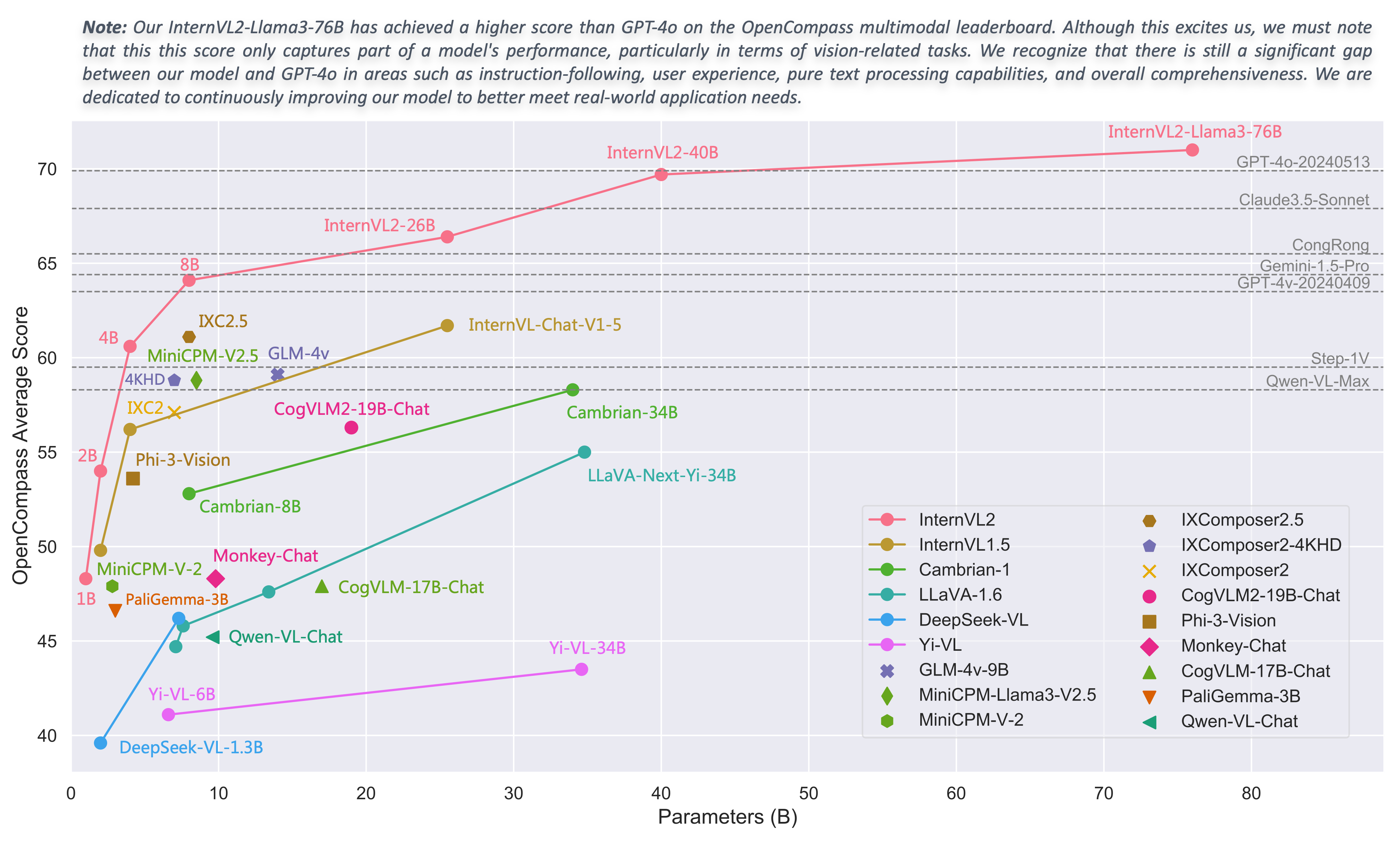

2024/08/01 : Chartmimic チームは、InternVL2 シリーズ モデルをベンチマークで評価しました。 InternVL2-26B および 76B モデルは、オープンソース モデルの中でトップ 2 のパフォーマンスを達成し、InternVL2 76B モデルは GeminiProVision を上回り、Claude-3-opus に匹敵する結果を示しました。

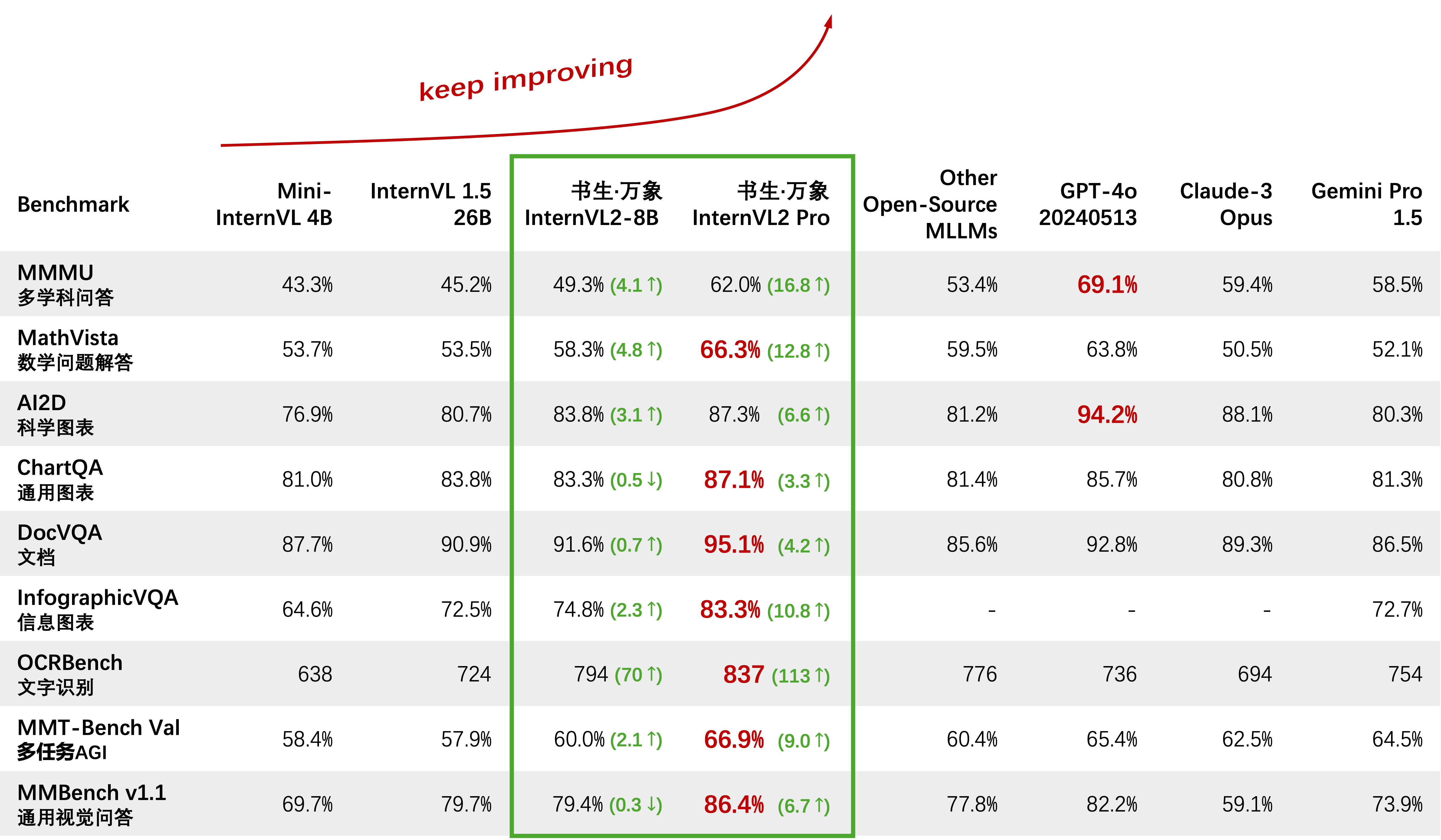

2024/08/01 : InternVL2-Pro は、CharXiv データセット上のオープンソース モデルの中で SOTA パフォーマンスを達成し、GPT-4V、Gemini 1.5 Flash、Claude 3 Sonnet などの多くのクローズドソース モデルを上回りました。

2024/07/24 : MLVU チームはベンチマークで InternVL-1.5 を評価しました。多肢選択タスクの平均パフォーマンスは 50.4% でしたが、生成タスクのパフォーマンスは 4.02 でした。多肢選択タスクのパフォーマンスは、すべてのオープンソース MLLM の中で 1 位にランクされました。

2024/07/18 : ?? InternVL2-40B は、Video-MME データセット上のオープンソース モデルの中で SOTA パフォーマンスを達成し、16 フレーム入力時に 61.2、32 フレーム入力時に 64.4 のスコアを獲得しました。他のオープンソース モデルを大幅に上回り、GPT-4o mini に最も近いオープンソース モデルです。

2024/07/18 : ? InternVL2-Pro は、DocVQA および InfoVQA ベンチマークで SOTA パフォーマンスを達成しました。

2024/07/04 : ? InternVL2シリーズを発売いたします。 InternVL2-Pro は、MMMU ベンチマークで 62.0% の精度を達成し、GPT-4o などの主要なクローズドソース商用モデルのパフォーマンスに匹敵します。本モデルの無料APIは、(申込フォーム)/(申込表)よりお申込みいただけます。他のモデルは HF リンクで入手できます。

2024/06/19 : 私たちは、既存の MLLM の長いマルチモーダル文書を理解する能力を体系的に評価するために設計された最初のベンチマークである Needle In A Multimodal Haystack (MM-NIAH) を提案します。

2024/05/30 : ShareGPT-4o をリリースします。ShareGPT-4o は、200K 画像、10K ビデオ、10K オーディオを詳細な説明とともにオープンソース化する予定の大規模データセットです。

2024/05/28 : AWQ 量子化サポートを提供してくれた lmdeploy チームに感謝します。 4 ビット モデルは、OpenGVLab/InternVL-Chat-V1-5-AWQ で入手できます。

2024/05/13 : InternVL 1.0 を拡散モデルのテキスト エンコーダとして使用できるようになり、世界中の 110 以上の言語でネイティブに多言語生成をサポートします。詳細については「ムーラン」を参照してください。

2024/04/18 : InternVL-Chat-V1-5 が HF リンクでリリースされ、MMMU、DocVQA、ChartQA、MathVista などのさまざまなベンチマークで GPT-4V および Gemini Pro のパフォーマンスに近づいています。

2024/02/27 : InternVL が CVPR 2024 (口頭) に採択されました! ?

2024/02/21 : InternVL-Chat-V1-2-Plus は、MathVista (59.9)、MMBench (83.8)、および MMVP (58.7) で SOTA パフォーマンスを達成しました。詳細については、ブログをご覧ください。

2024/02/12 : InternVL-Chat-V1-2 をリリースしました。 MMMU val では 51.6、MMBench テストでは 82.3 を達成しています。詳細については、ブログと SFT データを参照してください。このモデルは現在 HuggingFace で利用可能であり、トレーニング/評価データとスクリプトの両方がオープンソースです。

2024/01/24 : InternVL-Chat-V1-1 がリリースされました。中国語をサポートし、より強力な OCR 機能を備えています。こちらを参照してください。

2024/01/16 : 大規模な検出およびセグメンテーション モデルのトレーニングに使用できる、DeepSpeed と統合された、カスタマイズされた mmcv/mmsegmentation/mmdetection コードをリリースします。

vLLM と Ollama をサポート

readthedocs を使用してドキュメントを再構築する

LoRA によるさまざまな LLM の微調整のサポート

オンラインデモでビデオとPDFの入力をサポート

VisionLLMv2 統合を備えた InternVL2 をリリース

InternVL2 のリリースrequirements.txt

InternVL2シリーズのトレーニング・評価コードを公開

InternVL1.5 および InternVL2 用の Streamlit Web UI をリリース

始めましょう

インストール: [環境] [requirements.txt]

評価データ作成:【InternVL評価】

チャットデータ形式: [メタファイル] [ピュアテキスト] [単一画像] [複数画像] [ビデオ]

InternVL-チャット API: [InternVL2-Pro]

ローカル チャット デモ: [Streamlit デモ] [Gradio デモ] [LMDeploy デモ]

チュートリアル: [LoRA 微調整を使用した COCO キャプションの InternVL2 の強化]

InternVL ファミリー

InternVL 2.0: [概要] [クイック スタート] [微調整] [評価] [展開]

InternVL 1.5: [概要] [クイック スタート] [微調整] [評価] [展開]

InternVL 1.2: [概要] [クイック スタート] [微調整] [評価]

InternVL 1.1: [概要] [クイック スタート] [評価]

InternVL 1.0: [分類] [CLIP-Benchmark] [セグメンテーション] [InternVL-Chat-LLaVA] [InternVL-G]

| モデル名 | ビジョンパート | 言語パート | HFリンク | MSリンク | 書類 |

|---|---|---|---|---|---|

| インターンVL2‑1B | InterViT‑300M‑448ピクセル | Qwen2‑0.5B‑命令 | ?リンク | ?リンク | ?博士 |

| インターンVL2‑2B | InterViT‑300M‑448ピクセル | インターンlm2‑チャット‑1‑8b | ?リンク | ?リンク | ?博士 |

| インターンVL2‑4B | InterViT‑300M‑448ピクセル | Phi-3-mini-128k-命令 | ?リンク | ?リンク | ?博士 |

| インターンVL2‑8B | InterViT‑300M‑448ピクセル | インターンlm2_5‑7b‑チャット | ?リンク | ?リンク | ?博士 |

| インターンVL2‑26B | InterViT‑6B‑448px‑V1‑5 | internlm2‑チャット‑20b | ?リンク | ?リンク | ?博士 |

| インターンVL2‑40B | InterViT‑6B‑448px‑V1‑5 | ヌース‑エルメス‑2‑イ‑34B | ?リンク | ?リンク | ?博士 |

| インターンVL2-ラマ3-76B | InterViT‑6B‑448px‑V1‑5 | エルメス‑2‑シータ‑ ラマ-3-70B | ?リンク | ?リンク | ?博士 |

皆様が研究のために当社の API を使用することを歓迎します。より良い管理を行うために、(申請書) / (申請書) を送信して、無料の API アクセスを取得してください。

| モデル | 日付 | HFリンク | MSリンク | 注記 |

|---|---|---|---|---|

| ミニインターンVL‑チャット‑4B‑V1‑5 | 2024.05.28 | ?リンク | ?リンク | ??モデルサイズの 16%、パフォーマンスの 90% |

| ミニインターンVL‑チャット‑2B‑V1‑5 | 2024.05.19 | ?リンク | ?リンク | ?モデル サイズの 8%、パフォーマンスの 80% |

| インターンVL‑チャット‑V1‑5 | 2024.04.18 | ?リンク | ?リンク | 4K画像をサポートします。超強力な OCR; MMMU、DocVQA、ChartQA、MathVista などのさまざまなベンチマークにおける GPT-4V と Gemini Pro のパフォーマンスにアプローチします。 |

| インターンVL‑Chat‑V1‑2‑Plus | 2024.02.21 | ?リンク | ?リンク | より多くのSFTデータとより強力な |

| インターンVL‑チャット‑V1‑2 | 2024.02.11 | ?リンク | ?リンク | LLM を 34B にスケールアップ |

| インターンVL‑チャット‑V1‑1 | 2024.01.24 | ?リンク | ?リンク | 中国語と強力な OCR をサポート |

| インターンVL‑チャット‑19B | 2023.12.25 | ?リンク | ?リンク | 英語のマルチモーダルな対話 |

| インターンVL‑チャット‑13B | 2023.12.25 | ?リンク | ?リンク | 英語のマルチモーダルな対話 |

| モデル | 日付 | HFリンク | MSリンク | 注記 |

|---|---|---|---|---|

| InterViT‑300M‑448ピクセル | 2024.05.25 | ?リンク | ?リンク | 300M パラメータを備えた蒸留された小型ビジョン基礎モデル (?新規) |

| InterViT‑6B‑448px‑V1‑5 | 2024.04.20 | ?リンク | ?リンク | インクリメンタル事前トレーニングによる動的解像度と非常に強力な OCR 特徴抽出機能をサポート (?新規) |

| InterViT‑6B‑448px‑V1‑2 | 2024.02.11 | ?リンク | ?リンク | インクリメンタル事前トレーニングによる 448 解像度のサポート |

| InterViT‑6B‑448px‑V1‑0 | 2024.01.30 | ?リンク | ?リンク | インクリメンタル事前トレーニングによる 448 解像度のサポート |

| InternViT‑6B‑224px | 2023.12.22 | ?リンク | ?リンク | InternVL‑14B‑224px から抽出された InternViT-6B の最初のバージョン |

| モデル | 日付 | HFリンク | MSリンク | 注記 |

|---|---|---|---|---|

| インターンVL-14B-224px | 2023.12.22 | ?リンク | ?リンク | ビジョン言語基盤モデル、InternViT-6B + QLLaMA は、CLIP のような画像テキスト検索に使用できます |

リニアプローブ画像分類 [詳細を参照]

ViT-22B はプライベート JFT-3B データセットを使用します。

| 方法 | #パラメータ | IN-1K | インリアル | IN-V2 | IN-A | インアール | インスケッチ |

|---|---|---|---|---|---|---|---|

| OpenCLIP-G | 1.8B | 86.2 | 89.4 | 77.2 | 63.8 | 87.8 | 66.4 |

| DINOv2-g | 1.1B | 86.5 | 89.6 | 78.4 | 75.9 | 78.8 | 62.5 |

| EVA-01-CLIP-g | 1.1B | 86.5 | 89.3 | 77.4 | 70.5 | 87.7 | 63.1 |

| MAWS-ViT-6.5B | 6.5B | 87.8 | - | - | - | - | - |

| ViT-22B* | 21.7B | 89.5 | 90.9 | 83.2 | 83.8 | 87.4 | - |

| InterViT-6B(当社製) | 5.9B | 88.2 | 90.4 | 79.9 | 77.5 | 89.8 | 69.1 |

セマンティック セグメンテーション [詳細を参照]

| 方法 | デコーダ | #param (トレイン/合計) | 作物のサイズ | ミオ |

|---|---|---|---|---|

| OpenCLIP-G (凍結) | リニア | 0.3M / 1.8B | 512 | 39.3 |

| ViT-22B(冷凍) | リニア | 0.9M / 21.7B | 504 | 34.6 |

| InternViT-6B (冷凍) | リニア | 0.5M / 5.9B | 504 | 47.2 (+12.6) |

| ViT-22B(冷凍) | アッパーネット | 0.8B / 22.5B | 504 | 52.7 |

| InternViT-6B (冷凍) | アッパーネット | 0.4B / 6.3B | 504 | 54.9 (+2.2) |

| ViT-22B | アッパーネット | 22.5B / 22.5B | 504 | 55.3 |

| インターンヴィット-6B | アッパーネット | 6.3B / 6.3B | 504 | 58.9 (+3.6) |

ゼロショット画像分類 [詳細を見る]

| 方法 | IN-1K | IN-A | インアール | IN-V2 | インスケッチ | オブジェクトネット |

|---|---|---|---|---|---|---|

| OpenCLIP-G | 80.1 | 69.3 | 92.1 | 73.6 | 68.9 | 73.0 |

| エヴァ-02-クリップ-E+ | 82.0 | 82.1 | 94.5 | 75.7 | 71.6 | 79.6 |

| ViT-22B* | 85.9 | 90.1 | 96.0 | 80.9 | - | 87.6 |

| InternVL-C (弊社) | 83.2 | 83.8 | 95.5 | 77.3 | 73.9 | 80.6 |

多言語ゼロショット画像分類 [詳細を見る]

EN:英語、ZH:中国語、JP:日本語、Ar:アラビア語、IT:イタリア語

| 方法 | IN-1K (英語) | IN-1K(ZH) | IN-1K (日本) | IN-1K(AR) | IN-1K (IT) |

|---|---|---|---|---|---|

| Taiyi-CLIP-ViT-H | - | 54.4 | - | - | - |

| WuKong-ViT-LG | - | 57.5 | - | - | - |

| CN-クリップ-ViT-H | - | 59.6 | - | - | - |

| AltCLIP-ViT-L | 74.5 | 59.6 | - | - | - |

| エヴァ-02-クリップ-E+ | 82.0 | - | - | - | 41.2 |

| OpenCLIP-XLM-RH | 77.0 | 55.7 | 53.1 | 37.0 | 56.8 |

| InternVL-C (弊社) | 83.2 | 64.5 | 61.5 | 44.9 | 65.7 |

ゼロショットビデオ分類

| 方法 | #フレーム | K400 | K600 | K700 |

|---|---|---|---|---|

| OpenCLIP-G | 1 | 65.9 | 66.1 | 59.2 |

| エヴァ-02-クリップ-E+ | 1 | 69.8 | 69.3 | 63.4 |

| InternVL-C (弊社) | 1 | 71.0 | 71.3 | 65.7 |

| ViCLIP | 8 | 75.7 | 73.5 | 66.4 |

| InternVL-C (弊社) | 8 | 79.4 | 78.8 | 71.5 |

英語ゼロショット画像テキスト検索 [詳細を見る]

| モデル | Flickr30K | ココ | 平均 | ||||||||||

| 画像からテキストへ | テキストから画像へ | 画像からテキストへ | テキストから画像へ | ||||||||||

| R@1 | R@5 | R@10 | R@1 | R@5 | R@10 | R@1 | R@5 | R@10 | R@1 | R@5 | R@10 | ||

| OpenCLIP-G | 92.9 | 99.3 | 99.8 | 79.5 | 95.0 | 97.1 | 67.3 | 86.9 | 92.6 | 51.4 | 74.9 | 83.0 | 85.0 |

| エヴァ-02-クリップ-E+ | 93.9 | 99.4 | 99.8 | 78.8 | 94.2 | 96.8 | 68.8 | 87.8 | 92.8 | 51.1 | 75.0 | 82.7 | 85.1 |

| エヴァクリップ-8B | 95.6 | 99.6 | 99.9 | 80.8 | 95.5 | 97.6 | 70.3 | 89.3 | 93.9 | 53.0 | 76.0 | 83.4 | 86.2 |

| InternVL-C (弊社) | 94.7 | 99.6 | 99.9 | 81.7 | 96.0 | 98.2 | 70.6 | 89.0 | 93.5 | 54.1 | 77.3 | 84.6 | 86.6 |

| InternVL-G(当社) | 95.7 | 99.7 | 99.9 | 85.0 | 97.0 | 98.6 | 74.9 | 91.3 | 95.2 | 58.6 | 81.3 | 88.0 | 88.8 |

中国語ゼロショット画像テキスト検索 [詳細を見る]

| モデル | Flickr30K-CN | ココCN | 平均 | ||||||||||

| 画像からテキストへ | テキストから画像へ | 画像からテキストへ | テキストから画像へ | ||||||||||

| R@1 | R@5 | R@10 | R@1 | R@5 | R@10 | R@1 | R@5 | R@10 | R@1 | R@5 | R@10 | ||

| CN-クリップ-ViT-H | 81.6 | 97.5 | 98.8 | 71.2 | 91.4 | 95.5 | 63.0 | 86.6 | 92.9 | 69.2 | 89.9 | 96.1 | 86.1 |

| OpenCLIP-XLM-RH | 86.1 | 97.5 | 99.2 | 71.0 | 90.5 | 94.9 | 70.0 | 91.5 | 97.0 | 66.1 | 90.8 | 96.0 | 87.6 |

| InternVL-C (弊社) | 90.3 | 98.8 | 99.7 | 75.1 | 92.9 | 96.4 | 68.8 | 92.0 | 96.7 | 68.9 | 91.9 | 96.5 | 89.0 |

| InternVL-G(当社) | 92.9 | 99.4 | 99.8 | 77.7 | 94.8 | 97.3 | 71.4 | 93.9 | 97.7 | 73.8 | 94.4 | 98.1 | 90.9 |

XTD での多言語ゼロショット画像テキスト検索 [詳細を参照]

| 方法 | JP | ES | フランス | ZH | それ | KO | RU | 日本 | 平均 |

|---|---|---|---|---|---|---|---|---|---|

| AltCLIP | 95.4 | 94.1 | 92.9 | 95.1 | 94.2 | 94.4 | 91.8 | 91.7 | 93.7 |

| OpenCLIP-XLM-RH | 97.3 | 96.1 | 94.5 | 94.7 | 96.0 | 90.2 | 93.9 | 94.0 | 94.6 |

| InternVL-C (弊社) | 97.3 | 95.7 | 95.1 | 95.6 | 96.0 | 92.2 | 93.3 | 95.5 | 95.1 |

| InternVL-G(当社) | 98.6 | 97.7 | 96.5 | 96.7 | 96.9 | 95.1 | 94.8 | 96.1 | 96.6 |

「SOTA VLLM との比較」セクションを参照してください。

import torchfrom PIL import Imagefrom トランスフォーマー import AutoModel, CLIPImageProcessormodel = AutoModel.from_pretrained('OpenGVLab/InternViT-6B-448px-V1-5',torch_dtype=torch.bfloat16,low_cpu_mem_usage=True,trust_remote_code=True).cuda().eval( )画像 = Image.open('./examples/image1.jpg').convert('RGB')image_processor = CLIPImageProcessor.from_pretrained('OpenGVLab/InternViT-6B-448px-V1-5')pixel_values = image_processor(images=image, return_tensors ='pt').pixel_valuespixel_values =ピクセル値.to(torch.bfloat16).cuda()出力 = モデル(ピクセル値) import torchfrom PIL import Imagefrom トランスフォーマー import AutoModel、CLIPImageProcessorfrom トランスフォーマー import AutoTokenizermodel = AutoModel.from_pretrained('OpenGVLab/InternVL-14B-224px',torch_dtype=torch.bfloat16,low_cpu_mem_usage=True,trust_remote_code=True).cuda().eval()画像プロセッサ = CLIPImageProcessor.from_pretrained('OpenGVLab/InternVL-14B-224px')tokenizer = AutoTokenizer.from_pretrained('OpenGVLab/InternVL-14B-224px', use_fast=False, add_eos_token=True)tokenizer.pad_token_id = 0 # Pad_token_id を 0images に設定 = [Image.open('./examples/image1.jpg').convert('RGB'),Image.open('./examples/image2.jpg').convert('RGB'),Image.open(' ./examples/image3.jpg').convert('RGB')

]prefix = 'summarize:'texts = [prefix + 'レッサーパンダの写真', # Englishprefix + '一张熊猫的照写真', # Chineseprefix + '二匹の猫の写真' # Japanese]pixel_values = image_processor(画像=画像、return_tensors='pt').pixel_valuespixel_values = xel_values.to(torch.bfloat16).cuda()input_ids = tokenizer(texts, return_tensors='pt', max_length=80, truncation=True, padding='max_length').input_ids.cuda()# InternVL-Clogits_per_image, logits_per_text = モデル(画像=ピクセル値、テキスト=入力ID、 mode='InternVL-C')probs = logits_per_image.softmax(dim=-1)# tensor([[9.9609e-01, 5.2185e-03, 6.0070e-08],# [2.2949e-02, 9.7656e- 01、5.9903e-06]、# [3.2932e-06, 7.4863e-05, 1.0000e+00]], device='cuda:0',# dtype=torch.bfloat16, grad_fn=<SoftmaxBackward0>)# InternVL-Glogits_per_image, logits_per_text = model(image=ピクセル値、テキスト=入力ID、 mode='InternVL-G')probs = logits_per_image.softmax(dim=-1)# tensor([[9.9609e-01, 3.1738e-03, 3.6322e-08],# [8.6060e-03, 9.9219e- 01、2.8759e-06]、# [1.7583e-06, 3.1233e-05, 1.0000e+00]], device='cuda:0',# dtype=torch.bfloat16, grad_fn=<SoftmaxBackward0>)# Generationtokenizer.add_eos_token = に対して add_eos_token を False に設定してください。偽像 = Image.open('./examples/image1.jpg').convert('RGB')pixel_values = image_processor(images=image, return_tensors='pt').pixel_valuespixel_values =Pixel_values.to(torch.bfloat16).cuda() tokenized = tokenizer("英語キャプション:", return_tensors='pt')pred = model.generate(pixel_values=pixel_values,input_ids=tokenized.input_ids.cuda(),attention_mask=tokenized.attention_mask.cuda(),num_beams=5,min_new_tokens=8,

)caption = tokenizer.decode(pred[0].cpu(), Skip_special_tokens=True).strip()# 英語キャプション: 木の台の上に座っているレッサーパンダここでは、より小さいOpenGVLab/InternVL2-8B例として取り上げます。

import numpy as npimport torchimport torchvision.transforms as Tfrom Decord import VideoReader, cpufrom PIL import Imagefrom torchvision.transforms.function import InterpolationModefrom トランスフォーマー import AutoModel, AutoTokenizerIMAGENET_MEAN = (0.485, 0.456, 0.406)IMAGENET_STD = (0.229, 0.224, 0.225)def build_transform(input_size):MEAN, STD = IMAGENET_MEAN, IMAGENET_STDtransform = T.Compose([T.Lambda(lambda img: img.convert('RGB') if img.mode != 'RGB' else img),T .Resize((入力サイズ, 入力サイズ), interpolation=InterpolationMode.BICUBIC)、T.ToTensor()、T.Normalize(mean=MEAN、std=STD)

])return transformdef find_closest_aspect_ratio(aspect_ratio, target_ratios, width, height, image_size):best_ratio_diff = float('inf')best_ratio = (1, 1)area = width * heightfor rate in target_ratios:target_aspect_ratio = rate[0] / rate[ 1]ratio_diff = abs(アスペクト比 - target_aspect_ratio)if rate_diff < best_ratio_diff:best_ratio_diff = rate_diffbest_ratio = rateelif rate_diff == best_ratio_diff:if area > 0.5 * image_size * image_size * rate[0] * rate[1]:best_ratio = ratereturn best_ratiodef Dynamic_preprocess(image, min_num=1, max_num= 12、 image_size=448, use_thumbnail=False):orig_width, orig_height = image.sizeaspect_ratio = orig_width / orig_height# 既存の画像のアスペクト比を計算するtarget_ratios = set(

(i, j) for n in range(min_num, max_num + 1) for i in range(1, n + 1) for j in range(1, n + 1) ifi * j <= max_num および i * j >= min_num)target_ratios =sorted(target_ratios, key=lambda x: x[0] * x[1])# targettarget_aspect_ratio = に最も近いアスペクト比を見つけますfind_closest_aspect_ratio(aspect_ratio, target_ratios, orig_width, orig_height, image_size)# ターゲットの幅と高さを計算しますtarget_width = image_size * target_aspect_ratio[0]target_height = image_size * target_aspect_ratio[1]blocks = target_aspect_ratio[0] * target_aspect_ratio[1]# サイズを変更しますimageresize_img = image.resize((target_width, target_height))processed_images = [] for i in range(blocks):box = (

(i % (target_width // image_size)) * image_size,

(i // (target_width // image_size)) * image_size,

((i % (target_width // image_size)) + 1) * image_size,

((i // (target_width // image_size)) + 1) * image_size)# 画像を分割plit_img = resize_img.crop(box)processed_images.append(split_img)assert <sp