論文「T2M-GPT: Generating Human Motion from Textual descriptions with Discrete Representations」の Pytorch 実装

[プロジェクトページ] [論文] [ノートブックデモ] [HuggingFace] [宇宙デモ] [T2M-GPT+]

私たちのプロジェクトがあなたの研究に役立つ場合は、引用することを検討してください:

@inproceedings{zhang2023generating,

title={T2M-GPT: Generating Human Motion from Textual Descriptions with Discrete Representations},

author={Zhang, Jianrong and Zhang, Yangsong and Cun, Xiaodong and Huang, Shaoli and Zhang, Yong and Zhao, Hongwei and Lu, Hongtao and Shen, Xi},

booktitle={Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)},

year={2023},

}

| テキスト: 男性が前に出て逆立ちをします。 | ||||

|---|---|---|---|---|

| GT | T2M | MDM | モーションディフューズ | 私たちのもの |

|  |  |  |  |

| テキスト: 男が地面から立ち上がり、円を描いて歩き、再び地面に座ります。 | ||||

| GT | T2M | MDM | モーションディフューズ | 私たちのもの |

|  |  |  |  |

私たちのモデルは単一の GPU V100-32Gで学習できます

conda env create -f environment.yml

conda activate T2M-GPTコードは Python 3.8 と PyTorch 1.8.1 でテストされました。

bash dataset/prepare/download_glove.shHumanML3D と KIT-ML という 2 つの 3D ヒューマン モーション言語データセットを使用しています。どちらのデータセットについても、詳細とダウンロード リンクが [こちら] にあります。

HumanML3D を例に挙げると、ファイル ディレクトリは次のようになります。

./dataset/HumanML3D/

├── new_joint_vecs/

├── texts/

├── Mean.npy # same as in [HumanML3D](https://github.com/EricGuo5513/HumanML3D)

├── Std.npy # same as in [HumanML3D](https://github.com/EricGuo5513/HumanML3D)

├── train.txt

├── val.txt

├── test.txt

├── train_val.txt

└── all.txt

生成されたモーションを評価するために、t2m によって提供されるのと同じエクストラクターを使用します。エクストラクターをダウンロードしてください。

bash dataset/prepare/download_extractor.sh事前トレーニングされたモデル ファイルは、「pretrained」フォルダーに保存されます。

bash dataset/prepare/download_model.sh生成されたモーションをレンダリングしたい場合は、以下をインストールする必要があります。

sudo sh dataset/prepare/download_smpl.sh

conda install -c menpo osmesa

conda install h5py

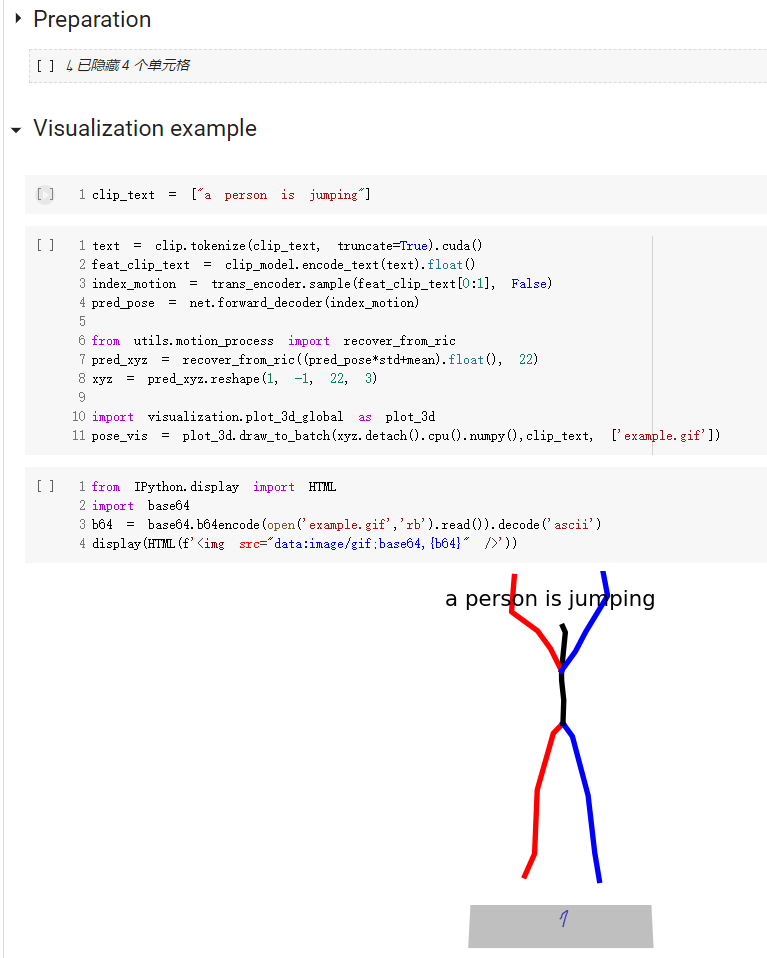

conda install -c conda-forge shapely pyrender trimesh mapbox_earcutコードの使用方法に関するクイック スタート ガイドは、demo.ipynb で入手できます。

キット データセットの場合は、「--dataname kit」を設定するだけでよいことに注意してください。

結果はフォルダー出力に保存されます。

python3 train_vq.py

--batch-size 256

--lr 2e-4

--total-iter 300000

--lr-scheduler 200000

--nb-code 512

--down-t 2

--depth 3

--dilation-growth-rate 3

--out-dir output

--dataname t2m

--vq-act relu

--quantizer ema_reset

--loss-vel 0.5

--recons-loss l1_smooth

--exp-name VQVAE結果はフォルダー出力に保存されます。

python3 train_t2m_trans.py

--exp-name GPT

--batch-size 128

--num-layers 9

--embed-dim-gpt 1024

--nb-code 512

--n-head-gpt 16

--block-size 51

--ff-rate 4

--drop-out-rate 0.1

--resume-pth output/VQVAE/net_last.pth

--vq-name VQVAE

--out-dir output

--total-iter 300000

--lr-scheduler 150000

--lr 0.0001

--dataname t2m

--down-t 2

--depth 3

--quantizer ema_reset

--eval-iter 10000

--pkeep 0.5

--dilation-growth-rate 3

--vq-act relupython3 VQ_eval.py

--batch-size 256

--lr 2e-4

--total-iter 300000

--lr-scheduler 200000

--nb-code 512

--down-t 2

--depth 3

--dilation-growth-rate 3

--out-dir output

--dataname t2m

--vq-act relu

--quantizer ema_reset

--loss-vel 0.5

--recons-loss l1_smooth

--exp-name TEST_VQVAE

--resume-pth output/VQVAE/net_last.pthtext-to-motion の評価設定に従って、モデルを 20 回評価し、平均結果を報告します。同じテキストから 30 個のモーションを生成する必要があるマルチモダリティの部分により、評価に時間がかかります。

python3 GPT_eval_multi.py

--exp-name TEST_GPT

--batch-size 128

--num-layers 9

--embed-dim-gpt 1024

--nb-code 512

--n-head-gpt 16

--block-size 51

--ff-rate 4

--drop-out-rate 0.1

--resume-pth output/VQVAE/net_last.pth

--vq-name VQVAE

--out-dir output

--total-iter 300000

--lr-scheduler 150000

--lr 0.0001

--dataname t2m

--down-t 2

--depth 3

--quantizer ema_reset

--eval-iter 10000

--pkeep 0.5

--dilation-growth-rate 3

--vq-act relu

--resume-trans output/GPT/net_best_fid.pthnpyフォルダーのアドレスとモーション名を入力する必要があります。以下に例を示します。

python3 render_final.py --filedir output/TEST_GPT/ --motion-list 000019 005485以下の方々のご協力に感謝いたします。