「AutoGPT がbrew installされたようなものです」。これは Kurtosis によって可能になりました。

注: これは現在、Milvus、Weaviate、および PineCone のサポートを終了する 0.4.0 で実行されます。必要な引数を指定してkurtosis run github.com/kurtosis-tech/[email protected]実行することで、0.3.1 に対して Kurtosis を実行できます。

YOUR_API_KEY_HERE OpenAI API キーに置き換えます)。 kurtosis run github.com/kurtosis-tech/autogpt-package --enclave autogpt ' {"OPENAI_API_KEY": "YOUR_API_KEY_HERE"} 'kurtosis service shell autogpt autogpt --exec " python -m autogpt "

YOUR_API_KEY_HERE OpenAI API キーに置き換えます)。 kurtosis run github.com/kurtosis-tech/autogpt-package --enclave autogpt ' {"OPENAI_API_KEY": "YOUR_API_KEY_HERE"} 'kurtosis service shell autogpt autogptそしてプロンプト内で次のようにします。

> python -m autogpt kurtosis enclave rm -f autogpt

ここにリストされている AutoGPT 構成値のいずれかを渡すには、 OPENAI_API_KEYで渡した場合と同様に、渡す JSON オブジェクトのプロパティとして引数を Kurtosis に渡します。

たとえば、 RESTRICT_TO_WORKSPACEフラグを渡す方法は次のとおりです。

kurtosis run github.com/kurtosis-tech/autogpt-package --enclave autogpt ' {"OPENAI_API_KEY": "YOUR_API_KEY_HERE", "RESTRICT_TO_WORKSPACE": "False"} '注:このパッケージは、デフォルトでlocalバックエンドを使用して AutoGPT を起動します。他のバックエンドは、上記のkurtosis runコマンドを実行するときに渡す JSON オブジェクトにMEMORY_BACKENDパラメーターを設定することで使用できます。

たとえば、 redisメモリ バックエンドを設定するには、次のようにします。

kurtosis run github.com/kurtosis-tech/autogpt-package --enclave autogpt ' {"OPENAI_API_KEY": "YOUR_API_KEY_HERE", "MEMORY_BACKEND": "redis"} '注: Redis は現時点では 0.4.0 では動作しません。

main.starにハードコードされたイメージ以外の別のイメージで実行するには、次を使用します。

kurtosis run github.com/kurtosis-tech/autogpt-package --enclave autogpt ' {"OPENAI_API_KEY": "YOUR_API_KEY_HERE", "AUTOGPT_IMAGE": "significantgravitas/auto-gpt:v0.4.0"} ' Kurtosis は、AutoGPT に付属するALLOWLISTED_PLUGINS構成フラグをサポートしています。たとえば、 AutoGPTTwitterプラグインを実行するには、次の手順を実行します。

kurtosis run github.com/kurtosis-tech/autogpt-package --enclave autogpt ' {"OPENAI_API_KEY": "YOUR_API_KEY_HERE", "ALLOWLISTED_PLUGINS": "AutoGPTTwitter"} '複数のプラグインを同時に実行するには;次のようにスペースを入れずにカンマで区切ります。

kurtosis run github.com/kurtosis-tech/autogpt-package --enclave autogpt '{"OPENAI_API_KEY": "YOUR_API_KEY_HERE", "ALLOWLISTED_PLUGINS": "AutoGPTTwitter,AutoGPTEmailPlugin"}'

内部では、Kurtosis がパッケージをダウンロードしてインストールします。

現時点では、次のプラグインがサポートされています。

さらに多くのプラグインのサポートを追加するには、単に問題を作成するか、 plugins.starにエントリを追加する PR を作成します。

OpenAI は一部の人にとって費用がかかる可能性があることを私たちは理解しています。さらに、これを自分のモデルで使用しようとしている人もいるかもしれません。 AutoGPT-Package は、 LocalAI経由で実行されるGPT4Allモデルに対する AutoGPT の実行をサポートします。ローカルモデルを使用するには -

kurtosis run github.com/kurtosis-tech/autogpt-package ' {"GPT_4ALL": true} 'これはhttps://gpt4all.io/models/ggml-gpt4all-j.binモデルのデフォルトを使用します

別のモデルを使用するには、次のようにMODEL_URLパラメータを試してください。

kurtosis run github.com/kurtosis-tech/autogpt-package ' {"GPT_4ALL": true, "MODEL_URL": "https://gpt4all.io/models/ggml-gpt4all-l13b-snoozy.bin"} ' このパッケージで開発するには、このリポジトリのクローンを作成し、次のコマンドを実行します。

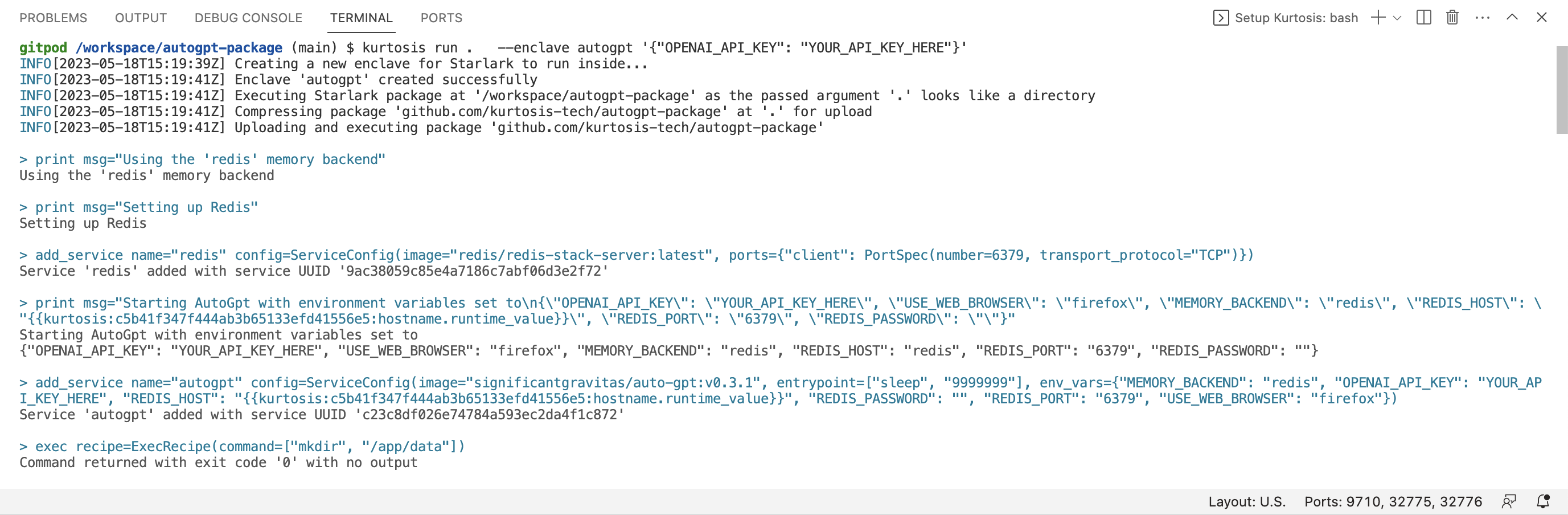

kurtosis run . --enclave autogpt ' {"OPENAI_API_KEY": "YOUR_API_KEY_HERE"} 'に注意してください. - これは、Kurtosis に (Github 上のバージョンではなく) ローカル マシン上のパッケージのバージョンを使用するように指示します。

Kurtosis には、このパッケージを構成する Starlark の構文強調表示とオートコンプリートを提供する拡張機能も VSCode マーケットプレイスで入手できます。

Discord または Twitter @KurtosisTech でお知らせください。

バグや機能リクエストがある場合は、お気軽に GitHub で問題を作成してください。