KoGPT2 chatbot

1.0.0

公開されたハングルチャットボットデータとプレトレインKoGPT2を用いた簡単なチャットボット実験

KoGPT2のさまざまな利用可能性を推進し、パフォーマンスを定性的に評価します。

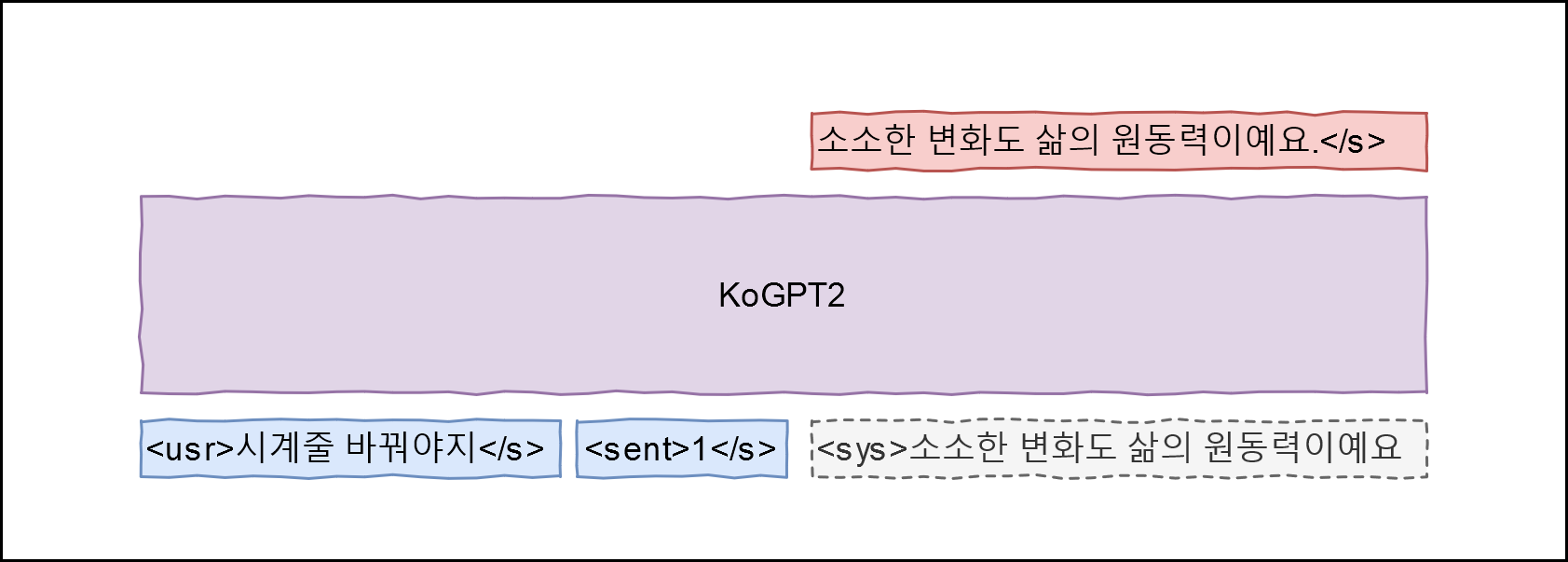

学習データに適したHello! GPT-2を応用、以下のアーキテクチャを設計する

データのQフィールドを<usr>発話、Aフィールドを<sys>発話、そして感情ラベルを<sent>にマッピングしてP(<sys>|<usr>, <sent>)を最大化できるモデルを学習する。感情ラベルはここの定義に従う(日常多反射0、別れ(否定)1、愛(肯定)2)。

git clone --recurse-submodules https://github.com/haven-jeon/KoGPT2-chatbot.gitcd KoGPT2-chatbot pip3 install -r requirements.txt

CUDA_VISIBLE_DEVICES=0 python train_torch.py --gpus 1 --train --max_epochs 2

# CUDA_VISIBLE_DEVICES=0 python train.py --chatCUDA_VISIBLE_DEVICES=0 python train_torch.py --gpus 1 --chat user>大ヒット Simsimi>うまくいくでしょう。 user>あなたの名前は何ですか?Simsimi>私はウィボットです。 user>私の日に何をしますか?Simsimi>私と遊んでください。 user>雨川 Simsimi>傘を持ってください。 user>雪 Simsimi>雪だるまを作ってみてください。 user > 雷雨 Simsimi>私も見たいです。 user>春が来ました。 Simsimi>春はいつもドキドキです。 user>排除されました。 Simsimi>すぐに家に帰って休憩してください。 user>あなたを作った人は?Simsimi>あなたが作った人です。

PyTorch