高速ストリーミング出力をサポートし、Secret Tower AI スーパー ネットワーク検索 (フル ネットワークまたはアカデミック、簡潔、詳細、リサーチの 3 つのモード)、ゼロ構成の導入、およびマルチチャネル トークンのサポートをサポートします。

ChatGPTインターフェースと完全互換。

次の 8 つの無料 API にも注目してください。

Moonshot AI (Kimi.ai) の API kimi-free-api へのインターフェイス

API への StepChat インターフェイス step-free-api

Zhipu AI (Zhipu Qingyan) API へのインターフェイス glm-free-api

API への Alibaba Tongyi (Qwen) インターフェイス qwen-free-api

Iflytek Spark インターフェイスから API へのspark-free-api

API への MiniMax (Conch AI) インターフェイス hailuo-free-api

API への DeepSeek インターフェイス deepseek-free-api

API emohaa-free-api への Listening Intelligence (Emohaa) インターフェイス

リバース API は不安定です。禁止されるリスクを避けるために、公式の Metaso AI https://metaso.cn/ を使用することをお勧めします。

この組織および個人は金銭的な寄付や取引を一切受け付けていません。このプロジェクトは純粋に研究、交換、学習を目的としています。

個人使用のみを目的としており、公式サービスへの圧力を避けるため、外部サービスへの提供や商用利用は禁止されています。それ以外の場合は自己責任でお願いします。

個人使用のみを目的としており、公式サービスへの圧力を避けるため、外部サービスへの提供や商用利用は禁止されています。それ以外の場合は自己責任でお願いします。

個人使用のみを目的としており、公式サービスへの圧力を避けるため、外部サービスへの提供や商用利用は禁止されています。それ以外の場合は自己責任でお願いします。

このリンクは一時的なテスト機能です。例外が発生した場合は、後でもう一度試してください。自分でデプロイすることをお勧めします。

https://udify.app/chat/46rRHl5xoVa4m1lo

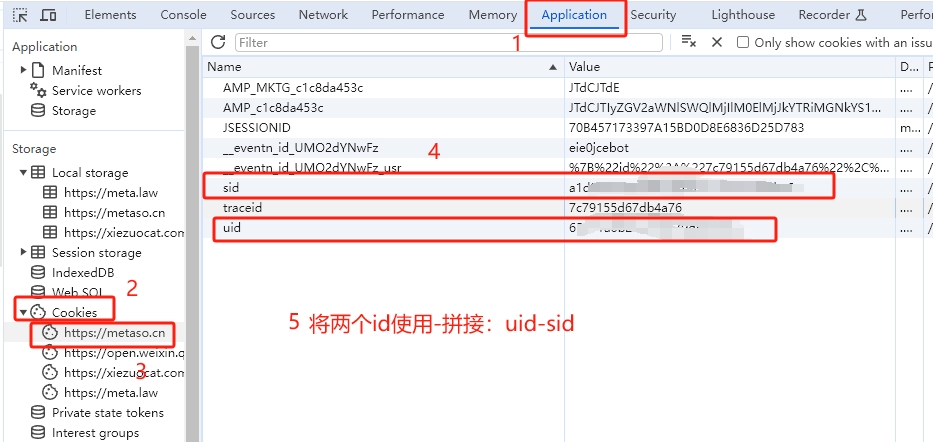

Secret Tower AI 検索からuidとsid取得し、 -を使用します。

Secret Tower AI 検索に入り、アカウントにログインします (アカウントにログインすることをお勧めします。そうしないと、奇妙な制限が発生する可能性があります)。F12 で開発者ツールを開き、[アプリケーション] > [アプリケーション] からuidとsid値を見つけます。クッキー。

uid と sid: uid-sidを結合します ( 65e91a6b2bac5b600dd8526a-5e7acc465b114236a8d9de26c9f41846など)。

これは、認可のベアラー トークン値として機能します。 Authorization: Bearer uid-sid

注: 現在、Secret Tower には IP アドレスの総検索数に制限があると考えられています。IP ローテーションに参加することをお勧めします。

複数のアカウントの uid-sid を指定し,それらを一緒に使用して以下を提供できます。

Authorization: Bearer uid-sid1,uid-sid2,uid-sid3

サービスがリクエストされるたびに、これらの 1 つが選択されます。

パブリックIPでポート8000を開放したサーバーをご用意ください。

イメージをプルしてサービスを開始する

docker run -it -d --init --name metaso-free-api -p 8000:8000 -e TZ=Asia/Shanghai vinlic/metaso-free-api:latestリアルタイムのサービスログを表示する

docker logs -f metaso-free-apiサービスを再起動する

docker restart metaso-free-apiサービスを停止する

docker stop metaso-free-api version : ' 3 '

services :

metaso-free-api :

container_name : metaso-free-api

image : vinlic/metaso-free-api:latest

restart : always

ports :

- " 8000:8000 "

environment :

- TZ=Asia/Shanghai

labels :

- vinlic.scope.metaso=metaso

watchtower :

image : containrrr/watchtower

restart : unless-stopped

command :

--cleanup

--scope metaso

--interval 600

--include-restarting

# 可以配置通知地址,具体支持列表请查看:https://containrrr.dev/shoutrrr/v0.8/services/overview/

# --notification-url="bark://{填入bark的token}@api.day.app/{填入bark的token}/metaso-image-just-updated?title=Notification"

volumes :

- /var/run/docker.sock:/var/run/docker.sock注: 一部のデプロイメント領域では、metaso に接続できない場合があります。コンテナーのログにリクエストのタイムアウトが示されている場合、または接続できない場合は、デプロイメントのために他の領域に切り替えてください。注: 無料アカウントのコンテナ インスタンスは、非アクティブ状態が一定期間続くと自動的に実行を停止します。これにより、次のリクエストで 50 秒以上の遅延が発生します。[コンテナのキープ アライブをレンダリング] をオンにすることをお勧めします。

このプロジェクトを github アカウントにフォークします。

Render にアクセスし、Github アカウントにログインします。

Web サービスを構築します (新規+ -> Git リポジトリから構築してデプロイ -> フォークされたプロジェクトを接続 -> デプロイ領域を選択 -> インスタンス タイプを無料として選択 -> Web サービスの作成)。

構築が完了したら、割り当てられたドメイン名をコピーし、URLを接続してアクセスします。

注: Vercel 無料アカウントのリクエスト応答タイムアウトは 10 秒ですが、インターフェイスの応答には通常より時間がかかり、Vercel から返される 504 タイムアウト エラーが発生する可能性があります。

最初に Node.js 環境がインストールされていることを確認してください。

npm i -g vercel --registry http://registry.npmmirror.com

vercel login

git clone https://github.com/LLM-Red-Team/metaso-free-api

cd metaso-free-api

vercel --prodパブリックIPでポート8000を開放したサーバーをご用意ください。

まずNode.js環境をインストールして環境変数を設定し、nodeコマンドが利用できることを確認してください。

依存関係をインストールする

npm iプロセス保護のために PM2 をインストールする

npm i -g pm2コンパイルしてビルドすると、dist ディレクトリが表示されたらビルドは完了です。

npm run buildサービス開始

pm2 start dist/index.js --name " metaso-free-api "リアルタイムのサービスログを表示する

pm2 logs metaso-free-apiサービスを再起動する

pm2 reload metaso-free-apiサービスを停止する

pm2 stop metaso-free-api無料 API シリーズ プロジェクトにアクセスするには、次の二次開発クライアントを使用する方が速くて簡単です。また、ドキュメント/画像のアップロードもサポートされています。

Clivia が開発した LobeChat https://github.com/Yanyutin753/lobe-chat

ChatGPT Web https://github.com/SuYxh/chatgpt-web-sea 開発者: Guangguang@

現在、openai と互換性のある/v1/chat/completionsインターフェイスをサポートしています。openai または他のクライアントと互換性のあるクライアント アクセス インターフェイスを使用することも、dify などのオンライン サービスを使用してアクセスすることもできます。

会話完了インターフェイス。openai の chat-completions-api と互換性があります。

POST /v1/chat/completions

ヘッダーには Authorization ヘッダーを設定する必要があります。

Authorization: Bearer [token]

データのリクエスト:

{

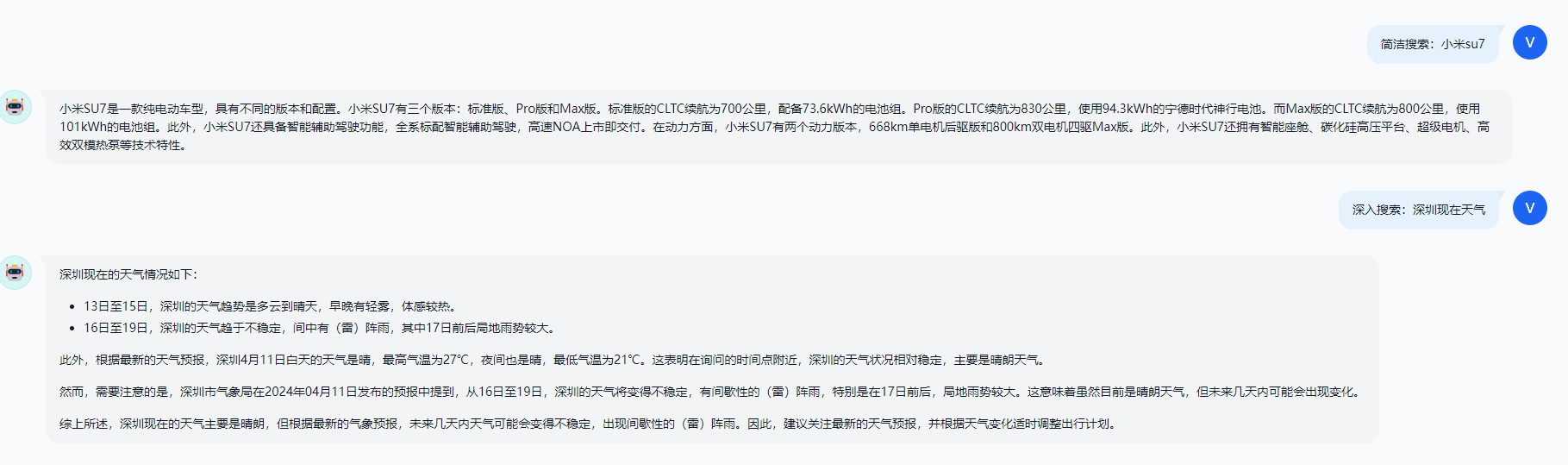

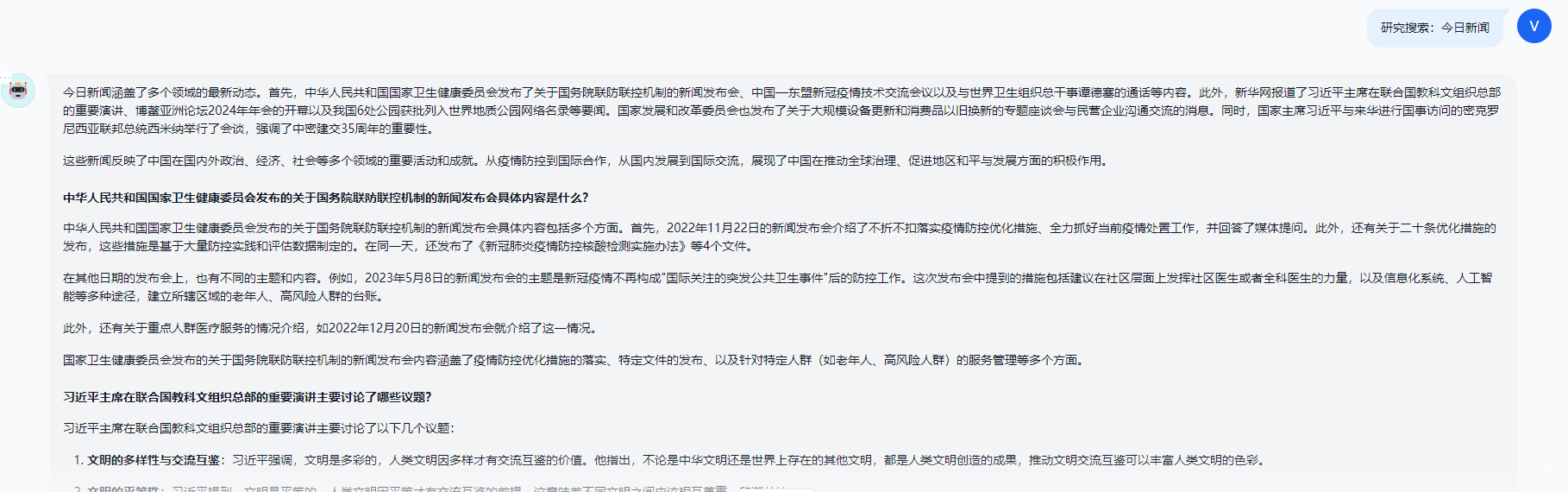

// 全网model名称支持 -> 简洁:concise / 深入:detail / 研究:research

// 学术model名称支持 -> 学术-简洁:concise-scholar / 学术-深入:detail-scholar / 学术-研究:research-scholar

// model乱填的话,可以通过tempature参数来控制(但不支持学术):简洁:< 0.4 / 深入:>= 0.4 && < 0.7 / 研究:>= 0.7

// model乱填的话,还可以通过消息内容包含指令来控制:↓↓↓

// 简洁 -> 简洁搜索小米su7 / 深入 -> 深入搜索小米su7 / 研究 -> 研究搜索小米su7

// 学术-简洁 -> 学术简洁搜索:小米su7 / 学术-深入 -> 学术深入搜索小米su7 / 学术研究 -> 学术研究搜索小米su7

// 优先级:model > 消息内容指令 > tempature

"model" : " concise " ,

"messages" : [

{

"role" : " user " ,

"content" : "秘塔AI "

}

],

// 如果使用SSE流请设置为true,默认false

"stream" : false

}応答データ:

{

"id" : " 8466827997659213824 " ,

"model" : " concise " ,

"object" : " chat.completion " ,

"choices" : [

{

"index" : 0 ,

"message" : {

"role" : " assistant " ,

"content" : "秘塔AI搜索是上海秘塔网络科技有限公司在2024年初推出的一款新产品,被誉为中国版Perplexity。它利用自研的大模型MetaLLM,能够直接对用户的提问进行理解和回答,提供结构化、准确、直接的搜索结果,并明确列出来源参考,无需科学上网,解决了语言理解上的误差[[1]]。秘塔AI搜索通过其强大的语义理解能力和全网搜索功能,为用户提供了一个高效、无广告、信息丰富的搜索体验[[2]]。此外,秘塔AI搜索的特点包括没有广告,直达结果;结构化信息展示;以及信息来源追溯,为每条搜索结果提供了来源链接,用户可以轻松溯源验证信息的出处和可靠性[[4]]。秘塔科技成立于2018年4月,是一家新锐科技公司,致力于运用AI技术赋能专业场景,进行技术研发与产品落地[[3]]。 n "

},

"finish_reason" : " stop "

}

],

"usage" : {

"prompt_tokens" : 1 ,

"completion_tokens" : 1 ,

"total_tokens" : 2

},

"created" : 1712859314

}トークンが生きているかどうかを確認してください。生きている場合は true、それ以外の場合は、このインターフェイスを頻繁に呼び出さないでください (10 分以内)。

POST /トークン/チェック

データのリクエスト:

{

"token" : " 65e91a6b2bac5b600dd8526a-5e7acc465b114236a8d9de26c9f41846 "

}応答データ:

{

"live" : true

}Nginxリバースプロキシmetaso-free-apiを使用している場合は、ストリームの出力効果を最適化し、エクスペリエンスを最適化するために、次の設定項目を追加してください。

# 关闭代理缓冲。当设置为off时,Nginx会立即将客户端请求发送到后端服务器,并立即将从后端服务器接收到的响应发送回客户端。

proxy_buffering off ;

# 启用分块传输编码。分块传输编码允许服务器为动态生成的内容分块发送数据,而不需要预先知道内容的大小。

chunked_transfer_encoding on ;

# 开启TCP_NOPUSH,这告诉Nginx在数据包发送到客户端之前,尽可能地发送数据。这通常在sendfile使用时配合使用,可以提高网络效率。

tcp_nopush on ;

# 开启TCP_NODELAY,这告诉Nginx不延迟发送数据,立即发送小数据包。在某些情况下,这可以减少网络的延迟。

tcp_nodelay on ;

# 设置保持连接的超时时间,这里设置为120秒。如果在这段时间内,客户端和服务器之间没有进一步的通信,连接将被关闭。

keepalive_timeout 120 ;推論側はmetaso-free-apiではないため、トークンはカウントできず固定数で返されます。