diffusion model tf generativefill

1.0.0

この作業では、拡散モデルを使用して、画像のマスク解除、修復、拡張、およびさまざまな生成塗りつぶし技術などの生成塗りつぶし技術を実装します。

画像修復(元の画像、マスクされた画像、再構成された画像)

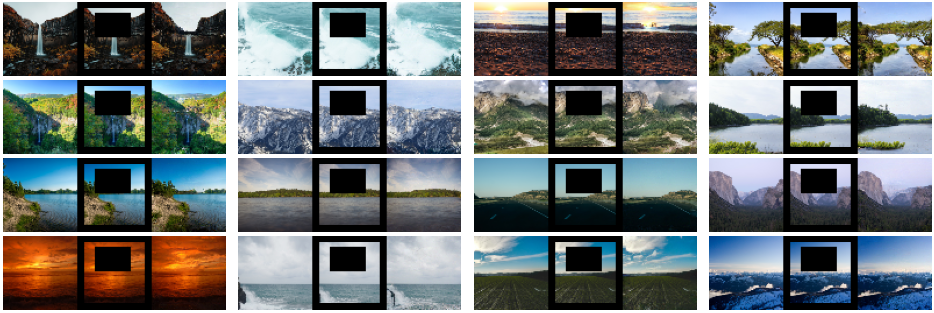

DDPM が生成されました (Landscape データセットを使用してトレーニングおよび生成されました)。

LDM が生成されました (COCO でトレーニングされ、Landscape データセットを使用して生成されました)。

COCOでサンプリング

さらに生成された画像が結果に表示されます

私の DDPM 実装をチェックしてください。

このリポジトリには、DDPM を使用した生成埋め込みが含まれています。 LDM を使用して同じことを実行するには、ここで私の LDM リポジトリをチェックアウトしてください。このリポジトリの ldm-genfill フォルダーには、ldm モデルを使用して生成埋め込みを実行するためのモデル構成ファイルのみが含まれています。したがって、このリポジトリの構成ファイルを使用して、LDM リポジトリの実装を使用します。すべての LDM コンディショニングに関するデモとその他の手順は、LDM リポジトリで入手できます。

DDPM は画像に対して直接動作するため、現在 DDPM からのマスクされていない領域は、LDM と比較してコンテキストに関連しているように見えます。 GenFill をサポートするために Text およびクラス コンディショニングを使用すると、コンテキスト フィルの能力がわずかに向上し、さらなるトレーニングも向上する可能性があります。今後、改良が加えられる予定があるかもしれません。

最近の更新