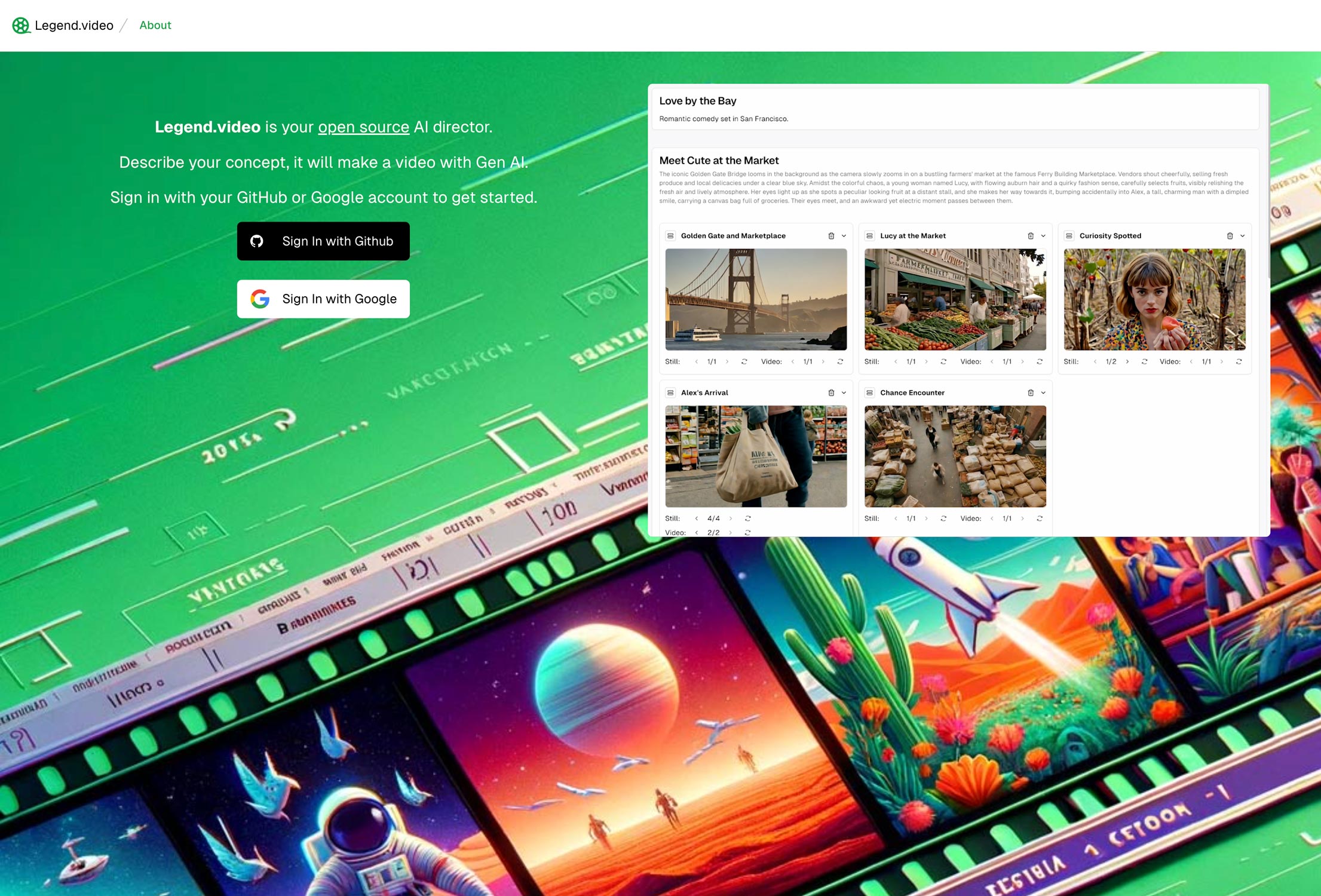

Legend.video は、オープンソースの AI ディレクターです。コンセプトを説明してください。Gen AI を使用してビデオを作成します。 Legend.video で試すことができます。

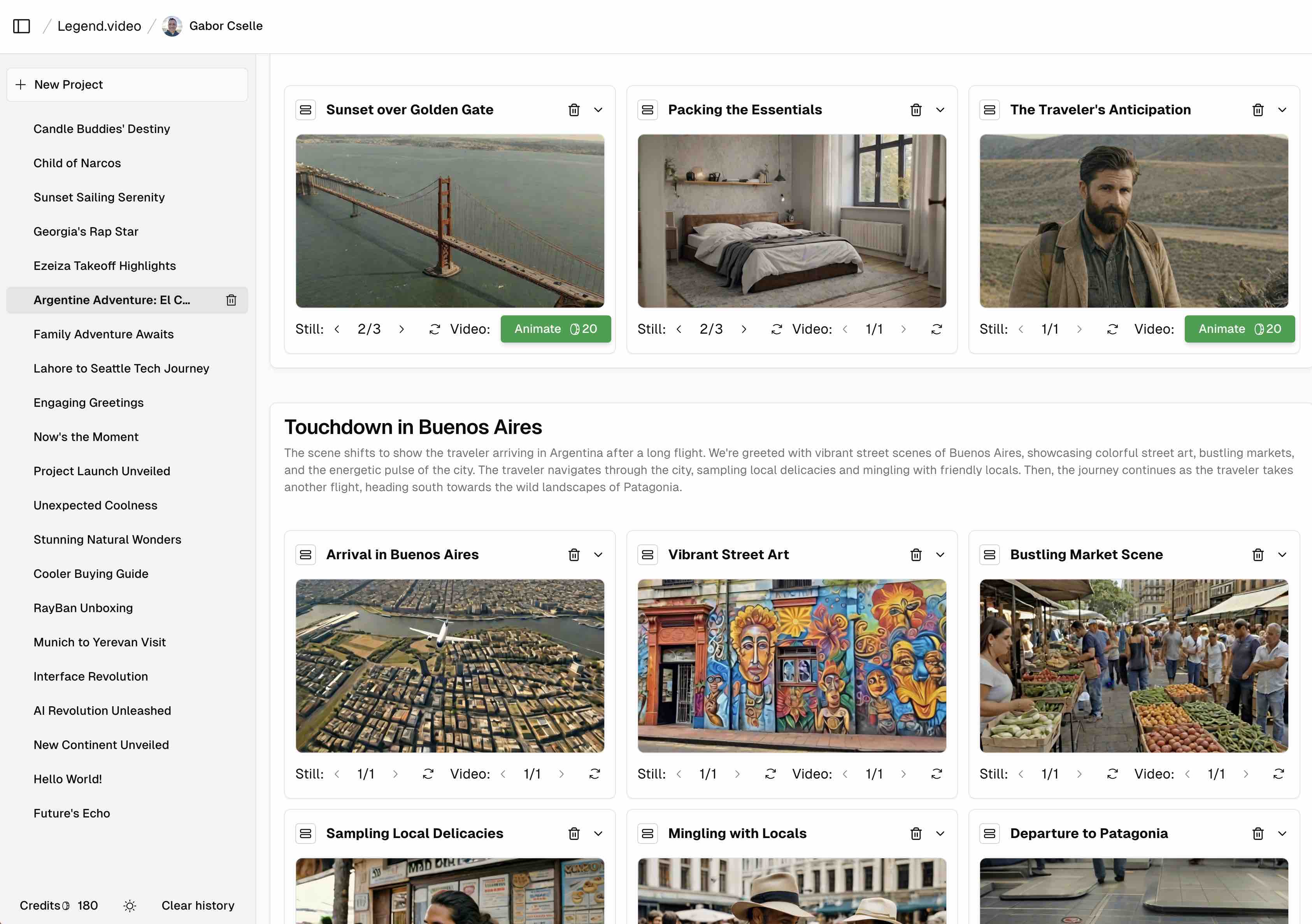

簡単なプロンプト (例: 「サンフランシスコ ロマンス」) から、Legend.video はまず個々のショットで構成されるシーンを含むストーリーボードを生成します。その後、ストーリーボードを編集し、各ショットの静止画像を生成し、その静止画像からビデオを生成できます。出力はストーリーを伝えるビデオです。

現在のビデオ モデルは、ストーリーを伝えることができない 2 ~ 4 秒のクリップを生成します。 Legend.video は、2 ~ 4 秒の短いショットからストーリーを構築するのに役立ちます。

.env.exampleローカルの.env.localファイルにコピーして、さまざまな環境変数とシークレットを設定します。ストレージには Supabase、ブロブ ストレージには Vercel、ログインには Github と Google、AI 生成には Replicate を使用しています。

$ cp .env.example .env.local

DB ストレージ: Supabase プロジェクトを開始し、 docs/db_schema.sqlから DB スキーマをプリロードする必要があります。

Vercel Blob storage: Vercel blobstore を使用しています。無料プランで BLOB ストアを作成し、 BLOB_READ_WRITE_TOKEN変数を入力できます。

ログイン: 設定で GitHub OAuth トークンを作成できます。 Google の場合は、新しいプロジェクトを開始して OAuth キーを作成する必要があります。

Replicate: ホスト型 AI モデルには Replicate を使用しています。ここでキーにサインアップし、トークンをREPLICATE_API_TOKENにコピーします。

次に、次のコマンドを実行して依存関係をインストールし、サーバーを起動します。

$ pnpm install

$ pnpm run dev

これで、localhost:3000 でアプリが実行されていることが確認できるはずです。

次のいずれかについてサポートが必要な場合は、以下までご連絡ください。

Github の問題ページで問題を報告してください。

バグ修正や新機能に貢献したい場合は、リポジトリをフォークし、ブランチで変更を加えてから、プル リクエストを送信してください。できるだけ早くレビューし、問題がなければ統合します。

このレポに注目していただきありがとうございます!