slackbot_gemini

1.0.0

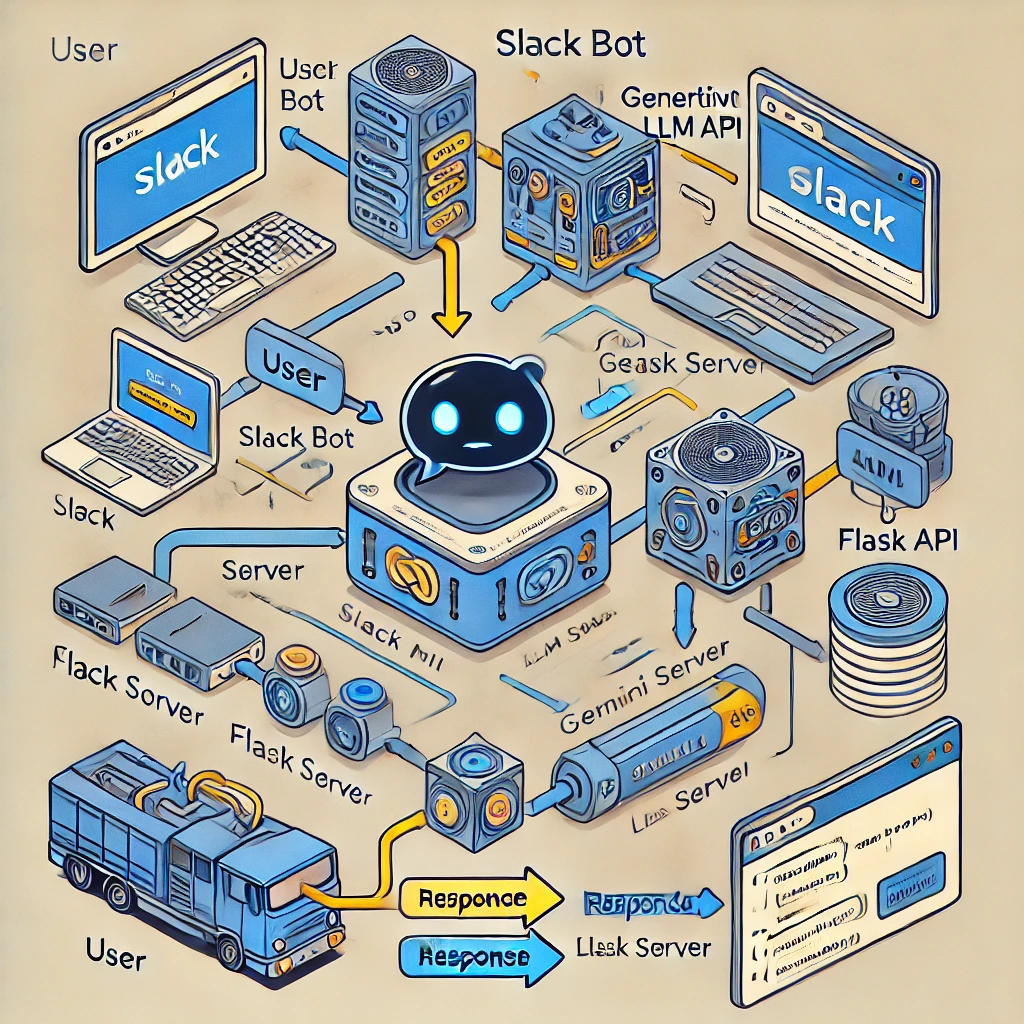

このプロジェクトでは、Google の Gemini モデルを使用して、Slack ボットを大規模言語モデル (LLM) ベースのチャットボットと統合する方法を示します。この統合により、Slack 内で直接インテリジェントでコンテキストを認識したコミュニケーションが可能になります。

Slack ボットは Python と Flask を使用して構築され、Gemini モデルを利用した LLM 搭載のチャットボットと統合されています。この設定により、ボットは Slack チャネルでユーザー入力を処理し、最新のデータ エンジニアリング情報に基づいてインテリジェントに応答できるようになります。

使用するライブラリ:slack_sdk、slack_bolt 機能:ボットは、誰かが Slack チャネルでボットにメンションしたときにトリガーされる app_mention イベントをリッスンします。構成: トークンとシークレットは、環境変数を使用して .env ファイルから安全にロードされます。

Flask App: The Flask app handles incoming HTTP requests from Slack.

Event Processing: Slack events are processed through Flask using SlackRequestHandler from the slack_bolt.adapter.flask module.

Gemini Model: The Gemini model, provided by Google's Generative AI platform, processes and responds to queries.

Python Package: The google.generativeai package is used to interact with the Gemini model, allowing for prompt-based queries.

Configuration: Tokens are securely loaded from a .env file using environment variables for geminiai api.

ngrok の使用法: ngrok は、ローカルの Flask アプリケーションにリクエストを転送するパブリック URL を提供し、Slack がボットと通信できるようにします。セットアップ コマンド: ngrok http 6060 は、Flask アプリをインターネットに公開するために使用されます。

この統合により、Slack ボットは高度なデータ分析を実行し、Slack 内でユーザーのクエリにインテリジェントに応答できるようになります。