CoDA にスターを付けて共有してください。ありがとう

[論文] [プロジェクトページ]

ヤン・カオ、イーハン・ゼン、ハン・シュー、ダン・シュー

香港科技大学

ファーウェイ・ノアの方舟研究所

アップデート

☑ 3D ガウス スプラッティングを 3D 物体検出に導入する最初の作品として、3DGS-DET がここでリリースされました。

☑ 私たちの拡張作品CoDAv2がリリースされました。arXiv でチェックしてください!

☑ オープン語彙認識に関する最新の論文とコードがここに集められています。

☑ すべてのコード、データ、事前学習済みモデルがリリースされました。

☑ トレーニング コードとテスト コードがリリースされました。

☑ 事前学習済みモデルがリリースされました。

☑ OV 設定の SUN-RGBD データセットがリリースされました。

☑ OV 設定の ScanNet データセットがリリースされました。

☑ 紙の LaTeX コードは https://scienhub.com/Yang/CoDA で入手できます。

私たちのコードは、PyTorch 1.8.1、torchvision==0.9.1、CUDA 10.1、および Python 3.7 に基づいています。他のバージョンでも動作する可能性があります。

次の Python 依存関係もインストールしてください。

matplotlib

opencv-python

plyfile

'trimesh>=2.35.39,<2.35.40'

'networkx>=2.2,<2.3'

scipy

実行してpointnet2レイヤーをインストールしてください

cd third_party/pointnet2 && python setup.py install

トレーニングを高速化するには、gIOU の Cythonized 実装をインストールしてください。

conda install cython

cd utils && python cython_compile.py build_ext --inplace

OV設定を実現するために、オリジナルのScanNetとSUN RGB-Dを再編成し、より多くのカテゴリーのアノテーションを採用しました。ここで提供している ov 設定データセット (OV SUN RGB-D および OV ScanNet) を直接ダウンロードしてください。次のコマンドを実行して簡単にダウンロードすることもできます。

bash data_download.sh

次に、ダウンロードした *.tar ファイルに対して実行します。

bash data_preparation.sh

事前トレーニング済みモデルをここからダウンロードします。次に、次を実行します。

bash test_release_models.sh

bash scripts/coda_sunrgbd_stage1.sh

bash scripts/coda_sunrgbd_stage2.sh

bash run_samples.sh

CoDA が役立つ場合は、以下を引用してください。

@inproceedings{cao2023coda,

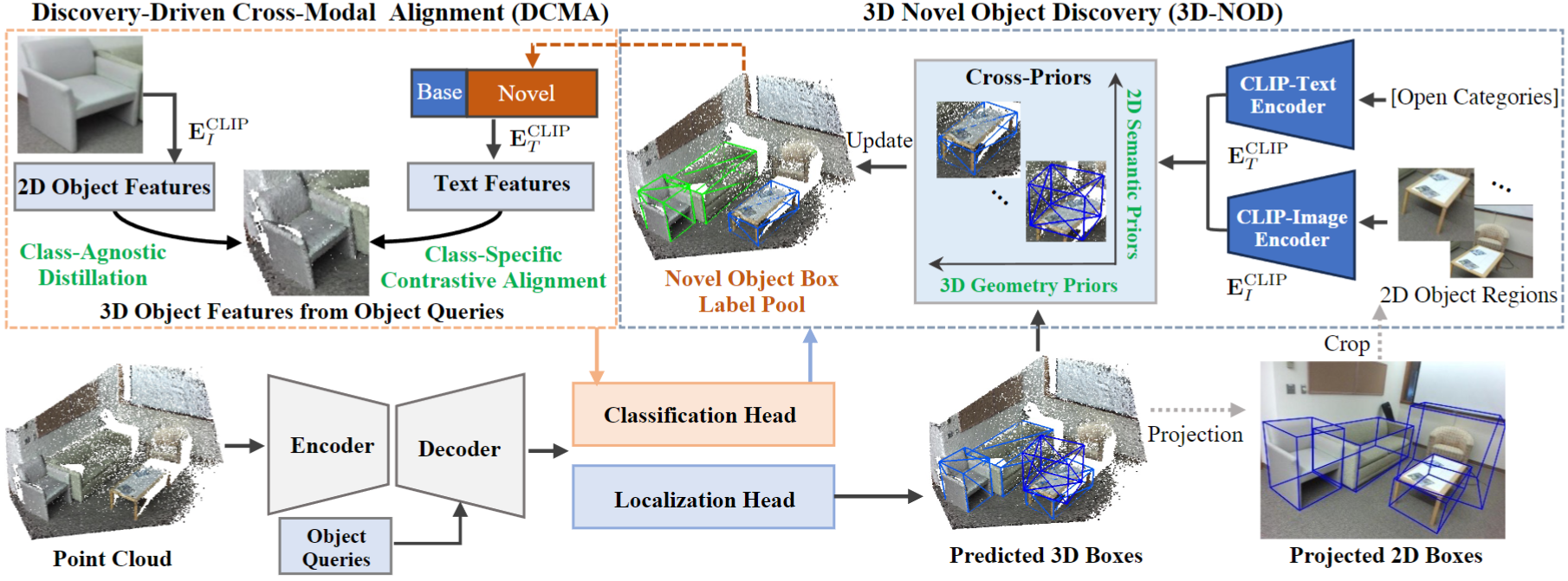

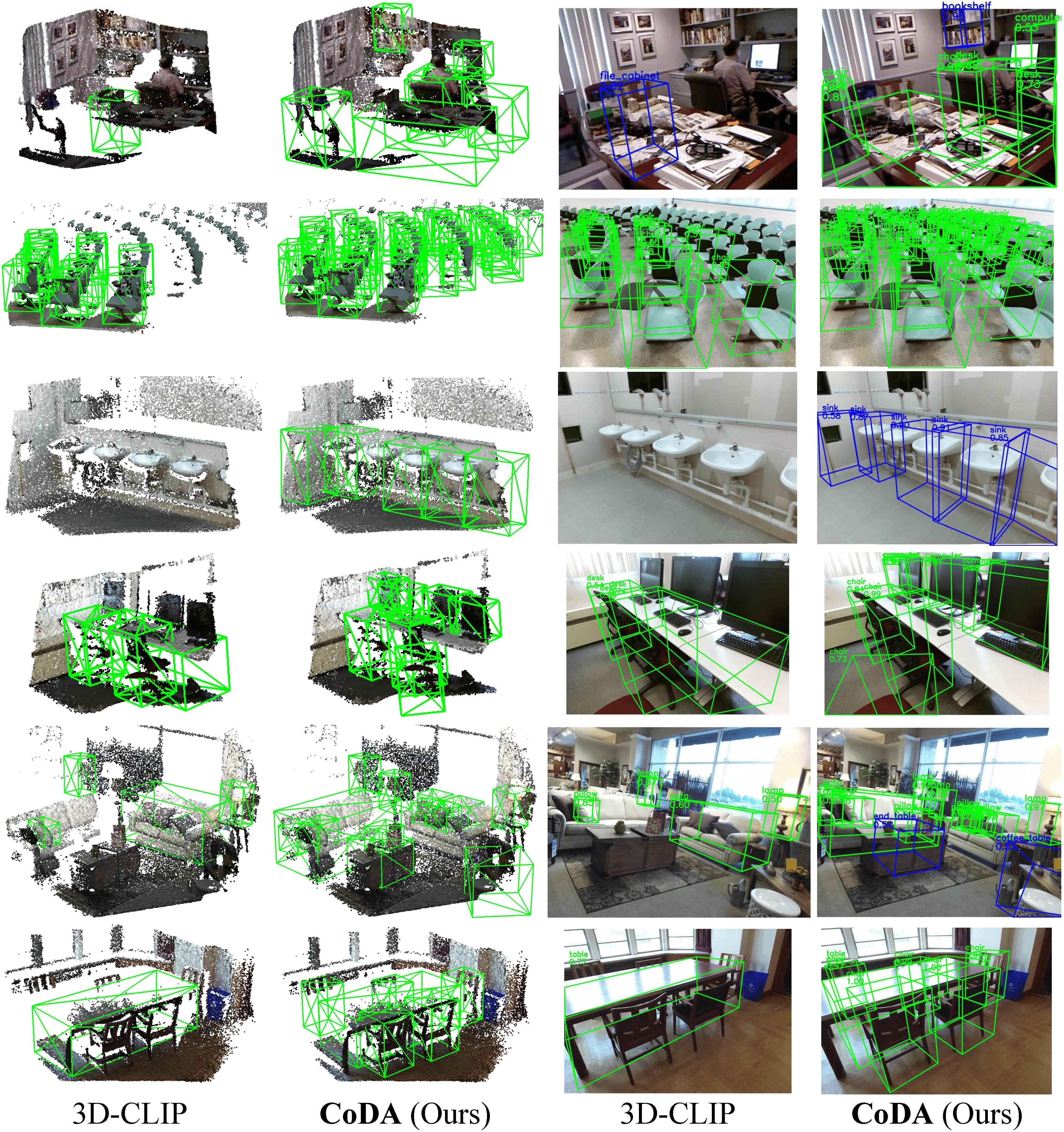

title={CoDA: Collaborative Novel Box Discovery and Cross-modal Alignment for Open-vocabulary 3D Object Detection},

author={Cao, Yang and Zeng, Yihan and Xu, Hang and Xu, Dan},

booktitle={NeurIPS},

year={2023}

}

@misc{cao2024collaborative,

title={Collaborative Novel Object Discovery and Box-Guided Cross-Modal Alignment for Open-Vocabulary 3D Object Detection},

author={Yang Cao and Yihan Zeng and Hang Xu and Dan Xu},

year={2024},

eprint={2406.00830},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2406.00830},

}

ご質問やコラボレーションの必要性 (研究目的または商業目的) がある場合は、 [email protected]電子メールを送信してください。

CoDA は CLIP と 3DETR からインスピレーションを受けています。彼らの素晴らしいコードに感謝します。