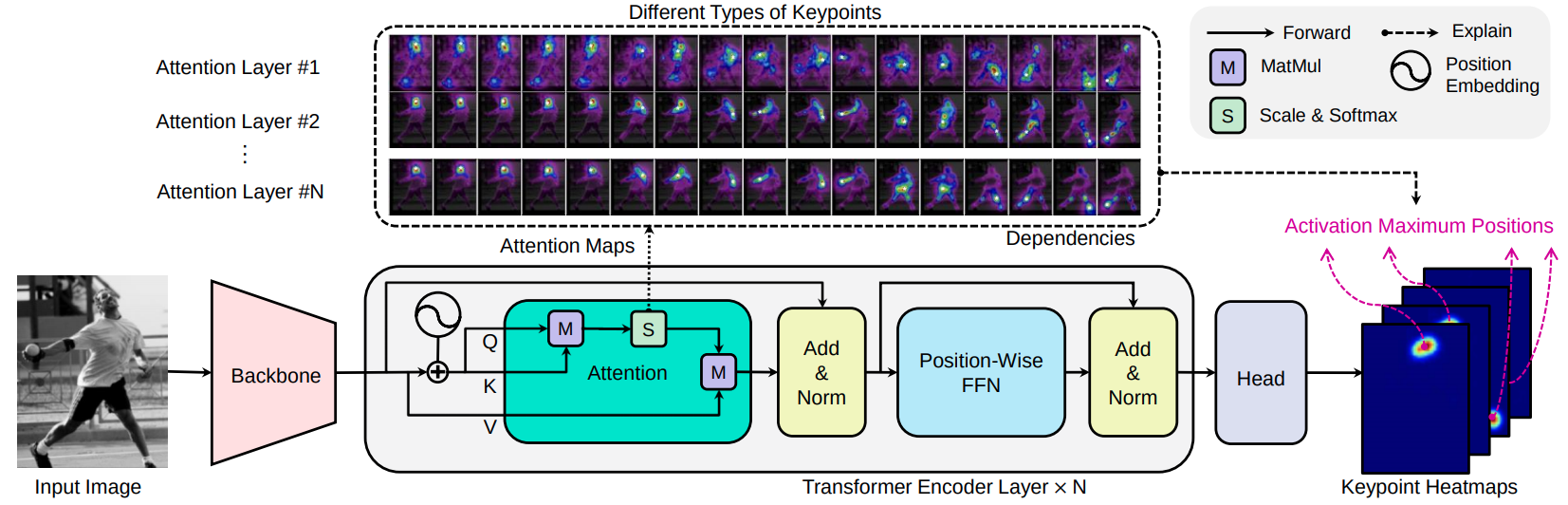

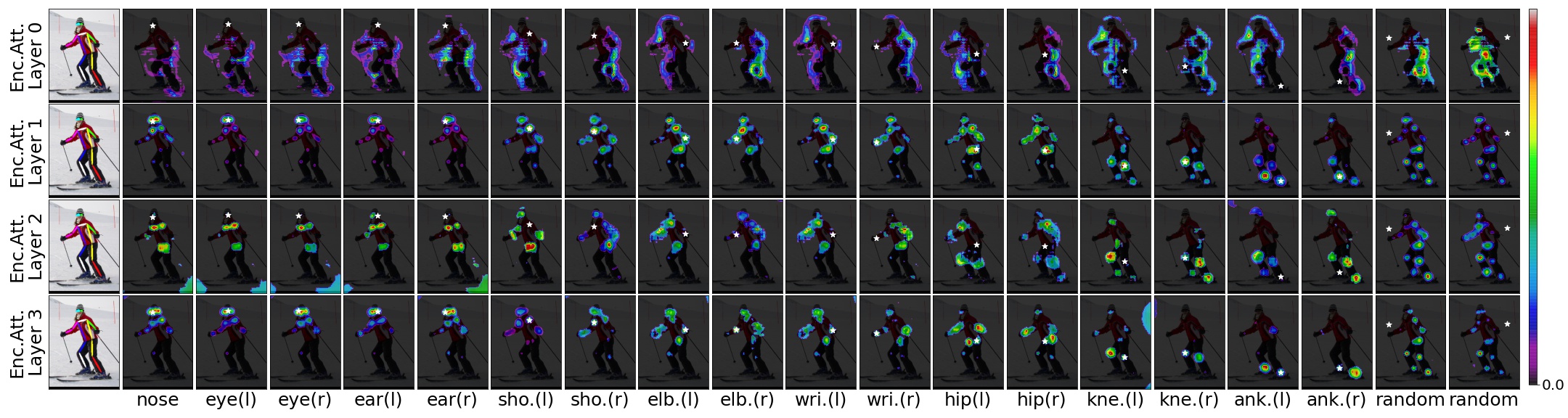

Transposeは、 CNN特徴抽出器、変圧器エンコーダー、予測ヘッドに基づいた人間のポーズ推定モデルです。画像を考えると、変圧器に組み込まれた注意層は、キーポイント間の長距離空間関係を効率的にキャプチャし、予測されるキーポイントの位置がどの依存関係に依存しているかを説明できます。

[arxiv 2012.14214] [紙] [demo-notebook]

Transpose:Transformer、Sen Yang、Zibin Quan、Mu Nie、Wankou Yang、ICCV 2021を介したキーポイントローカリゼーション

バックボーン候補として2種類のCNNを選択します:ResNetとHRNET。導出された畳み込みブロックは、ResNet-Small、HRNET-SMALL-W32、およびHRNET-SMALL-W48です。

| モデル | バックボーン | #attentionレイヤー | d | h | #heads | #params | AP(coco val gt bbox) | ダウンロード |

|---|---|---|---|---|---|---|---|---|

| Transpose-R-A3 | resnet-s | 3 | 256 | 1024 | 8 | 5.2MB | 73.8 | モデル |

| Transpose-R-A4 | resnet-s | 4 | 256 | 1024 | 8 | 6.0MB | 75.1 | モデル |

| Transpose-hs | HRNET-S-W32 | 4 | 64 | 128 | 1 | 8.0MB | 76.1 | モデル |

| Transpose-H-A4 | HRNET-S-W48 | 4 | 96 | 192 | 1 | 17.3MB | 77.5 | モデル |

| Transpose-H-A6 | HRNET-S-W48 | 6 | 96 | 192 | 1 | 17.5MB | 78.1 | モデル |

Webデモを試してみてください:

Transpose-R-A4またはTranspose-H-A4モデルを、Torch HubのCoco Train2017データセットに、次のように直接ロードできます。

import torch

tpr = torch . hub . load ( 'yangsenius/TransPose:main' , 'tpr_a4_256x192' , pretrained = True )

tph = torch . hub . load ( 'yangsenius/TransPose:main' , 'tph_a4_256x192' , pretrained = True )| モデル | 入力サイズ | fps* | GFLOPS | AP | AP .5 | AP .75 | AP(M) | AP(L) | ar | AR .5 | AR .75 | AR(M) | AR(L) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transpose-R-A3 | 256x192 | 141 | 8.0 | 0.717 | 0.889 | 0.788 | 0.680 | 0.786 | 0.771 | 0.930 | 0.836 | 0.727 | 0.835 |

| Transpose-R-A4 | 256x192 | 138 | 8.9 | 0.726 | 0.891 | 0.799 | 0.688 | 0.798 | 0.780 | 0.931 | 0.845 | 0.735 | 0.844 |

| Transpose-hs | 256x192 | 45 | 10.2 | 0.742 | 0.896 | 0.808 | 0.706 | 0.810 | 0.795 | 0.935 | 0.855 | 0.752 | 0.856 |

| Transpose-H-A4 | 256x192 | 41 | 17.5 | 0.753 | 0.900 | 0.818 | 0.717 | 0.821 | 0.803 | 0.939 | 0.861 | 0.761 | 0.865 |

| Transpose-H-A6 | 256x192 | 38 | 21.8 | 0.758 | 0.901 | 0.821 | 0.719 | 0.828 | 0.808 | 0.939 | 0.864 | 0.764 | 0.872 |

注記:

| モデル | 入力サイズ | #params | GFLOPS | AP | AP .5 | AP .75 | AP(M) | AP(L) | ar | AR .5 | AR .75 | AR(M) | AR(L) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transpose-hs | 256x192 | 8.0m | 10.2 | 0.734 | 0.916 | 0.811 | 0.701 | 0.793 | 0.786 | 0.950 | 0.856 | 0.745 | 0.843 |

| Transpose-H-A4 | 256x192 | 17.3m | 17.5 | 0.747 | 0.919 | 0.822 | 0.714 | 0.807 | 0.799 | 0.953 | 0.866 | 0.758 | 0.854 |

| Transpose-H-A6 | 256x192 | 17.5m | 21.8 | 0.750 | 0.922 | 0.823 | 0.713 | 0.811 | 0.801 | 0.954 | 0.867 | 0.759 | 0.859 |

Jupyterノートブックデモ

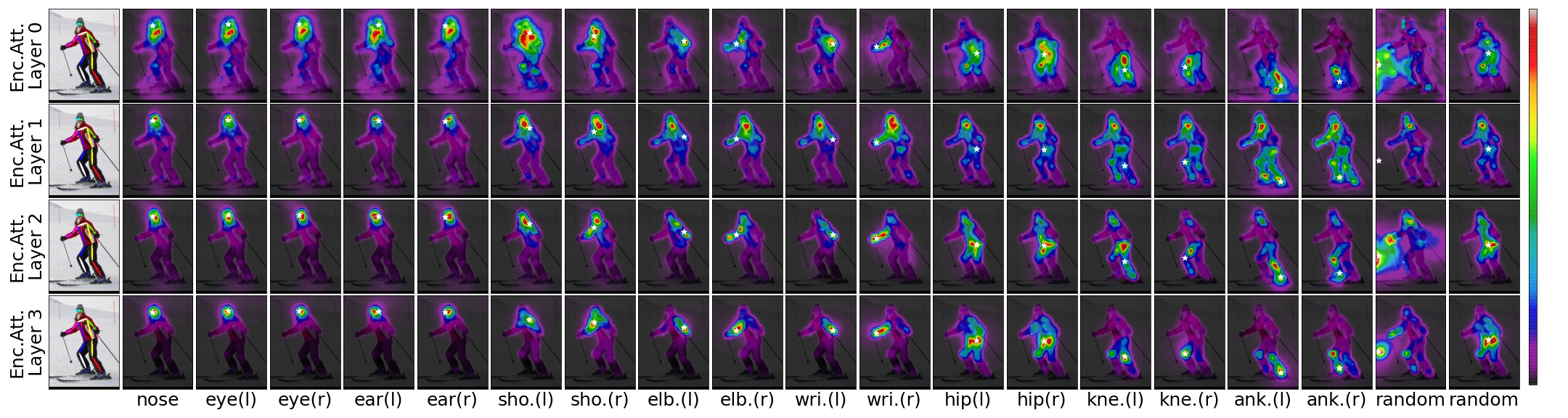

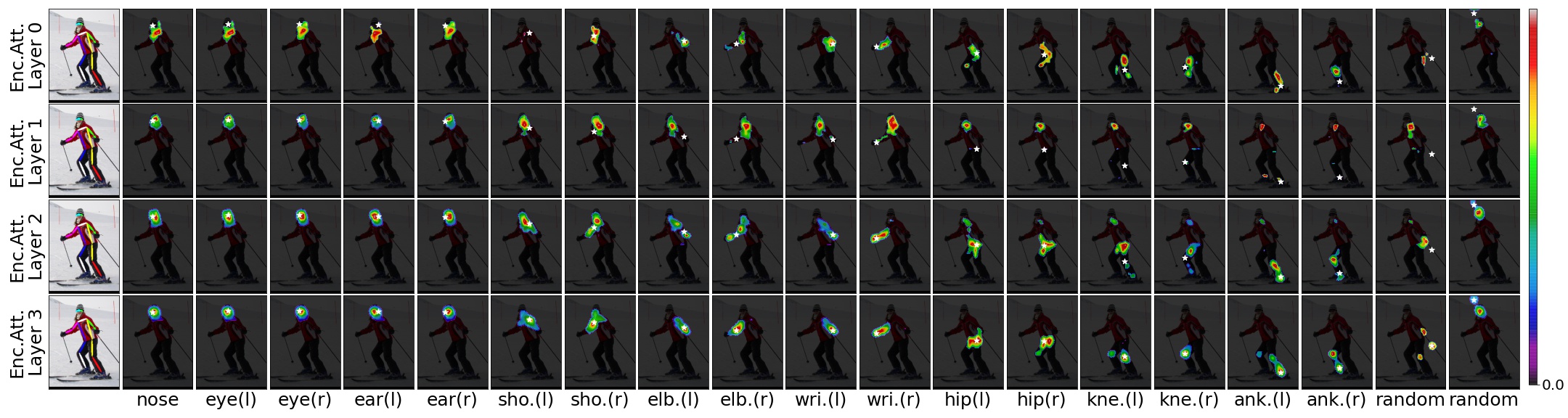

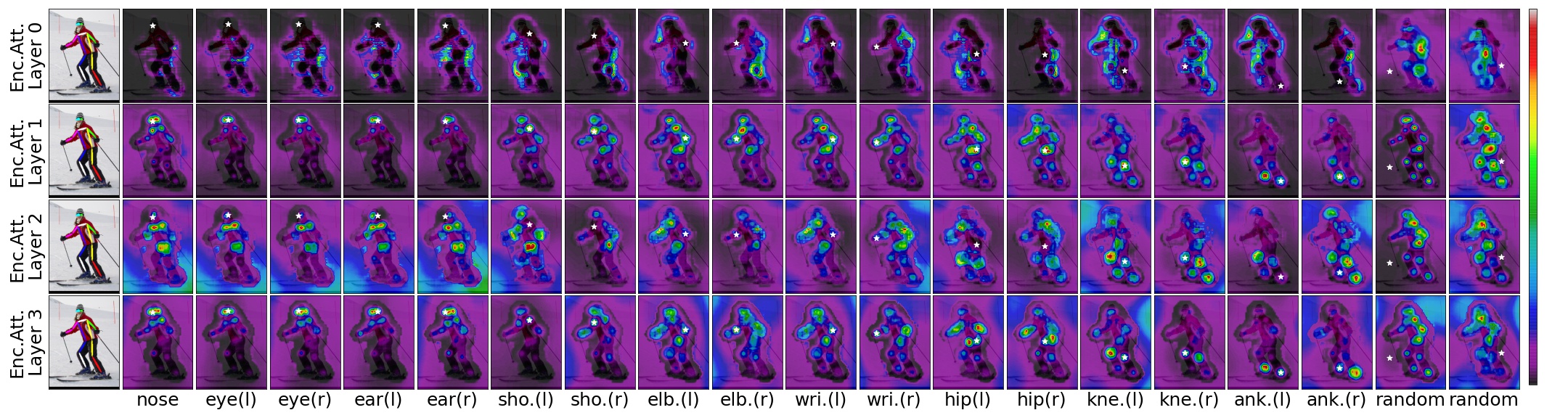

入力画像、前処理された転置モデル、および予測された場所を考えると、注意スコアのしきい値を持つ予測位置の空間依存関係を視覚化できます。

threshold=0.00のTransPose-R-A4

threshold=0.01のTransPose-R-A4

threshold=0.00のTransPose-H-A4

threshold=0.00075のTransPose-H-A4

このリポジトリをクローンすると、$ {pose_root}としてクローン化されたディレクトリを呼び出します

git clone https://github.com/yangsenius/TransPose.gitPytorch> = 1.6およびTorchvision> = 0.7をPytorchの公式Webサイトからインストールします

パッケージの依存関係をインストールします。 Python環境> = 3.7を確認してください

pip install -r requirements.txt$ {pose_root}の下で出力(トレーニングモデルとファイル)とログ(テンソルボードログ)ディレクトリを作成し、libsを作成します

mkdir output log

cd ${POSE_ROOT} /lib

makeこのリポジトリのリリースから指定されたディレクトリに前払いされたモデルをダウンロードする

$ {POSE_ROOT}

`-- models

`-- pytorch

|-- imagenet

| |-- hrnet_w32-36af842e.pth

| |-- hrnet_w48-8ef0771d.pth

| |-- resnet50-19c8e357.pth

|-- transpose_coco

| |-- tp_r_256x192_enc3_d256_h1024_mh8.pth

| |-- tp_r_256x192_enc4_d256_h1024_mh8.pth

| |-- tp_h_32_256x192_enc4_d64_h128_mh1.pth

| |-- tp_h_48_256x192_enc4_d96_h192_mh1.pth

| |-- tp_h_48_256x192_enc6_d96_h192_mh1.pth HRNETの手順に従って、Coco Train/Val/Testデータセットと注釈を準備します。検出された人の結果は、OneDriveまたはGoogledRiveからダウンロードされます。それらを$ {pose_root}/data/coco/にダウンロードまたはリンクして、次のように見せてください。

$ {POSE_ROOT}/data/coco/

| -- annotations

| |-- person_keypoints_train2017.json

| `-- person_keypoints_val2017.json

| -- person_detection_results

| |-- COCO_val2017_detections_AP_H_56_person.json

| `-- COCO_test-dev2017_detections_AP_H_609_person.json

`-- images

|-- train2017

| |-- 000000000009.jpg

| |-- ...

`-- val2017

|-- 000000000139.jpg

|-- ... python tools/test.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yaml TEST.USE_GT_BBOX Truepython tools/train.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yamlこれらの論文とそのオープンソースコードに感謝します:HRNET、DETR、DARKPOSE

このリポジトリは、MITライセンスの下でリリースされます。

このリポジトリが便利だと思う場合は、星を渡してください。または、私たちの仕事を引用することを検討してください。

@inproceedings{yang2021transpose,

title={TransPose: Keypoint Localization via Transformer},

author={Yang, Sen and Quan, Zhibin and Nie, Mu and Yang, Wankou},

booktitle={IEEE/CVF International Conference on Computer Vision (ICCV)},

year={2021}

}