ドキュメント|インストール| ?モデル動物園| ?ニュースを更新|進行中のプロジェクト| ?報告の問題

導入

MMDeTectionは、Pytorchに基づくオープンソースオブジェクト検出ツールボックスです。 OpenMMLabプロジェクトの一部です。

メインブランチは、Pytorch 1.8+で動作します。

主な機能

モジュラー設計

検出フレームワークを異なるコンポーネントに分解し、異なるモジュールを組み合わせてカスタマイズされたオブジェクト検出フレームワークを簡単に構築できます。

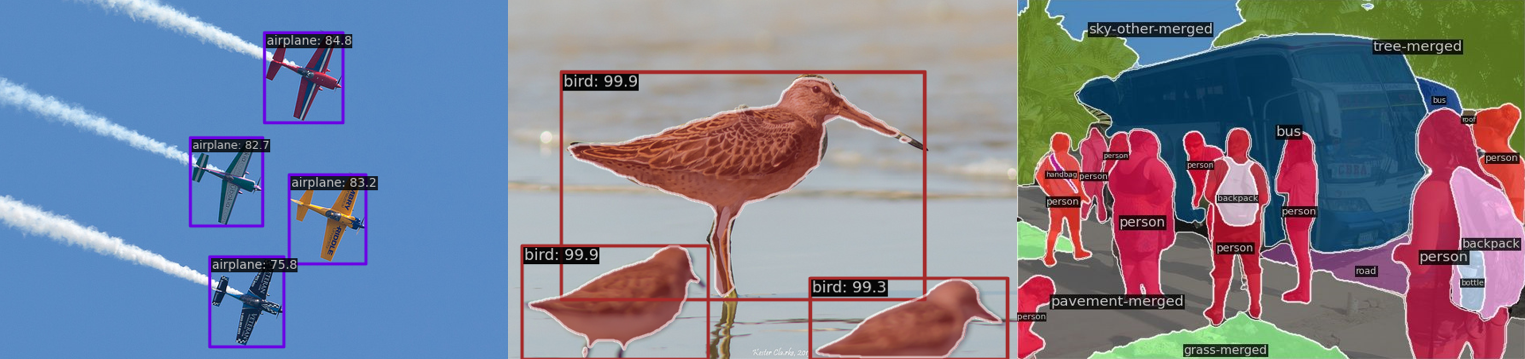

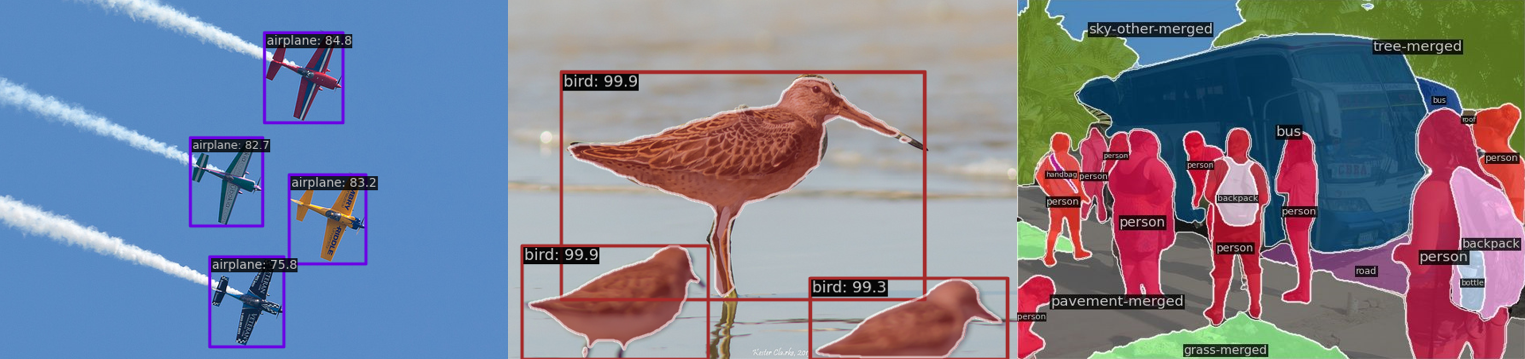

箱から出して複数のタスクのサポート

ツールボックスは、オブジェクト検出、インスタンスセグメンテーション、パノプティックセグメンテーション、半監視オブジェクト検出などの複数の検出タスクを直接サポートします。

高効率

すべての基本的なBボックスおよびマスク操作はGPUで実行されます。トレーニング速度は、Detectron2、MaskRCNNベンチマーク、SimpleDetなど、他のコードベースよりも高速であるか、他のコードベースに匹敵します。

最先端の

このツールボックスは、2018年にCoCo Detection Challengeを獲得したMMDETチームによって開発されたコードベースに由来し、それを前進させ続けます。新しくリリースされたRTMDETは、リアルタイムインスタンスのセグメンテーションと回転オブジェクト検出タスクと、オブジェクト検出に関する最良のパラメーターのアクセラシートレードオフで、新しい最先端の結果も取得します。

MMDeTectionとは別に、モデルトレーニング用のMMENGINEとコンピュータービジョン研究用のMMCVもリリースしました。これらはこのツールボックスに大きく依存しています。

新着情報

? MM-Grounding-Dino Swin-BとSwin-Lの事前に訓練された重量をリリースしました。

ハイライト

v3.3.0は2024年5月1日にリリースされました。

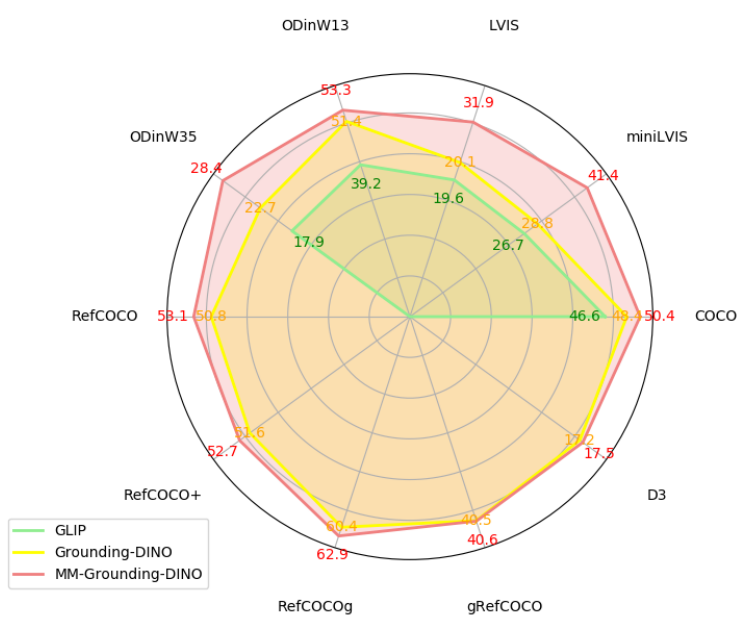

MM-Grounding-Dino:統合されたオブジェクトの接地と検出のためのオープンで包括的なパイプライン

接地ディノは、幅広い用途を使用して、2D開いた語彙オブジェクトの検出とフレーズの接地を統合する接地前のトレーニングモデルです。ただし、そのトレーニング部分はオープンソースではありません。したがって、MMグラウンドディノ型を提案します。これは、グラウンドディノのオープンソースレプリケーションバージョンとして機能するだけでなく、再構築されたデータタイプに基づいて大幅なパフォーマンス改善を達成し、さまざまなデータセットの組み合わせと初期化戦略を調査します。さらに、OOD、REC、フレーズの接地、OVD、微調整を含む複数の次元から評価を実施して、将来の作業にインスピレーションを提供することを望んで、事前トレーニングの接地の利点と短所を完全に発掘します。

コード:mm_grounding_dino/readme.md

完全に畳み込みのあるシングルステージ検出器のファミリーであるRTMDETに関するリアルタイムオブジェクト認識タスクに関する最新の作業を発表できることを楽しみにしています。 RTMDETは、小さなモデルサイズからエクストラレーグモデルサイズからエクストラレーグモデルのサイズまでのオブジェクト検出に関する最良のパラメーターのアクセラシートレードオフを達成するだけでなく、インスタンスセグメンテーションと回転したオブジェクト検出タスクで新しい最先端のパフォーマンスを取得します。詳細については、テクニカルレポートをご覧ください。事前に訓練されたモデルはこちらです。

| タスク | データセット | AP | FPS(TRT FP16 BS1 3090) |

|---|

| オブジェクトの検出 | ココ | 52.8 | 322 |

| インスタンスセグメンテーション | ココ | 44.6 | 188 |

| 回転したオブジェクト検出 | dota | 78.9(シングルスケール)/81.3(マルチスケール) | 121 |

インストール

インストール手順については、インストールを参照してください。

はじめる

mmdeTectionの一般的な導入については、概要をご覧ください。

詳細なユーザーガイドと高度なガイドについては、ドキュメントを参照してください。

ユーザーガイド

- トレーニングとテスト

- 構成について学びます

- 既存のモデルへの推論

- データセットの準備

- 標準データセットで既存のモデルをテストします

- 標準データセットで事前定義されたモデルを訓練します

- カスタマイズされたデータセットでトレーニングします

- カスタマイズされたモデルと標準データセットを備えたトレーニング

- Finetuningモデル

- テスト結果の提出

- 重量の初期化

- RPNとして単一のステージ検出器を使用します

- 半監視オブジェクトの検出

- 便利なツール

高度なガイド

また、オブジェクト検出コラブチュートリアルとインスタンスセグメンテーションコラブチュートリアルも提供しています。

MMDeTection 2.xから移行するには、移行を参照してください。

ベンチマークとモデル動物園の概要

結果とモデルは、モデル動物園で利用できます。

アーキテクチャ

| オブジェクトの検出 | インスタンスセグメンテーション | パノプティックセグメンテーション | 他の |

- 高速r-CNN(ICCV'2015)

- より速いR-CNN(Neurips'2015)

- RPN(Neurips'2015)

- SSD(ECCV'2016)

- Retinanet(ICCV'2017)

- Cascade R-CNN(CVPR'2018)

- Yolov3(arxiv'2018)

- cornernet(eccv'2018)

- Grid R-CNN(CVPR'2019)

- ガイド付きアンカー(CVPR'2019)

- FSAF(CVPR'2019)

- Centernet(CVPR'2019)

- Libra R-CNN(CVPR'2019)

- Tridentnet(ICCV'2019)

- FCOS(ICCV'2019)

- reptoints(ICCV'2019)

- FreeanChor(Neurips'2019)

- cascaderpn(Neurips'2019)

- Foveabox(Tip'2020)

- ダブルヘッドR-CNN(CVPR'2020)

- ATSS(CVPR'2020)

- NAS-FCOS(CVPR'2020)

- Centripetalnet(CVPR'2020)

- AutoAssign(arxiv'2020)

- 副次的な境界ローカリゼーション(ECCV'2020)

- 動的r-CNN(ECCV'2020)

- detr(eccv'2020)

- PAA(ECCV'2020)

- varifocalnet(cvpr'2021)

- スパースR-CNN(CVPR'2021)

- Yolof(CVPR'2021)

- Yolox(CVPR'2021)

- DERMORMABLE DETR(ICLR'2021)

- Tood(ICCV'2021)

- DDOD(ACM MM'2021)

- rtmdet(arxiv'2022)

- 条件付きdetr(ICCV'2021)

- DAB-DERT(ICLR'2022)

- ディノ(ICLR'2023)

- glip(cvpr'2022)

- DDQ(CVPR'2023)

- diffusiondet(arxiv'2023)

- EfficientDet(CVPR'2020)

- Vitdet(ECCV'2022)

- DETIC(ECCV'2022)

- Co-Detr(ICCV'2023)

| - マスクR-CNN(ICCV'2017)

- カスケードマスクr-CNN(CVPR'2018)

- マスクスコアリングR-CNN(CVPR'2019)

- ハイブリッドタスクカスケード(CVPR'2019)

- Yolact(ICCV'2019)

- Instaboost(ICCV'2019)

- ソロ(ECCV'2020)

- ポイントレンド(CVPR'2020)

- 検出器(arxiv'2020)

- solov2(neurips'2020)

- scnet(aaai'2021)

- QueryInst(ICCV'2021)

- mask2former(arxiv'2021)

- condinst(eccv'2020)

- SparseInst(CVPR'2022)

- rtmdet(arxiv'2022)

- BoxInst(CVPR'2021)

- Convnext-V2(arxiv'2023)

| - パノプティックFPN(CVPR'2019)

- maskformer(neurips'2021)

- mask2former(arxiv'2021)

- XdeCoder(CVPR'2023)

| 対照学習- swav(neurips'2020)

- Moco(CVPR'2020)

- mocov2(arxiv'2020)

蒸留- ローカリゼーション蒸留(CVPR'2022)

- ラベルの割り当て蒸留(WACV'2022)

半監視オブジェクトの検出 |

コンポーネント

| バックボーン | 首 | 損失 | 一般 |

- VGG(ICLR'2015)

- ResNet(CVPR'2016)

- resnext(cvpr'2017)

- Mobilenetv2(CVPR'2018)

- HRNET(CVPR'2019)

- 一般化された注意(ICCV'2019)

- GCNET(ICCVW'2019)

- RES2NET(TPAMI'2020)

- regnet(cvpr'2020)

- resnest(arxiv'2020)

- Pvt(ICCV'2021)

- Swin(CVPR'2021)

- pvtv2(arxiv'2021)

- Resnet Strikes Back(arxiv'2021)

- EfficientNet(arxiv'2021)

- Convnext(CVPR'2022)

- convnextv2(arxiv'2023)

| - PAFPN(CVPR'2018)

- NAS-FPN(CVPR'2019)

- カラフ(ICCV'2019)

- fpg(arxiv'2020)

- Groie(ICPR'2020)

- Dyhead(CVPR'2021)

| - GHM(aaai'2019)

- 一般化された局所損失(Neurips'2020)

- シーソーロス(CVPR'2021)

| - Ohem(CVPR'2016)

- グループ正規化(ECCV'2018)

- DCN(ICCV'2017)

- DCNV2(CVPR'2019)

- 重量標準化(ARXIV'2019)

- プライムサンプルの注意(CVPR'2020)

- 強いベースライン(CVPR'2021)

- Resnet Strikes Back(arxiv'2021)

|

MMDETectionを使用したプロジェクトでは、他のいくつかの方法もサポートされています。

よくある質問

よくある質問については、FAQを参照してください。

貢献

mmdeTectionを改善するためのすべての貢献に感謝します。進行中のプロジェクトは、Out Githubプロジェクトで見つけることができます。これらのプロジェクトに参加するコミュニティユーザーを歓迎します。貢献ガイドラインについては、converting.mdを参照してください。

了承

MMDeTectionは、さまざまな大学や企業の研究者やエンジニアによって提供されるオープンソースプロジェクトです。メソッドを実装したり、新機能を追加したりするすべての貢献者と、貴重なフィードバックを提供するユーザーに感謝します。ツールボックスとベンチマークは、既存の方法を再実装し、独自の新しい検出器を開発するための柔軟なツールキットを提供することにより、成長する研究コミュニティに役立つことを願っています。

引用

このツールボックスまたは研究でベンチマークを使用する場合は、このプロジェクトを引用してください。

@article{mmdetection,

title = {{MMDetection}: Open MMLab Detection Toolbox and Benchmark},

author = {Chen, Kai and Wang, Jiaqi and Pang, Jiangmiao and Cao, Yuhang and

Xiong, Yu and Li, Xiaoxiao and Sun, Shuyang and Feng, Wansen and

Liu, Ziwei and Xu, Jiarui and Zhang, Zheng and Cheng, Dazhi and

Zhu, Chenchen and Cheng, Tianheng and Zhao, Qijie and Li, Buyu and

Lu, Xin and Zhu, Rui and Wu, Yue and Dai, Jifeng and Wang, Jingdong

and Shi, Jianping and Ouyang, Wanli and Loy, Chen Change and Lin, Dahua},

journal= {arXiv preprint arXiv:1906.07155},

year={2019}

}

ライセンス

このプロジェクトは、Apache 2.0ライセンスの下でリリースされます。

OpenMMLabのプロジェクト

- MMENGINE:Deep LearningモデルをトレーニングするためのOpenMMLabファンデーションライブラリ。

- MMCV:Computer VisionのOpenMMLabファンデーションライブラリ。

- MMPRETRAIN:OpenMMLab事前トレーニングツールボックスとベンチマーク。

- MMAGIC:Open MM Lab A DVanced、 G EnerativeおよびI ntelligent C Reation Toolbox。

- MMDETECTION:OpenMMLAB検出ツールボックスとベンチマーク。

- MMDETECTION3D:一般的な3Dオブジェクト検出のためのOpenMMLabの次世代プラットフォーム。

- mmrotate:OpenMMLab回転オブジェクト検出ツールボックスとベンチマーク。

- Mmyolo:OpenMMLab Yoloシリーズのツールボックスとベンチマーク。

- MMSegemation:OpenMMLabセマンティックセグメンテーションツールボックスとベンチマーク。

- MMOCR:OpenMMLABテキストの検出、認識、および理解ツールボックス。

- MMOPSE:OpenMMLabは、推定ツールボックスとベンチマークをポーズします。

- MMHUMAN3D:OpenMMLab 3D Human Parametric Model Toolboxとベンチマーク。

- mmselfsup:openmmlab自己監視学習ツールボックスとベンチマーク。

- MMRAZOR:OpenMMLabモデル圧縮ツールボックスとベンチマーク。

- mmfewshot:Openmmlab少数の学習ツールボックスとベンチマーク。

- MMACTION2:OpenMMLabの次世代アクション理解ツールボックスとベンチマーク。

- MMTracking:OpenMMLabビデオ認識ツールボックスとベンチマーク。

- MMFLOW:OpenMMLab光フローツールボックスとベンチマーク。

- MDEMITITION:OpenMMLab画像とビデオ編集ツールボックス。

- MMGeneration:OpenMMLab画像およびビデオ生成モデルツールボックス。

- mmdeploy:openmmlabモデルの展開フレームワーク。

- MIM:MIMはOpenMMLabパッケージをインストールします。

- Mmeval:複数の機械学習ライブラリの統一された評価ライブラリ。

- 遊び場:OpenMMLabに基づいて構築された素晴らしいプロジェクトを集めて紹介するための中央のハブ。