adversarial robustness toolbox

ART 1.18.1

中文readme请按此处

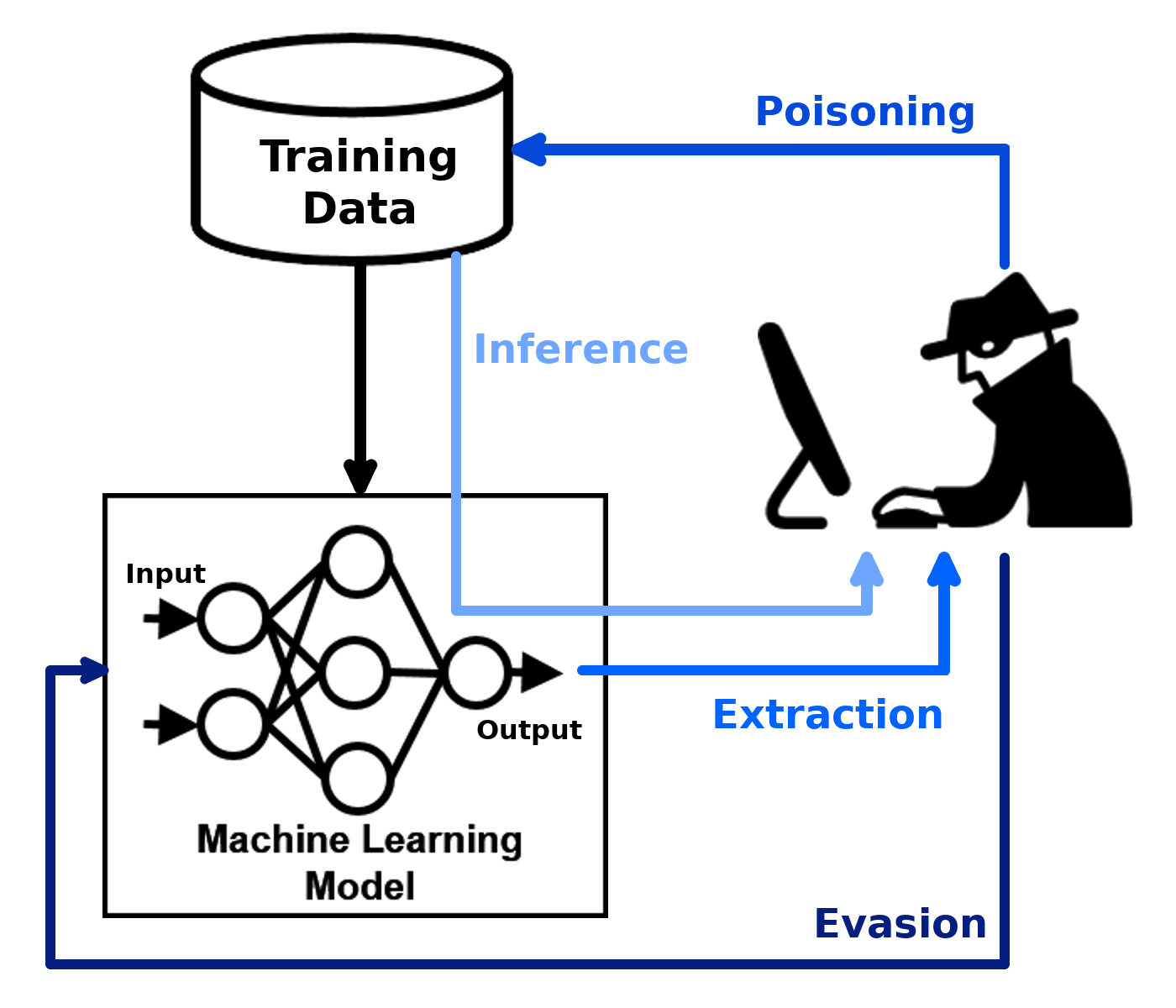

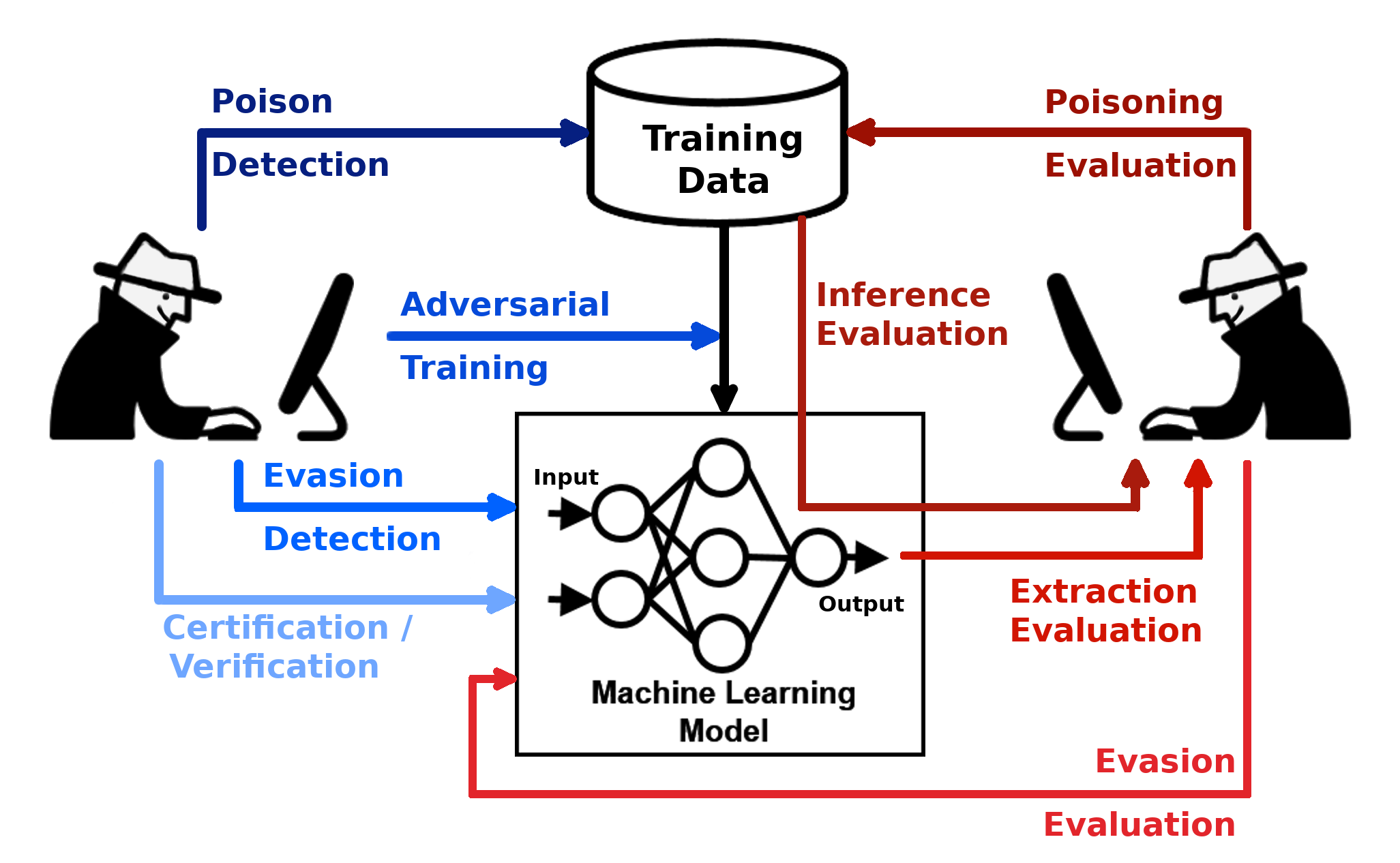

敵対的な堅牢性ツールボックス(ART)は、機械学習セキュリティのためのPythonライブラリです。 ARTは、Linux Foundation AI&Data Foundation(LF AI&Data)がホストしています。 ARTは、開発者と研究者が回避、中毒、抽出、推論の敵対的な脅威に対する機械学習モデルとアプリケーションを擁護および評価できるようにするツールを提供します。アートは、すべての人気のある機械学習フレームワーク(Tensorflow、Keras、Pytorch、MxNet、Scikit-Learn、Xgboost、LightGBM、CatBoost、GPYなど)、すべてのデータ型(画像、テーブル、オーディオ、ビデオなど)、および機械学習をサポートしています。タスク(分類、オブジェクト検出、音声認識、生成、認証など)。

| 始めましょう | ドキュメント | 貢献 |

|---|---|---|

| - インストール - 例 - ノートブック | - 攻撃 - 防御 - 推定器 - メトリック - 技術文書 | - スラック、招待状 - 寄稿 - ロードマップ - 引用 |

図書館は継続的な開発中です。フィードバック、バグレポート、貢献は大歓迎です!

この資料は、契約番号HR001120C0013に基づいて、防衛先進研究プロジェクト局(DARPA)がサポートする作業に部分的に基づいています。この資料で表明された意見、調査結果、結論、または勧告は著者のものであり、必ずしも防衛先進研究プロジェクト局(DARPA)の見解を反映しているわけではありません。