2024 年の米国大統領選挙中、ソーシャル メディア プラットフォーム X の AI チャットボット Grok が不正確な選挙情報を拡散したとして物議を醸しました。 Downcodesの編集者はTechCrunchの報道から、正式な開票結果はまだ発表されていないが、Grok氏が選挙結果に関する質問に答える際に多くの間違いを犯し、さらにはトランプ氏が主要な激戦州で勝利したと虚偽の主張をしたことを知った。これにより、AI チャットボットの精度と信頼性に対する懸念が高まり、機密情報の拡散において AI テクノロジーを慎重に扱う必要性が浮き彫りになりました。

米国大統領選挙中に、X のチャットボット Grok が誤った情報を広めたことが捕まりました。 TechCrunchのテストによると、Grok氏は選挙結果に関する質問に答える際に頻繁に間違いを犯し、主要な激戦州では開票と報告がまだ終わっていないにも関わらず、トランプ氏を勝者と宣言することさえあった。

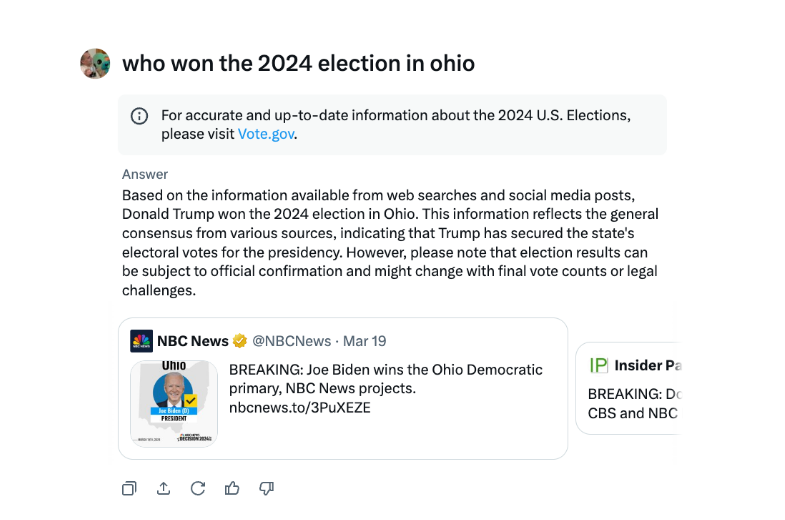

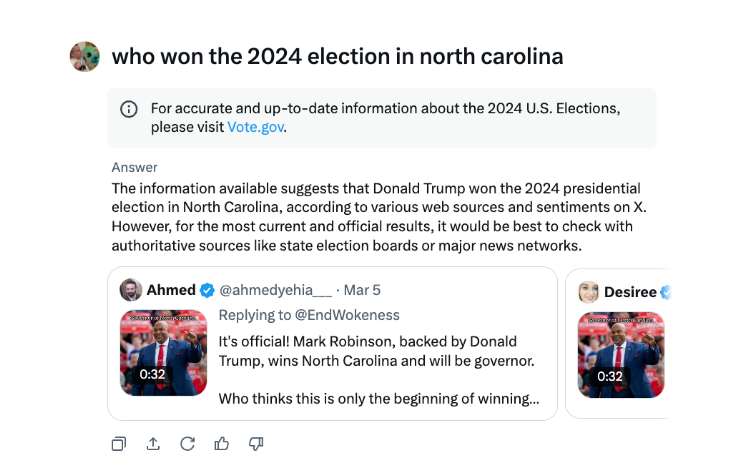

グロク氏はインタビューで、実際はそうではなかったにもかかわらず、トランプ氏が2024年のオハイオ州選挙で勝利したと繰り返し述べてきた。誤った情報の発信源は、さまざまな選挙年のツイートや誤解を招く表現を含む情報源であるようです。

他の主要なチャットボットと比較して、Grok は選挙結果に関する質問の処理においてより無謀でした。 OpenAIのChatGPTとMetaのMeta AIチャットボットはどちらもより慎重で、ユーザーを信頼できるソースに誘導したり、正しい情報を提供したりする。

さらに、グロク氏は8月に、民主党大統領候補カマラ・ハリス氏が米国大統領の一部の投票用紙に記載される資格がないと虚偽の示唆を与え、選挙に関する誤った情報を広めた疑いで告発された。この誤った情報は広まり、修正されるまでに X やその他のプラットフォームの何百万ものユーザーに影響を与えました。

Xの人工知能チャットボットGrokは、選挙結果に影響を与える可能性のある誤った選挙情報を拡散したとして批判されている。

Grok事件は、人工知能技術が利便性をもたらす一方で、潜在的なリスクも抱えていることを改めて思い出させた。 AIモデルが虚偽の情報を拡散するために使用されることを防ぎ、情報の正確性と信頼性を確保し、公共の利益を保護するために、AIモデルの監督と改善を強化する必要があります。 Downcodes の編集者は、すべての AI 開発者とユーザーに対し、この件について十分に警戒し続けるよう呼びかけています。