OpenAIの中国副社長ウェン・リー氏が退社するというニュースは、広く注目を集めた。人工知能の分野で多大な貢献を果たしたこの女性リーダーのキャリアの軌跡と、OpenAIへの貢献について、Downcodes編集者が詳しく解説します。 OpenAI での 6 年間、Weng Li は深層強化学習からモデル セキュリティに至るまで、数多くの重要なプロジェクトに参加し、人工知能テクノロジーの開発に忘れられない貢献をしました。彼女が提案した公式「エージェント = 大規模モデル + メモリ + アクティブな計画 + ツールの使用」は、AI 研究に重要な理論的裏付けを提供します。

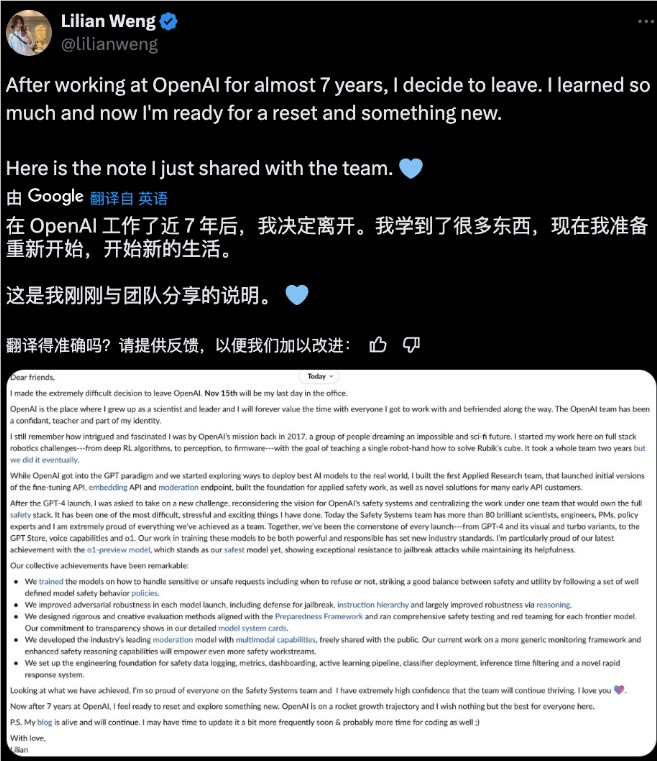

最近、OpenAIの中国副社長ウェン・リー氏が11月15日に正式に辞任すると発表した。 Weng Li は北京大学を卒業し、OpenAI セキュリティ システム チームの責任者であり、ChatGPT の重要な貢献者の 1 人でした。

彼女は 2018 年に OpenAI に入社し、GPT-4 を含む多くの重要なプロジェクト、特にモデルのセキュリティ、事前トレーニング、強化学習の側面に参加しました。

ウェン・リーはキャリアの中で、「エージェント = 大規模モデル + メモリ + アクティブな計画 + ツールの使用」という有名な公式を提案しました。これは、AI の研究と応用に重要な理論的裏付けを提供しました。 Weng Lizeng 氏は、2024B Station Super Science Night イベントで「AI の安全性とトレーニング」に関する基調講演を行い、幅広い注目と議論を集めました。

ウェン・リー氏は辞表の中で、OpenAIへの感謝の意を表明し、会社での自身の成長プロセスを振り返った。彼女は、OpenAI に初めて参加したときは好奇心と熱意に満ちていたと述べ、深層強化学習アルゴリズムからロボットの課題に至るまで、複数のプロジェクトに参加し、チームの共同作業によりロボットにルービック キューブを解くよう教えることに成功しました。彼女はまた、現実世界における AI モデルの適用を検討する際に、最初のアプリケーション研究チームを設立し、その後のセキュリティ作業の基礎を築いたと述べました。

彼女のリーダーシップの下、OpenAI のセキュリティ システム チームは成長を続け、現在 80 名を超える優れた科学者やエンジニアが所属しています。 Weng Li 氏は、AI の安全性におけるチームの成果、特に新しくリリースされた o1 プレビュー モデルが優れた安全性と実用性を示していることを誇りに思っています。セキュリティ テストとレッド チーム テストにおけるチームに対する彼女の厳しい要件により、モデルの堅牢性と透明性が保証されます。

OpenAI を離れるものの、ウェン・リー氏はブログの更新を続け、プログラミングと執筆にもっと時間を費やすことを楽しみにしていると述べた。彼女の退職は多くの同僚の祝福を集めましたが、これは彼女の個人的なキャリアの新たな出発点となっただけでなく、OpenAI セキュリティ ディレクターという重要なポストに新しい候補者が迎えられることを意味しました。

ウェン・リー氏の辞任は残念だが、人工知能分野における彼女の貢献は永遠に歴史に残るだろう。今後の彼女のさらなる活躍を期待しています! Downcodes の編集者は今後も彼女の最新動向に注目し、読者にさらにエキサイティングなレポートをお届けしていきます。