メタ AI 研究者は、ビデオ拡散トランスフォーマー モデル (DiT) の推論速度を高速化するために設計された、AdaCache と呼ばれるトレーニング不要のメソッドを提案しました。 DiTs はビデオ生成の分野では優れたパフォーマンスを発揮しますが、モデル サイズが大きく、アテンション メカニズムが複雑なため、推論速度が遅くなり、応用が制限されます。 AdaCache は、計算結果をキャッシュし、各ビデオのキャッシュ戦略をカスタマイズすることで、「すべてのビデオが同じではない」という事実を巧みに利用し、生成品質を確保しながら推論効率を大幅に向上させます。 Downcodes の編集者がこのテクノロジーについて詳しく説明します。

高品質で時間の連続するビデオを生成するには、特に長期間の場合に大量の計算リソースが必要です。最新の拡散トランスフォーマー モデル (DiT) はビデオ生成において大幅な進歩を遂げていますが、大規模なモデルとより複雑なアテンション メカニズムに依存しているため、推論が遅くなり、この課題はさらに悪化しています。この問題を解決するために、Meta AI の研究者は、ビデオ DiT を高速化する AdaCache と呼ばれるトレーニング不要の方法を提案しました。

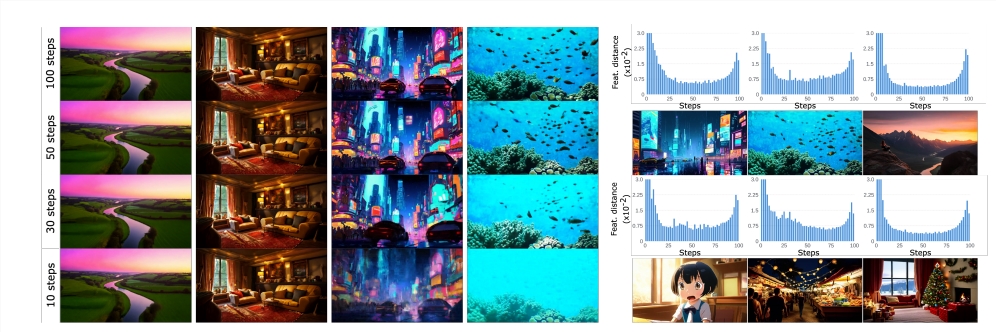

AdaCache の中心的な考え方は、「すべてのビデオが同じではない」という事実に基づいています。これは、一部のビデオは、妥当な品質を達成するために他のビデオよりも少ないノイズ除去ステップを必要とすることを意味します。 これに基づいて、この方法は拡散プロセス中に計算結果をキャッシュするだけでなく、ビデオ世代ごとにカスタマイズされたキャッシュ戦略を設計することで、品質と遅延の間のトレードオフを最大化します。

研究者らはさらに、AdaCache 内のビデオ情報を使用して、モーションの内容に応じてコンピューティング リソースの割り当てを制御するモーション正則化 (MoReg) スキームを導入しました。 高周波テクスチャと大量のモーション コンテンツを含むビデオ シーケンスは、妥当な品質を達成するためにより多くの拡散ステップを必要とするため、MoReg は計算リソースをより適切に割り当てることができます。

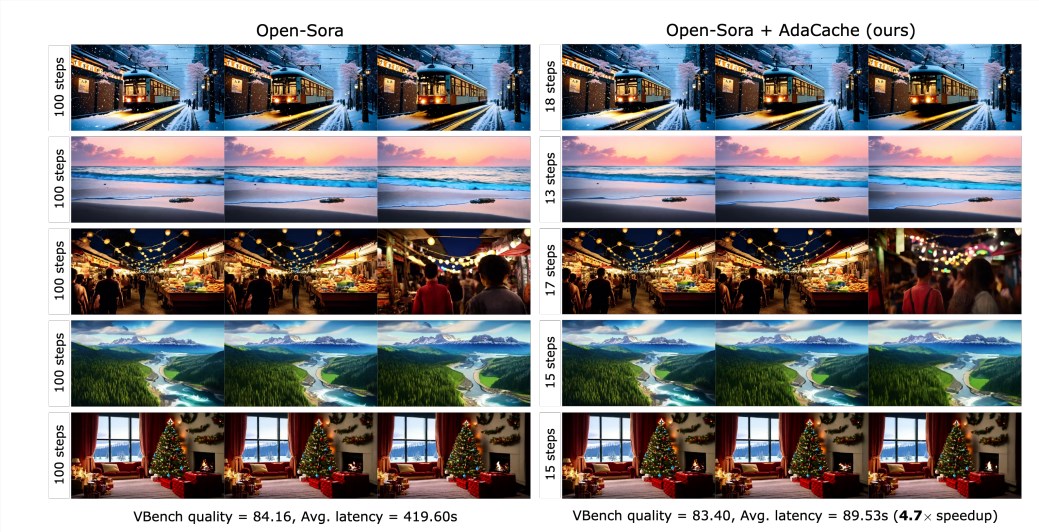

実験結果は、AdaCache が生成品質を犠牲にすることなく、推論速度を大幅に向上できる (たとえば、Open-Sora720p-2s ビデオ生成で最大 4.7 倍の高速化) ことができることを示しています。 さらに、AdaCache は優れた一般化機能も備えており、Open-Sora、Open-Sora-Plan、Latte などのさまざまなビデオ DiT モデルに適用できます。 AdaCache は、Δ-DiT、T-GATE、PAB などのトレーニング不要の他の高速化方法と比較して、速度と品質の両方で大きな利点を提供します。

ユーザー調査によると、ユーザーは他の方法よりも AdaCache で生成されたビデオを好み、その品質がベースライン モデルと同等であると考えています。 この研究は、AdaCache の有効性を確認し、効率的なビデオ生成の分野に重要な貢献をします。 Meta AI は、AdaCache が広く使用され、高忠実度の長時間ビデオ生成の普及を促進できると考えています。

論文: https://arxiv.org/abs/2411.02397

プロジェクトのホームページ:

https://adacache-dit.github.io/

GitHub:

https://github.com/AdaCache-DiT/AdaCache

全体として、AdaCache は効率的なビデオ生成のための斬新で効果的な方法を提供し、そのパフォーマンスの大幅な向上と優れたユーザー エクスペリエンスにより、将来のアプリケーションに大きな可能性をもたらします。 Downcodes の編集者は、AdaCache の登場により、高忠実度の長時間ビデオ生成のさらなる発展が促進されると考えています。