Meta AI は、SPIRIT LM と呼ばれる基本的なマルチモーダル言語モデルを衝撃的にリリースしました。これは、テキストと音声を自由に組み合わせることができる画期的な成果です。これは、70 億のパラメーターを備えた事前トレーニング済みのテキスト言語モデルに基づいており、継続的なトレーニングを通じて音声モードまで拡張され、テキストと音声のデュアルモーダル理解と生成を実現し、さらに 2 つを混合することもでき、アプリケーションに予期せぬ効果をもたらします。 Downcodes のエディターでは、SPIRIT LM の強力な機能とその背後にある技術的進歩について深く理解することができます。

Meta AI は最近、SPIRIT LM と呼ばれる基本的なマルチモーダル言語モデルをオープンソース化しました。これはテキストと音声を自由に組み合わせることができ、オーディオとテキストのマルチモーダル タスクの新たな可能性を開きます。

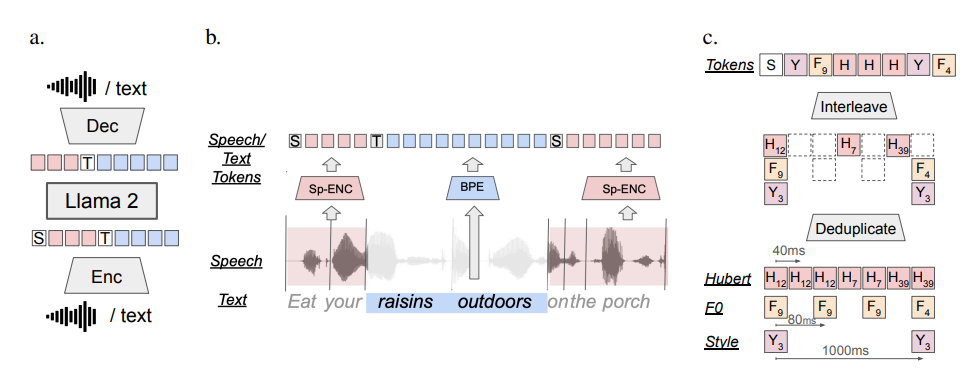

SPIRIT LM は、70 億パラメータの事前トレーニングされたテキスト言語モデルに基づいており、テキストおよび音声単位の継続的なトレーニングを通じて音声モダリティまで拡張されます。大きなテキスト モデルのようにテキストを理解して生成することもできます。また、音声を理解して生成することもできます。たとえば、音声認識に使用したり、音声を次のように変換したりできます。テキストを音声に変換する音声合成にも使用でき、音声がどのような感情を表現しているかを判断する音声分類にも使用できます。

さらに強力なのは、SPIRIT LM は「感情表現」にも特に優れているということです。さまざまな声のイントネーションやスタイルを認識して生成し、AI の声をより自然で感情的に聞こえるようにします。 SPIRIT LM によって生成される声は、もはや冷たい機械の声ではなく、喜び、怒り、悲しみ、喜びに満ちた生身の人間が話しているようなものであることが想像できます。

AI をより「感情的」にするために、メタ研究者は SPIRIT LM の 2 つのバージョンを特別に開発しました。

「基礎編」(BASE):音声の「基本構成」である音声の音素情報を中心としたバージョンです。

「Expressive バージョン」 (EXPRESSIVE): このバージョンでは、音素情報に加えて、トーンとスタイル情報も追加され、AI の音声をより鮮明で表現力豊かにすることができます。

では、SPIRIT LM はどのようにしてこれらすべてを行うのでしょうか?

簡単に言えば、SPIRIT LM は、以前に Meta によってリリースされた超強力なテキスト大規模モデルである LLAMA2 に基づいてトレーニングされています。 研究者らは、大量のテキストと音声データをLLAMA2に「供給」し、LLAMA2がテキストと音声のルールを同時に学習できるように特別な「インターリーブトレーニング」方法を採用した。

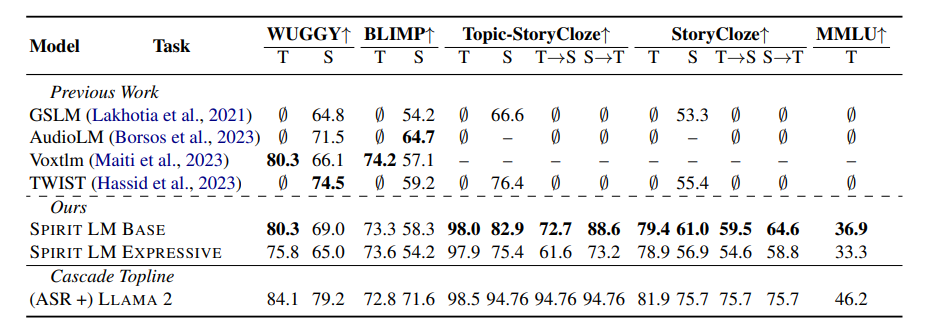

SPIRIT LM の「感情表現」能力をテストするために、メタ研究者は新しいテスト ベンチマークである「音声テキスト感情保持ベンチマーク」(STSP) も設計しました。 このテストベンチマークには、AI モデルが対応する感情を伴う音声とテキストを正確に認識して生成できるかどうかをテストするために、さまざまな感情を表現するさまざまな音声とテキストのプロンプトが含まれています。 結果は、SPIRIT LM の「表現バージョン」が感情保持において優れたパフォーマンスを発揮し、現在モダリティを超えて感情情報を保持できる最初の AI モデルであることを示しています。

もちろん、メタ研究者らも、SPIRIT LMにはまだ改善の余地が多くあることを認めました。 たとえば、SPIRIT LM は現在英語のみをサポートしており、将来的には他の言語にも拡張する必要がある; SPIRIT LM のモデル規模は十分に大きくなく、引き続きモデル規模を拡大し、モデルのパフォーマンスを向上させる必要がある未来。

SPIRIT LM は、AI 分野における Meta の大きな進歩であり、「サウンドとエモーショナル」な AI の世界への扉を開きます。 近い将来、AI が雄弁に話すだけでなく、本物の人間のように感情を表現し、私たちとより自然で心のこもったコミュニケーションを取れるように、SPIRIT LM に基づいて開発されたさらに興味深いアプリケーションが登場すると信じています。

プロジェクトアドレス: https://speechbot.github.io/spiritlm/

論文アドレス: https://arxiv.org/pdf/2402.05755

全体として、SPIRIT LM のオープンソースは、マルチモーダル AI の分野に刺激的な進歩をもたらしました。その出現は、AI が将来、音声インタラクションと感情表現において大きな進歩を遂げることを予告しています。この分野に注目してください。最新ニュースにご期待ください。