最近、AI 大手の Google と OpenAI の間の競争が激化しており、両者は大規模な言語モデルの開発と反復速度で激しく競い合っています。 Google が新しくリリースした Gemini-Exp-1121 モデルは、多くの重要な指標で OpenAI の GPT-4o を上回り、再び AI 競争でトップの座を占めました。 Downcodes の編集者は、AI 分野におけるこの「電撃」と、両者間のテクノロジーと機能の最新の進歩について深く理解することができます。

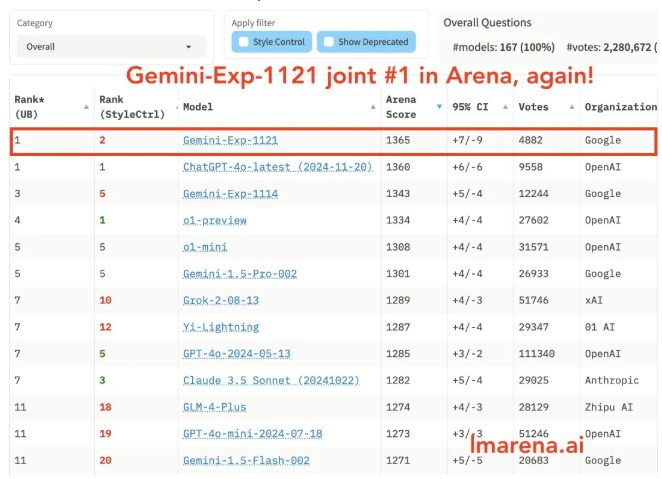

最近、Google と OpenAI の間の競争が再び激化しています。新しいバージョンの GPT-4o が AI 競争リストのトップに立ったわずか 1 日後、Google は最新の実験モデル Gemini-Exp-1121 を発売し、すぐにチャンピオンシップを取り戻しました。ちょうど 1 週間前、Google は Gemini-Exp-1114 をリリースしました。これは、Google が OpenAI のダイナミクスに非常に迅速に対応したことを示しているようです。

Google DeepMind の主任科学者であるジャック・レイ氏は、これは「電撃」であり、トレーニング後の反復速度がトレーニング前よりも速いことを示唆していると述べた。

公式情報によると、Gemini-Exp-1121 は多くの点で大幅に改良されており、主にコーディング機能、推論機能、視覚的理解機能の強化に反映されています。また、複雑なプロンプトワードのスタイル制御においても、現行最上位のo1-previewやNew Sonnet3.5に匹敵するレベルに達しています。

実際のテストでは、Gemini-Exp-1121 は、漫画の理解の処理においても GPT-4o の新バージョンよりも優れたパフォーマンスを示し、その回答はより包括的であり、情報を提示するために字幕と太字の強調を明確に使用することができました。古典的などうぶつの森の論理的推論の問題では、Gemini-Exp-1121 の答えは完全に正しく、より強力な論理的推論能力を示しました。一方、新しいバージョンの GPT-4o にはいくつかの間違いがありました。

同時に、OpenAI は新機能の開発にも積極的に取り組んでおり、最近、ChatGPT の最新バージョンで「ライブ カメラ」ビデオ機能のコードが発見され、音声認識と視覚認識の進歩が示されました。 OpenAI ユーザーも、Advanced Speech Mode を使用するときに初めてこの機能を体験し、将来的にこの機能の使用を拡大する意向を示しています。

来年、チャットボットを使用した主なコミュニケーション方法は、従来のテキスト対話から音声およびよりインテリジェントなエージェント サービスに徐々に移行すると予測されます。この変化は、「ライブ カメラ」機能の開始によって引き起こされる可能性があります。

この AI 競争は現在も続いており、Google と OpenAI が互いに追い求めています。これは、AI テクノロジーが今後も画期的な進歩と革新を続け、ユーザーにより便利でスマートなサービスを提供することを示しています。最後に誰が勝つのか楽しみに待ちましょう!