Alibaba International AI Team が最近リリースした Marco-o1 推論モデルは、オープンエンド問題の解決に焦点を当て、標準的な回答フィールドに限定されている従来のモデルの限界を突破し、複雑で定量化が難しいタスクの処理における可能性を実証しています。 。 Downcodes のエディターを使用すると、このモデルの特性、アプリケーション、使用法、および人工知能の分野にもたらす革新を深く理解できます。

アリババ国際 AI チームは最近、Marco-o1 と呼ばれる新しい推論モデルをリリースしました。これは、未解決の問題の解決に特に注意を払い、プログラミングや数学などの標準的な答えがある分野に限定されません。研究チームは、このようなモデルを、定量化が難しく、明確な報酬が得られない領域に効果的に一般化できるかどうかの探求に取り組んでいます。

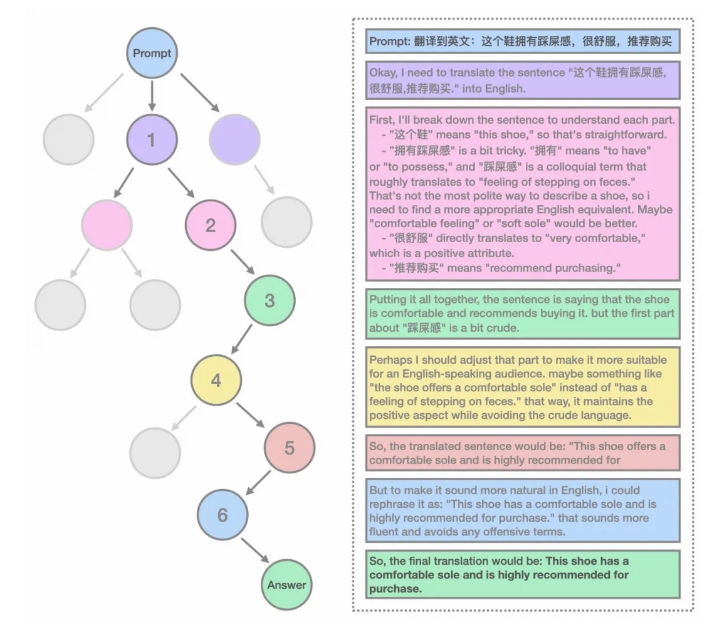

Marco-o1 モデルの特徴としては、超長 CoT データを使用した微調整、MCTS を使用した解空間の拡張、およびきめ細かい解空間の拡張が挙げられます。このモデルは、セルフプレイ + MCTS を使用して、反映および修正機能を備えた超長い CoT データのバッチを構築し、他のオープンソース データと一緒にトレーニングされます。さらに、研究チームは、モデルの解空間をさらに拡張し、モデルがより良い答えを出力するように導くために、ミニステップも定義しました。

翻訳タスクでは、Marco-o1 モデルが長くて難しい文の翻訳を処理できる能力を実証しました。これは、機械翻訳タスクに推論時間の延長が適用されたのは初めてです。研究チームは、一部の CoT データと現在の最良のモデルをオープンソース化しており、将来的にはさらに多くのデータとモデルをオープンソース化する予定です。

モデルは推論するときに応答を深く考えます。たとえば、「strawberry」という単語の「r」の数を出力する場合、モデルは単語内の各文字を徐々に分解して比較し、最終的には正しく結果を出力します。機械翻訳の分野では、モデルは推論リンクを通じて困難な点を正確に特定し、単語ごとに翻訳するため、全体的な翻訳精度が向上します。

研究チームは他の分野でもこのモデルを試し、他の一般的な現実の問題を解決するモデルの能力を証明しました。 Marco-o1 の全体的な構造は、セルフプレイ + MCTS を使用して、反映および修正する機能を備えた超長い CoT データのバッチを構築し、他のオープンソース データと一緒にトレーニングします。研究チームはまた、モデルの指示遵守機能を向上させるために、MarcoPolo ファミリーのいくつかの指示遵守データセットを組み込みました。

使用方法に関しては、研究チームは推論コードと微調整コードを提供しており、ユーザーはモデルとトークナイザーを簡単にロードして、チャットやモデルの微調整を開始できます。さらに、ModelScope の GGUF バージョンでモデルを直接実行することもできるため、より迅速にモデルを体験できます。

Marco-o1 モデルのリリースは、アリババの国際 AI チームが推論モデルの分野で講じた重要な一歩を示し、未解決の問題を解決するための新しいアイデアとツールを提供します。

モデルスコープ:

https://modelscope.cn/models/AIDC-AI/Marco-o1

アルクシヴ:

https://arxiv.org/abs/2411.14405

ギットハブ:

https://github.com/AIDC-AI/Marco-o1

抱き合う顔:

https://huggingface.co/AIDC-AI/Marco-o1

Marco-o1 モデルのオープンソースは研究者や開発者に貴重なリソースを提供し、将来的にはこのモデルに基づくさらに革新的なアプリケーションが登場し、人工知能技術の継続的な開発が促進されると考えられています。 Marco-o1のさらなる活用事例や研究成果を楽しみにしています!