Downcodes のエディターでは、従来のビデオ編集を覆す Google の革新的なテクノロジーである ReCapture について学習します。このテクノロジーにより、ユーザーはプロレベルのカメラの動きの調整を簡単に実現でき、キャプチャしたビデオのレンズ言語を再定義し、初心者でもビデオ編集を簡単に始めることができます。これによりビデオの作成方法はどのように変わるのでしょうか? ReCapture の謎を一緒に探ってみましょう。

Google 研究チームが発表した最新の ReCapture テクノロジーは、従来のビデオ編集方法を覆しています。この革新により、一般のユーザーはプロレベルのカメラの動きの調整を簡単に実装し、すでに撮影されたビデオのレンズ言語を再設計できるようになります。

従来のビデオ ポストプロダクションでは、キャプチャしたビデオのカメラ アングルを変更することが常に技術的な問題でした。既存のソリューションがさまざまなタイプのビデオ コンテンツを処理する場合、複雑なカメラの動きの効果と画像の詳細を同時に維持することが困難なことがよくあります。 ReCapture は異なるアプローチを採用し、従来の 4D 中間表現方法を使用せず、代わりに、生成ビデオ モデルに保存されたモーションの知識を巧みに使用し、安定したビデオの拡散を通じてタスクをビデオからビデオへの変換プロセスとして再定義します。

このシステムでは 2 段階のワークフローが使用されます。最初のステージでは、新しいカメラ位置を使用した初期出力バージョンであるアンカー ビデオを生成します。この段階は、CAT3D などの拡散モデルを通じてマルチアングル ビデオを作成するか、フレームごとの深度推定と点群レンダリングによって達成できます。このバージョンにはタイミングの不一致や視覚的な欠陥がある可能性がありますが、フェーズ 2 の基礎を築きました。

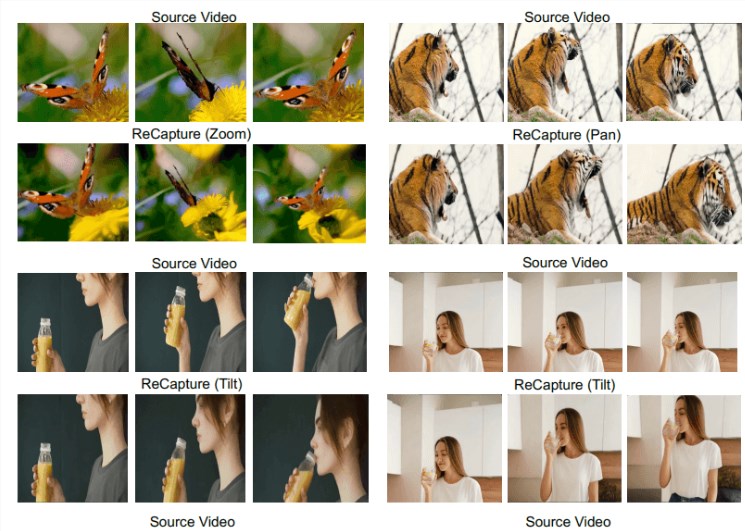

第 2 段階では、マスクされたビデオの微調整を適用し、既存の映像でトレーニングされた生成ビデオ モデルを活用して、リアルなモーション エフェクトとタイミングの変更を作成します。このシステムは、モデル全体を再トレーニングすることなくアンカー ビデオの特定の動的特性を理解して複製できるように、モデルを最適化する時間的 LoRA (Low Rank Adaptation) レイヤーを導入します。同時に、空間 LoRA レイヤーにより、画像の詳細とコンテンツが新しいカメラの動きと一致することが保証されます。これにより、生成ビデオ モデルは、元のビデオの特徴的な動きを維持しながら、ズーム、パン、チルトなどの操作を完了できます。

ReCapture は、ユーザーフレンドリーなビデオ処理において重要な進歩を遂げましたが、まだ研究段階にあり、商用応用にはまだ程遠いです。 Googleは多くのビデオAIプロジェクトを抱えているが、その中でVeoプロジェクトが最も商業利用に近いプロジェクトである可能性があることは注目に値する。同様に、Meta が最近発売した Movie-Gen モデルや、今年初めにリリースされた OpenAI の Sora もまだ商品化されていません。現在、ビデオ AI 市場は、昨年夏に最新の Gen-3Alpha モデルを発売した Runway などのスタートアップ企業が主に主導しています。

ReCapture テクノロジーの出現は、ビデオ編集の分野に革命をもたらします。まだまだ研究開発段階ではありますが、その強力な機能と便利な操作方法は、今後の映像制作に無限の可能性をもたらしてくれることは間違いありません。 Downcodes の編集者は、今後もこのテクノロジーの進歩に注目し、さらに関連するレポートをお届けしていきます。