OpenAI の研究者は、マルチメディア コンテンツの生成速度の画期的な進歩を達成する優れた連続時間整合性モデル (sCM) をリリースしました。これは、従来の拡散モデルよりも 50 倍速く画像を生成し、0.1 秒未満で画像を生成できます。この研究は Lu Cheng と Yang Song の共著で、論文はまだ査読されていませんが、その潜在的な影響は大きく、リアルタイム生成 AI の大きな飛躍を予告しています。アプリケーション。 Downcodes のエディターを使用すると、sCM モデルの革新性と将来のアプリケーションの見通しを深く理解できます。

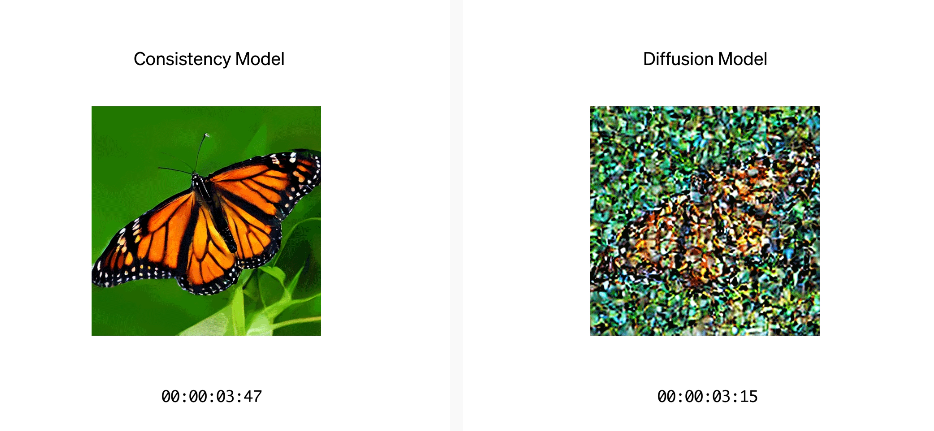

最近、OpenAI の研究者は、新しい連続時間整合性モデル (sCM) を導入する刺激的な研究結果を発表しました。このモデルは、マルチメディアコンテンツ(画像、動画、音声など)の生成速度を従来の普及モデルに比べて50倍と大幅に高速化しました。具体的には、sCM は 0.1 秒未満で画像を生成できますが、従来の拡散モデルでは 5 秒以上かかることがよくあります。

この技術により、研究チームはわずか 2 回のサンプリング手順で高品質のサンプルを生成することに成功しました。この革新により、サンプルの品質を犠牲にすることなく、生成プロセスがより効率的になりました。この記事は OpenAI の 2 人の研究者、Lu Cheng と Yang Song によって共同執筆され、arXiv.org で公開されましたが、まだ査読されていませんが、その潜在的な影響を過小評価することはできません。

Yang Song 氏は、2023 年の論文で初めて「一貫性モデル」の概念を提案し、sCM 開発の基礎を築きました。拡散モデルはフォトリアリスティックな画像、3D モデル、オーディオ、ビデオの生成には優れていますが、サンプリングの効率があまり高くなく、多くの場合数十から数百のステップが必要となるため、リアルタイム アプリケーションでは実用的ではありません。

サンプリングが高速化

sCM モデルの最大のハイライトは、計算負荷を増加させることなく、より高速なサンプリング速度を実現できることです。 OpenAI の最大の sCM モデルには 15 億のパラメータがあり、A100 GPU ではサンプル生成時間はわずか 0.11 秒です。これにより、拡散モデルと比較して実測時間が 50 倍高速化され、リアルタイム生成 AI アプリケーションの実現可能性が高まります。

必要なコンピューティング リソースが少なくて済む

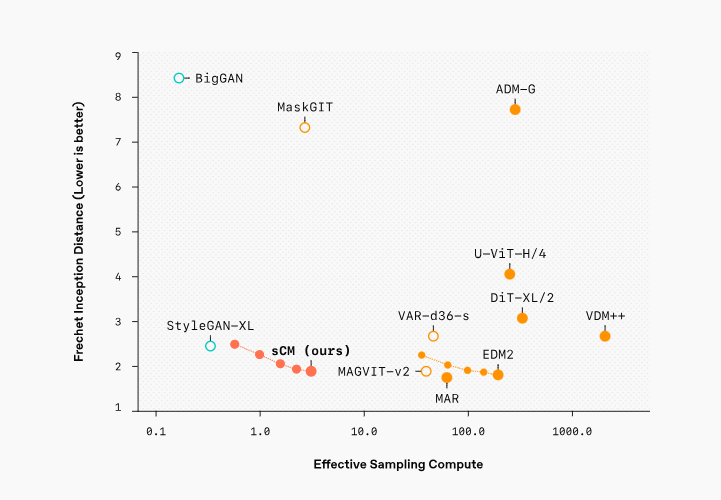

サンプル品質の点では、sCM は ImageNet 512×512 データセットでトレーニングされ、Fréchet Inception Distance (FID) スコア 1.88 を達成しました。これは、最上位の拡散モデルとの差が 10% 未満です。研究チームは、他の高度な生成モデルに対する広範なベンチマークを通じて、sCM が計算オーバーヘッドを大幅に削減しながら最高の結果を提供することを実証しました。

将来的には、sCM モデルの迅速なサンプリングとスケーラビリティにより、複数の分野でリアルタイム生成 AI アプリケーションの新たな可能性が開かれるでしょう。画像生成からオーディオとビデオの合成まで、sCM は高速で高品質の出力のニーズに対する実用的なソリューションを提供します。同時に、OpenAI の研究は、システムをさらに最適化する可能性も示唆しており、これにより、さまざまな業界のニーズに応じてモデルのパフォーマンスが向上する可能性があります。

公式ブログ: https://openai.com/index/simplifying-stabilizing-and-scaling-continuous-time-consistency-models/

論文: https://arxiv.org/html/2410.11081v1

sCM モデルの登場は、AI 画像生成の分野における大きな進歩を示しています。その効率的なサンプリング速度と高品質の出力により、リアルタイム アプリケーションの新たな章が開かれ、将来の発展の可能性は無限であり、期待に値します。