Downcodes のエディターは、ビデオ作成を破壊するテクノロジーである MotionClone について学習します。 AI の波が世界を席巻する中、テキスト生成ビデオはもはや遠い夢ではありません。ただし、動きを正確にキャプチャして再現する方法は、この分野では常に技術的なボトルネックでした。 MotionClone は、参照ビデオを巧みに使用してモーションを複製し、それを新しいテキストの説明にシームレスに適用して、素晴らしいビデオ コンテンツを生成します。このテクノロジーは従来の手法の限界を打ち破り、ビデオ作成に革命的な変化をもたらします。その背後にある技術的な謎を探ってみましょう。

デジタル コンテンツ作成の分野では、テキストの説明に基づいてビデオを生成できる技術が常に注目されています。リファレンス ビデオからモーションを複製し、それを新しいテキストの説明にシームレスに適用して、まったく新しいビデオ コンテンツを作成できたら、どんなに素晴らしいでしょう。これは MotionClone テクノロジーが達成する奇跡です。

既存のテキストからビデオへの (T2V) 生成モデルは一定の進歩を遂げていますが、アクション合成においては依然として課題に直面しています。従来の方法では、アクション キューをエンコードするためにモデルのトレーニングや微調整が必要になることがよくありますが、これらの方法は、目に見えないアクション タイプを扱う場合、パフォーマンスが低下することがよくあります。

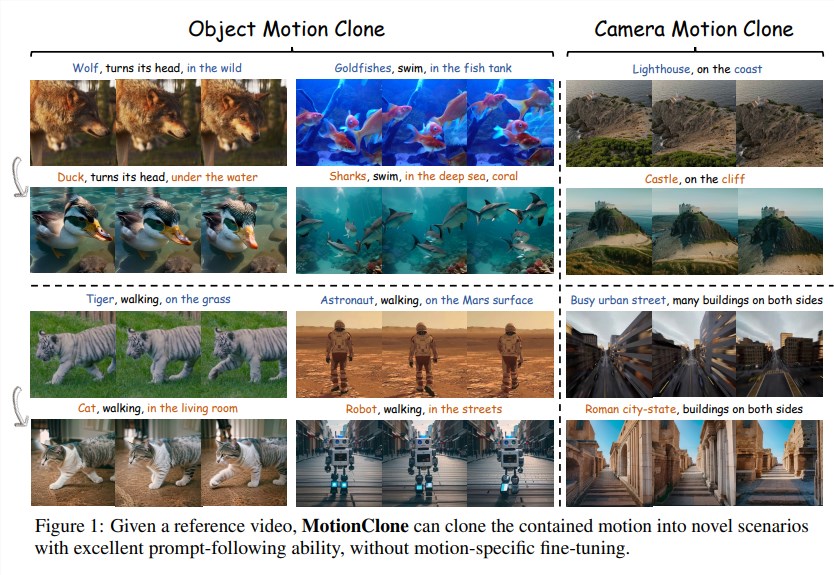

MotionClone は、参照ビデオからアクションを直接複製してテキストからビデオへの生成を制御する、トレーニング不要のフレームワークを提案します。このフレームワークは、時間的注意メカニズムを利用して参照ビデオ内のアクションをキャプチャし、一次時間的注意ガイダンスを導入して、注意の重みに対するノイズや小さな動きの影響を軽減します。さらに、生成モデルが合理的な空間関係を合成し、手がかりに従う能力を強化できるようにするために、研究者らは位置を認識した意味論的ガイダンス メカニズムを提案しました。

技術的なハイライト:

時間的注意メカニズム: ビデオ反転を通じて参照ビデオ内のアクションを表現します。

主要な時間的注意ガイダンス: 時間的注意の重みの主要コンポーネントのみが、アクションガイド付きビデオ生成に使用されます。

位置を意識したセマンティック ガイダンス: リファレンス ビデオの大まかな前景位置と、生の分類子を使用しないガイド付き機能を活用して、ビデオ生成をガイドします。

広範な実験を通じて、MotionClone はグローバル カメラ モーションとローカル オブジェクト モーションにおける優れた機能を実証し、モーションの忠実性、テキストの配置、時間的一貫性において大きな利点をもたらしました。

MotionClone テクノロジーの出現は、ビデオ作成の分野に革命的な変化をもたらしました。ビデオコンテンツ生成の品質を向上させるだけでなく、作成効率も大幅に向上します。このテクノロジーが開発と改善を続けるにつれて、将来のビデオ作成はよりインテリジェントでパーソナライズされ、「欲しいものが手に入る」というクリエイティブなビジョンを実現できるようになるだろうと私たちは信じています。

プロジェクトアドレス: https://top.aibase.com/tool/motionclone

MotionClone は独自の技術的利点により、ビデオ作成に新たな可能性をもたらし、コンテンツ作成の効率を大幅に向上させます。