Downcodes のエディターは、Checkmarx が発表した世界的な調査レポートを解釈するのに役立ちます。このレポートでは、ソフトウェア開発分野における AI プログラミング ツールの普及状況と、それがもたらすセキュリティ リスクを明らかにしています。レポートデータによると、一部の企業が AI プログラミング ツールの使用を明示的に禁止しているにもかかわらず、その導入率は依然として高いことが示されており、生成 AI の管理において企業が直面している課題が浮き彫りになっています。このレポートでは、企業の AI ツール ガバナンス、セキュリティ リスク評価、AI ツールに対する開発者の信頼についても詳しく説明しており、企業が AI ツールを効果的に活用するための重要な参考資料となります。

クラウド セキュリティ会社 Checkmarx が発表した世界的な調査によると、15% の企業が AI プログラミング ツールの使用を明示的に禁止しているにもかかわらず、ほぼすべての開発チーム (99%) が依然としてこれらのツールを使用しています。この現象は、実際の開発プロセスにおける生成 AI の使用を制御することの難しさを反映しています。

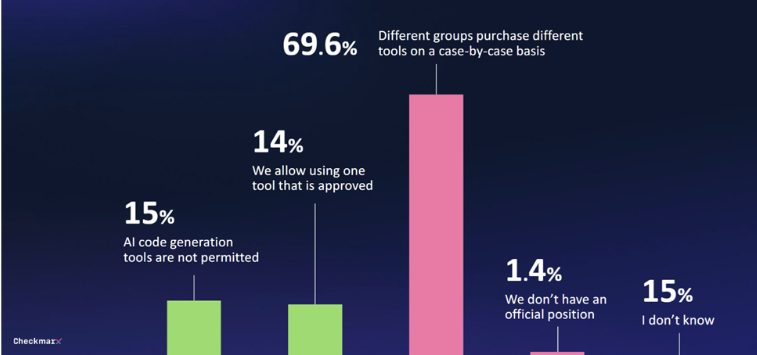

この調査では、生成 AI ツールに対して何らかの形のガバナンス システムを確立している企業は 29% のみであることがわかりました。 70%の企業は中心となる戦略を持たず、さまざまな部門の調達に関する決定は一時的なものであり、統一された管理がされていないことがよくあります。

AI プログラミング ツールを使用する開発者が増えるにつれ、セキュリティ問題への懸念が高まっています。回答者の80%は、開発者がAIを使用する際にもたらす可能性のある潜在的な脅威を懸念しており、そのうち60%は特にAIによって引き起こされる可能性のある「幻覚」を懸念している。

こうした懸念にもかかわらず、多くの人が依然として AI の可能性に関心を持っています。回答者の 47% は、監督なしで AI によるコード変更を許可することに同意していますが、ソフトウェア環境における AI セキュリティ対策に完全な不信感を表明しているのは 6% のみです。

Checkmarx の最高製品責任者である Kobi Tzruya 氏は次のように述べています。「世界中の CISO からの回答では、これらの AI ツールでは安全なコードを確実に作成できないにもかかわらず、開発者がアプリケーション開発に AI を使用していることが明らかになりました。つまり、セキュリティ チームは膨大な量のコードに対処していることになります。新しい脆弱なコード。」

Microsoft の Work Trend Index レポートでは、多くの従業員が独自の AI ツールを提供せずに使用しており、これについてオープンに議論していないことが多く、そのことがビジネス プロセスへの生成型 AI の体系的な導入を妨げていることも示しています。

ハイライト:

1. ? **15% の企業が AI プログラミング ツールを禁止しているが、99% の開発チームは依然として AI プログラミング ツールを使用している**

2. ? **生成 AI ツールのガバナンス システムを確立している企業はわずか 29%**

3. ? **回答者の 47% は、AI による教師なしのコード変更を許可することに同意しています**

全体として、このレポートは、企業が AI プログラミング ツールの管理およびセキュリティ ポリシーを強化し、AI によってもたらされる利便性と潜在的なリスクのバランスをとる必要性を強調しています。 企業は、統一された戦略を策定し、AI がもたらす可能性のあるセキュリティの脆弱性に注意を払い、AI テクノロジーをより適切に活用して開発効率を向上させる必要があります。 Downcodes の編集者は、AI セキュリティ分野の開発について詳しく知るために、Checkmarx のフォローアップ レポートに注目することを推奨しています。