Meta AI の最新プロジェクト Llama3 は広く注目を集めています。Downcodes のエディターでは、そのコア テクノロジーと将来の開発の方向性について詳しく説明します。メタ AI 研究者の Thomas Scialom 氏は最近インタビューを受け、Llama3 の開発の詳細を共有し、大規模な言語モデルのトレーニングに存在する問題について独自の洞察を提供しました。彼は特に、Llama3 トレーニングにおける合成データの重要な役割と、人間のフィードバックを効果的に使用してモデルのパフォーマンスを向上させる方法を強調しました。この記事では、Llama3 のトレーニング方法、応用分野、将来の開発計画について詳しく説明し、読者に包括的で深い視点を提供します。

Meta AI の研究者である Thomas Scialom 氏は最近、インタビューで最新プロジェクト Llama3 に関するいくつかの洞察を共有しました。彼は、Web 上の大量のテキストの品質がさまざまであることを率直に指摘し、このデータに基づくトレーニングはリソースの無駄であると考えています。したがって、Llama3 のトレーニング プロセスは人間が書いた回答には依存せず、完全に Llama2 によって生成された合成データに基づいています。

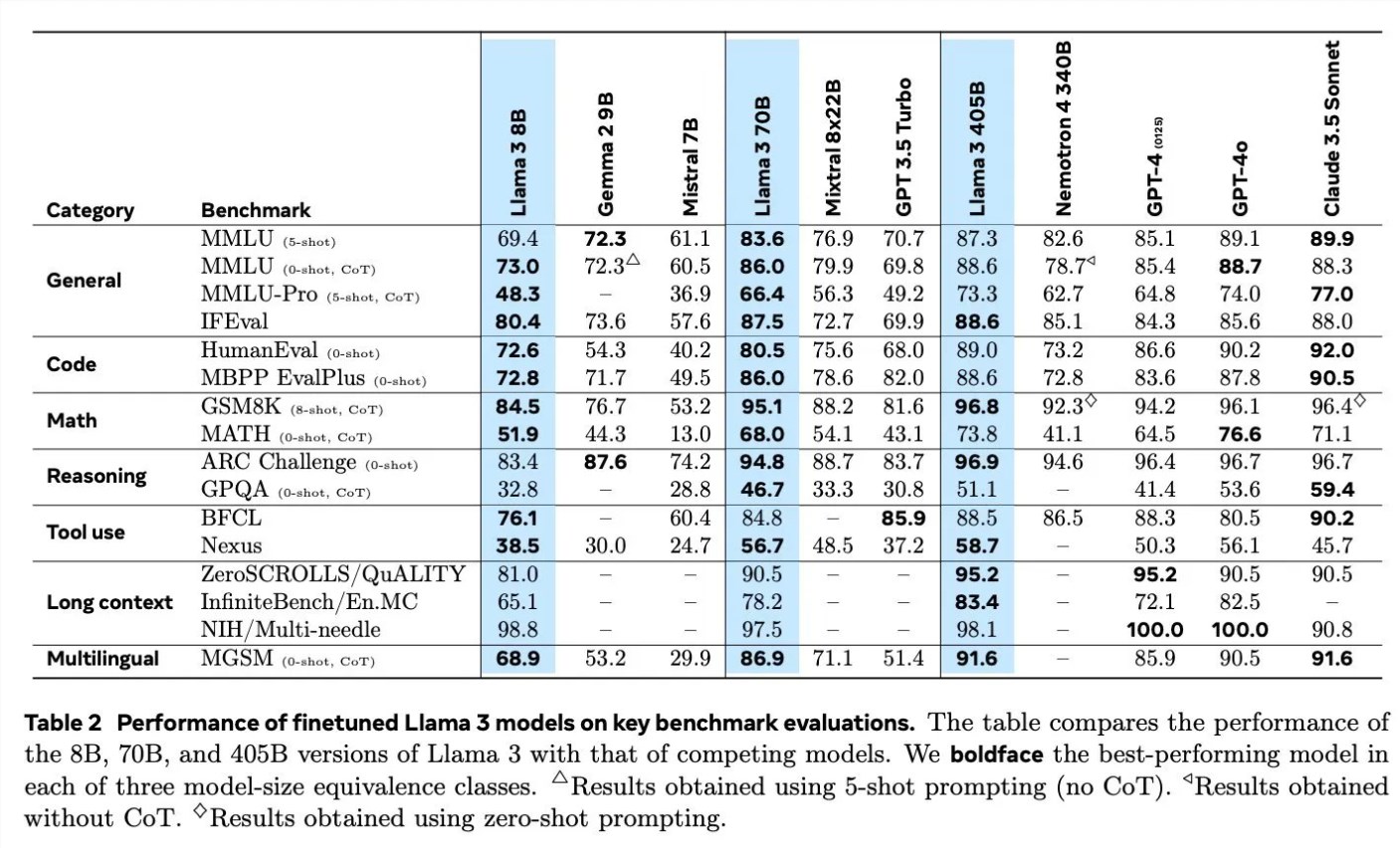

Llama3 のトレーニングの詳細について議論する際、Scialom 氏はさまざまな分野での合成データの応用について詳しく説明しました。たとえば、コード生成に関しては、コード実行からのフィードバック、プログラミング言語の翻訳、ドキュメントの逆翻訳など、3 つの異なる方法を使用して合成データを生成しました。数学的推論の観点から、彼らはデータ生成に対する「段階的に進めてみましょう」という研究アプローチを採用しました。さらに、Llama3 は引き続き 90% の多言語トークンを使用して事前トレーニングされ、高品質の人による注釈を収集します。これは多言語処理において特に重要です。

Llama3 は長いテキストの処理にも重点を置いており、合成データに依存して長いテキストの質問への回答、長い文書の要約、およびコード ベースの推論を処理します。ツールの使用法に関しては、Llama3はBrave検索、Wolfram Alpha、Pythonインタプリタでトレーニングされ、単一、ネストされた、並列およびマルチラウンドの関数呼び出しを実装しました。

Scialom 氏は、Llama3 トレーニングにおけるヒューマン フィードバックによる強化学習 (RLHF) の重要性についても言及しました。彼らはモデルをトレーニングするために人間の嗜好データを広範囲に利用し、ゼロから始めるのではなく人間が選択する能力 (2 つの詩のうちどちらを好むかを選択するなど) を強調しました。

Meta は 6 月に Llama4 のトレーニングを開始しており、Scialom は Llama4 の主な焦点がインテリジェント エージェント周辺にあることを明らかにしました。さらに、より多くのパラメーターを備え、近い将来リリースされる予定の Llama のマルチモーダル バージョンについても言及しました。

シャロム氏のインタビューでは、人工知能分野におけるメタ AI の最新の進歩と今後の開発の方向性、特に合成データと人間のフィードバックを使用してモデルのパフォーマンスを向上させる方法が明らかになりました。

シャロム氏のインタビューを通じて、私たちはデータ活用とモデルトレーニングにおける Llama3 のイノベーションと、大規模言語モデルの分野における Meta AI の継続的な探求について学びました。 Llama3 の成功体験は、将来の人工知能モデルの開発に貴重な参考となるとともに、人工知能技術がより正確かつ効率的な方向に発展することを示しています。 Downcodes の編集者は、Llama4 とマルチモーダル Llama のリリースを楽しみにしており、人工知能の分野における Meta AI の画期的な進歩に引き続き注目しています。