巨匠 Jerry Davos が公開した最新の YouTube チュートリアルでは、Comfy UI を使用してビデオの照明効果を変更し、レンダリングする方法が詳しく説明されています。このチュートリアルでは、ソフトウェアのインストール、ワークフロー、パラメーター設定、および高度なテクニックについて説明し、ユーザーの学習と実践を容易にする詳細な手順とスクリーンショットを提供します。初心者でも経験豊富なユーザーでも、そこから多くの恩恵を受け、Comfy UI ビデオ ライト調整のテクニックをすぐにマスターして、ビデオ ポスト プロダクションの効率を向上させることができます。 このチュートリアルでは、ワークフロー ファイルのダウンロード リンクと RunComfy のオンライン実行アドレスも慎重に提供されており、これにより学習の敷居が低くなり、ユーザーが簡単に開始できるようになります。

インストールと準備

まず、Jerry Davos のワークフロー ファイルをダウンロードする必要があります。リンクは記事の最後にあります。ダウンロード後、それを Comfy UI に直接ドラッグすると、不足しているノードの入力を求めるプロンプトが表示されます。心配しないでください。マネージャーを使用すると、ワンクリックでインストールできます。すばやく簡単にインストールできます。

インストール プロセス中に問題が発生した場合、Jerry Davos はヘルプ リンクも提供します。クリックすると解決策が表示されます。以下は、Jerry Davos による詳細なチュートリアルです。

ワークフローの概要

ワークフローはいくつかのグループに巧みに分割されており、入力設定から出力保存まで、それぞれに独自の機能が一目でわかるようになっています。

入力設定: エントリーリング設定とソースビデオ設定を含みます。

アニメーション差分グループ: 照明効果を調整するために使用されます。

構成グループ: IC とライト マッピングの構成。

Case Sampler Group: イメージをレンダリングする際のステップ数を制御します。

Refinementer: レンダリング解像度を上げます。

入力を求めるプロンプト: 画像と新しい照明条件について説明します。

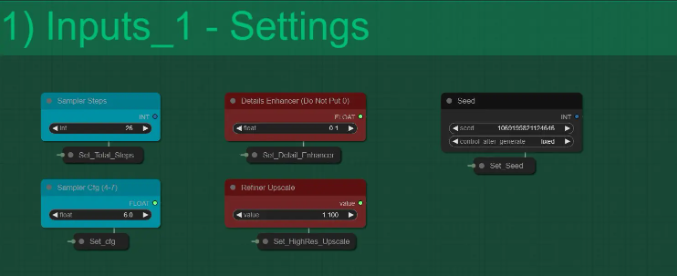

設定を入力してください

ここには 5 つの設定があります。

サンプラー ステップ: KSampler がイメージをレンダリングするために実行するステップの合計数を決定します。変更すべきではありません。 [デフォルト 26]

ディテール エンハンサー: 最終レンダリングの細かいディテールを強化します。 [0.1~1の値を使用してください]

シード: 各 KSampler の生成シードを制御します。

サンプラー CFG: KSampler の CFG 値を制御します。

Refined Upgrade: 高解像度の修復値のように機能します。 [最良の結果を得るには 1.1 ~ 1.6 を使用してください]

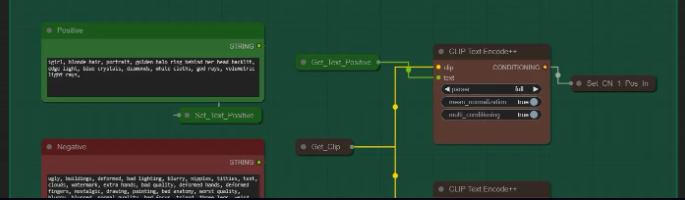

入力を求めるプロンプト

肯定的なヒント: 新しい照明の画像を最もよく説明するヒントを入力します。

否定的な注意: 最良の結果が得られるように構成されています。ご自由に編集してください。

Clip Text Encoding ノード: 品質を最大化するためにテキストをエンコードするのに役立ちます。 「フル」のままにしておきます

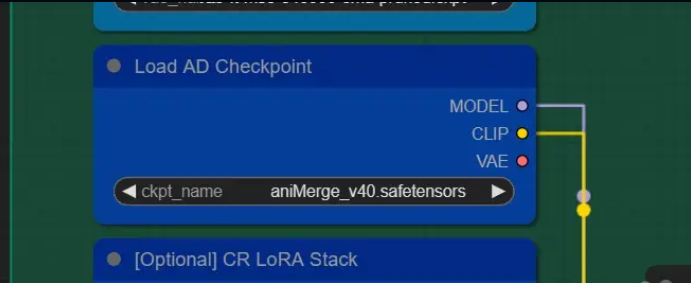

モデルとロラス

チェックポイント: 正確な結果を得るには、現実的な SD1.5 モデルを選択してください。様式化された結果を得るには、SD1.5 モデルを選択してください。

Loras: [オプション] 必要に応じて、任意の Loras をリストから選択できます。全力で力を入れないでください。最良の結果を得るには、約 0.5 ~ 0.7 を使用してください

基本設定分析

各設定には、レンダリングされたイメージの詳細を決定するケース サンプラーのステップや、最終レンダリングの細部を改善するディテール エンハンサーなどの目的があります。

シード: 各ケース サンプラーの生成シードを制御します。

Refinementer: 高解像度の復元と同様に、画質を向上させます。

入力を求めるプロンプト: 画像について説明します。システムは最良の結果が得られるように設定されています。

モデルとビデオの選択

V モデルを選択してください。それが現実的であろうと漫画的であろうと、それは問題ではありません。最良の結果を得るには、Loras 強度を 50% ~ 70% に設定することをお勧めします。

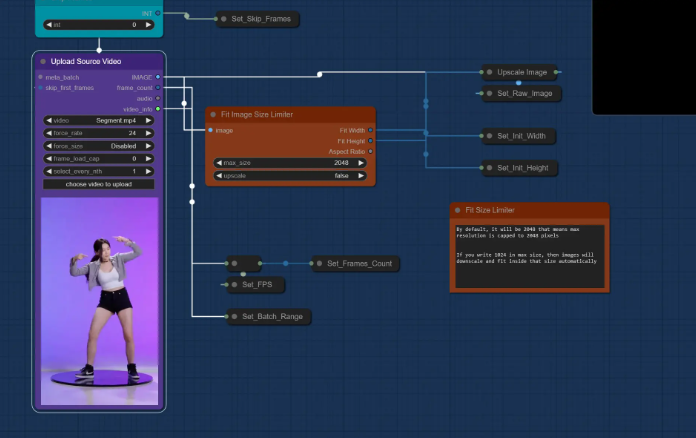

動画のアップロードと設定

ソースビデオをアップロードします。メモリ不足を避けるために、ファイルサイズが 100MB を超えないようにして、再生時間が 15 ~ 20 秒以内であるようにしてください。

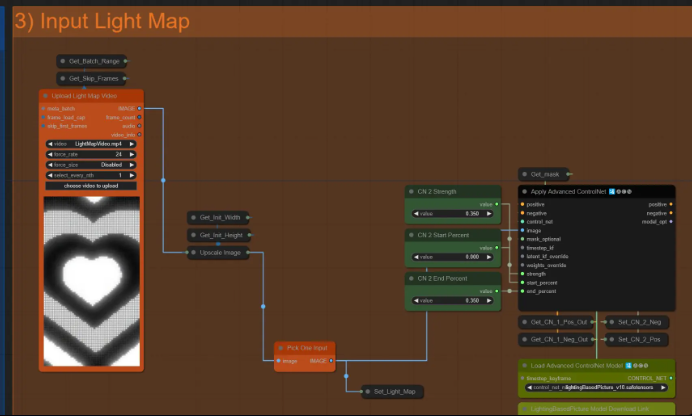

ライトマッピングビデオ

ライト マップされたビデオをアップロードし、ソース ビデオより短くならないようにしてください。短くしないと、エラーが発生します。

レンダリング設定

レンダリング解像度を調整します。横向きでも縦向きでも、最大解像度は設定値を超えません。最良の結果を得るには、800 ~ 1200 の値を使用することをお勧めします。

ライトマップ

ライト マップをアップロードする: 必要なライト マップ ビデオをクリックしてアップロードします。

ソースビデオのサイズに合わせて自動的に拡大縮小されます。

ソースビデオのサイズ以上であることを確認してください。そうでない場合は、エラーが発生します。

ライト マップ ControlNet: このライト マップは、このモデルを使用するライト コントロール ネットとしても使用されます。

光ベースの制御ネットワーク モデルを使用し、露出過度や急激すぎる光の遷移を避けるために CN 強度値が高すぎないように注意してください。

アニメーションの違い

Animatediff モデルをロードする: 任意のモデルを使用して、さまざまな効果を実現できます。

Animatediff その他のノード: 他の設定を変更するには、animatediff について知る必要があります [ここで見つけることができます]

設定 SMZ: これはモデル パイプラインの品質を向上させるために使用されるノードであり、すべての設定は適切に実行されるように事前定義されています。

ライトマップとIC調整構成

上の上部の調整ノード (グレー) は、IC の光調整の調整を制御して、コントラストを低減し、明るさを制御するために使用されます。

新しい背景の生成: 無効にすると、元の画像がフィードされ、「背景ヒント」(肯定的なヒント ボックスに存在する場合) に基づいて、同様の詳細をソース ビデオの背景にマッピングしようとします。

[女の子1人、日差し、夕日、白シャツ、黒パンツ、室内、部屋]

新しい背景の生成が有効な場合: 深度に基づいて新しい背景を生成します。

[女の子1人、太陽光、夕日、自然を背景、空]

さらに、深度制御メッシュの強度と終了パーセンテージは 45% に減少し、背景にオープン エリアが作成されます。

トップ ライトマップ: True の場合、ライトマップはソース ビデオの上にあり、より優勢になります。False の場合、ソースは最上位にあり、より優勢で明るくなります。

テーマの影響を受ける領域: 2 つのブレンド モードが最適に機能します

上部または下部のライトマップに基づいてシャドウ領域を暗くします。

上部または下部のライトマップに基づいて影の領域を明るくします。

ブレンド係数は強度に使用されます。

グローバル調整: 最終的に処理されたライト マップの明るさ、コントラスト、ガンマ、色相を上から制御します。

画像の再マッピング: このノードを使用して、画像全体の全体的な明るさと暗さを制御します。

最小値が大きいほど、シーンが明るくなります。

最大値を低くするとシーンが暗くなり、明るい領域が QrCode Monster CN のようなモーフィング オブジェクトに変換されます。

シーンをわずかに明るくするには、最小値 0.1 または 0.2 を使用するのが一般的です。

最小値 0 では、ライトマップ内の黒いピクセルに真っ黒な影が付きます。

KSamplers (オリジナルおよび洗練された)

IC Raw Ksampler: 他のサンプラーとは異なり、IC-Light 条件によりゼロではなくステップ 8 から開始します (フレームはステップ 8 からノイズ除去されます)。

たとえば、ステップ 20 を終了します。

ステップを開始する

0 ではライトマップ効果はありません。

5の効果は50%

10 は効果が 100% であることを意味します。

したがって、テストするには 3 ~ 8 程度が適切な値です。

新しい背景の生成が TRUE の場合、より良い結果を得るために 5 より小さい値を設定できます。

Ksampler Refine: その動作原理は、IC のオリジナル サンプリング後の Img2Img Refiner に似ています。

25の最後のステップについて

ステップを開始する

バージョン 10 以下はオリジナルのサンプラーと同様に動作し、モーフ オブジェクトを提供します。

15 は本物のリファイナーのように機能します

20 正常に動作しない

20 を超えると、混乱を招く結果が生じます

したがって、デフォルトの 16 で問題ありません。

顔の修復

顔を修復するためのアップグレード:顔を修復した後、顔に満足できない場合は、約1.2〜1.6にアップグレードして、より良い顔を得ることができます。

フェイシャル チップ: ここにフェイシャル チップを入力できます。初期設定は「笑顔」です。変更できます。

顔のノイズ除去: 0.35 ~ 0.45 程度を使用します。高い面では不正確なレンダリングが発生する可能性があり、面の滑りの問題も発生する可能性があります。

保存

すべてのフレームがレンダリングされると、Comfy UI ディレクトリの出力フォルダーにエクスポートされます。出力位置を調整したり、長いビデオをバッチでレンダリングしたりすることもできます。

高度なテクニック

必要に応じて、Comfy Cloud2 を使用してこのワークフローを実行できます。専用のワークフロー ページがあり、すべてのドキュメントが完成しており、ノードやモデルをインストールせずにワンクリックで実行できます。

ワークフローアドレス:

https://drive.google.com/drive/folders/16Aq1mqZKP-h8vApaN4FX5at3acidqPUv

セットアップせずに RunComfy でこのワークフローを実行します。

https://www.runcomfy.com/comfyui-workflows/comfyui-ic-light-workflow-for-video-relighting

元のビデオのアドレス: https://www.youtube.com/watch?v=q__YTKxtQAE

このチュートリアルが、Comfy UI のビデオ光調整テクニックを簡単にマスターし、より芸術的なビデオ作品を作成するのに役立つことを願っています。 より実践的なスキルを学ぶには、ジェリー ダボスを忘れずにフォローしてください。