人工知能によって生成されたコンテンツの爆発的な増加に伴い、ソーシャル メディア プラットフォームは前例のない課題に直面しています。それは、ユーザーが真実の情報と虚偽の情報をどのように区別できるかということです。 Instagramの責任者であるAdam Mosseri氏は最近、スレッド上でAI生成コンテンツに対する懸念を表明し、この課題に対処するためのInstagramとMetaの戦略を説明する一連の投稿を公開した。同氏は、ユーザーはより警戒し、AIが生成したコンテンツを識別する方法を学ぶ必要があると強調し、プラットフォームに対しコンテンツの監視を強化し、情報の透明性と信頼性を向上させるよう求めた。

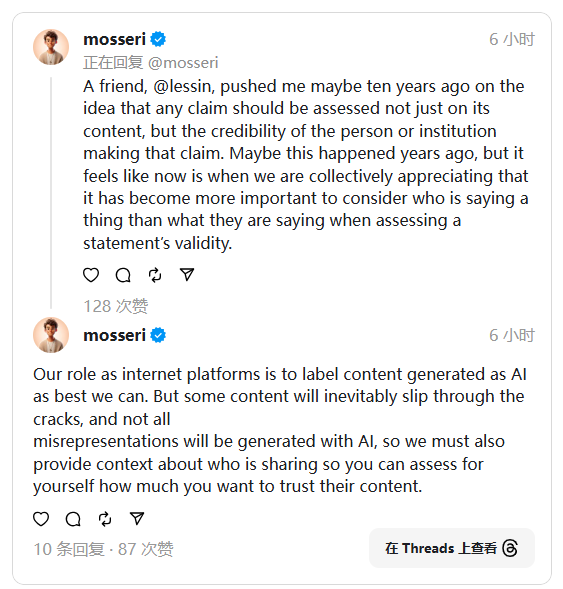

インスタグラム責任者のアダム・モセリ氏は最近のスレッドへの一連の投稿で、AI生成コンテンツの増加に直面してソーシャルメディアユーザーはより警戒する必要があると強調した。

同氏は、AI技術はすでに現実に非常に似たコンテンツを生成できるため、ユーザーがオンラインで見る画像や情報は現実ではない可能性があると指摘した。ユーザーが情報の信頼性をより適切に判断できるようにするために、ユーザーはコンテンツのソースを考慮する必要があり、ソーシャル プラットフォームにもこれをサポートする責任があるとモッセリ氏は述べました。

モセリ氏は、ソーシャルメディアプラットフォームの役割は、ユーザーが識別しやすいように、生成されたAIコンテンツに可能な限りラベルを付けることだと述べた。ただし、一部のコンテンツが見逃され、時間内にマークできない可能性があることも認めました。この目的のために、ユーザーがコンテンツをどの程度信頼するかをより適切に判断できるように、プラットフォームは共有コンテンツに関する背景情報もユーザーに提供する必要があると強調した。彼の見解はソーシャルメディアメッセージの信頼性に対する深い懸念を反映している。

現段階で、Meta (Instagram の親会社) は、ユーザーがコンテンツの信頼性を判断するのに役立つ十分なコンテキスト情報を提供していません。それでも同社は最近、コンテンツルールに大幅な変更を加える可能性があることを示唆した。この変更により、ユーザーの情報に対する信頼が高まり、AI テクノロジーによってもたらされる課題にうまく対処できるようになることが期待されます。

Mosseri氏は、ユーザーはAI主導の検索エンジンを信頼する前に、チャットボットによって提供される情報が信頼できるかどうかを確認する必要があると述べた。これは投稿文や画像のソースを確認するのと似ており、信頼できるアカウントからの情報のみがより信頼できます。

Mosseri 氏が説明するコンテンツ モデレーションのアプローチは、Twitter のコミュニティ ノートや YouTube のコンテンツ フィルターなど、ユーザー主導のモデレーション システムに近いものです。 Metaが同様の機能を導入するかどうかは不明だが、同社が他のプラットフォームから借用した過去の経験を考慮すると、今後のコンテンツモデレーションポリシーには注目する価値がある。

全体として、AI が生成したコンテンツによってもたらされる課題に直面して、Instagram と Meta は解決策を積極的に模索しています。これには、プラットフォーム自体の努力が必要なだけでなく、ユーザー自身の識別能力を向上させ、共同でコンテンツを維持する必要もあります。オンライン情報の信頼性と安全性。将来のコンテンツ監視モデルがどのように進化するかは、引き続き注目に値します。