大規模言語モデル (LLM) のオープンソースは AI テクノロジーの開発を促進しますが、知的財産の保護に課題ももたらします。 「シェル」モデルの出現により、モデルのソースを特定することが解決すべき緊急の問題となっています。この記事では、既存のモデル指紋識別方法の欠点について説明し、新しいより堅牢なモデル指紋識別方法である REEF を紹介し、それがどのように「シェルリング」問題を効果的に解決し、LLM の知的財産を保護できるかを紹介します。

AI 時代において、ラージ言語モデル (LLM) は武道の秘伝のようなものであり、その訓練プロセスは、まるで長年隠遁してきた武道の達人のように、膨大な計算能力とデータを消費します。オープンソース モデルのリリースは、マスターが自分の秘密を公開するようなものですが、知的財産 (IP) を保護するためにいくつかのライセンス (Apache2.0 や LLaMA2 コミュニティ ライセンスなど) が付属します。

しかし、世界は危険であり、常に「砲撃」事件が発生します。一部の開発者は、新しい LLM をトレーニングしたと主張していますが、実際には、それらは他の基本モデル (Llama-2 や MiniCPM-V など) のラッパーまたは微調整です。 これは、他人の武術をこっそり習っているのに、それが自分のオリジナルだと主張するようなものです。これを防ぐために、モデルの所有者とサードパーティは、「シェル化された」モデルを識別する方法を必要とします。

既存のモデルの指紋識別方法には主に 2 つのタイプがあります。

インジェクションフィンガープリント:これは、透かし方式など、秘密の本に秘密にマーキングするようなものです。 この方法では、モデルのトレーニングまたは微調整プロセス中にいくつかの「トリガー」を人為的に追加し、モデルが特定の条件下で特定のコンテンツを生成できるようにし、それによってモデルのソースを特定します。 ただし、このアプローチはトレーニング コストが増加し、モデルのパフォーマンスに影響を及ぼし、削除される可能性もあります。 また、この方法はすでに公開されているモデルには適用できません。

固有のフィンガープリンティング: これは、チートの内容とスタイルに基づいてチートのソースを判断するようなものです。 この方法では、モデルの重みや特徴表現など、モデル自体のプロパティを識別に利用します。 このうち、重みベースのフィンガープリント法は、モデルの重みの類似性を計算することで識別を行います。 ただし、この方法は、重みの並べ替え、枝刈り、微調整などの重みの変更の影響を受けやすくなります。 意味解析に基づく手法は、統計解析モデルによって生成されたテキストを通じて認識を実行します。 ただし、どちらの方法も堅牢性が不十分であるという問題があります。

では、モデルのパフォーマンスに影響を与えることなく「シェル」モデルを効果的に識別し、さまざまな「派手な」変更に耐えることができる方法はあるのでしょうか?

上海人工知能研究所およびその他の機関の研究者は、新しいモデルの指紋識別方法である REEF を提案しました。

REEF の動作原理は次のとおりです。

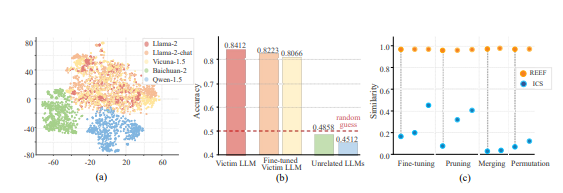

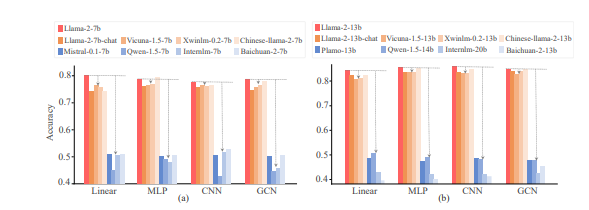

REEF は、特徴表現に基づく指紋識別方法です。 特定のレイヤーの表現には依存しませんが、LLM の強力な表現モデリング機能を利用して、認識のためにさまざまなレイヤーから特徴を抽出します。

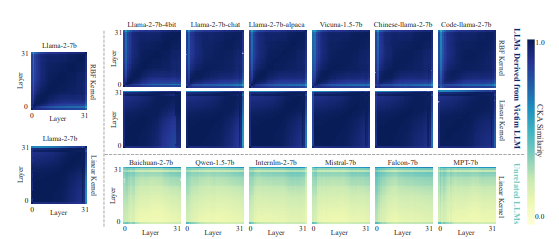

同じサンプル上の 2 つのモデルの特徴表現のセンター カーネル アライメント (CKA) の類似性を比較します。 CKA は、ヒルベルト・シュミット独立性基準 (HSIC) に基づく類似性指数であり、2 セットの確率変数間の独立性を測定できます。

類似性が高い場合は、容疑者モデルが被害者モデルから派生する可能性が高いことを意味します。そうでない場合は、その可能性は低いことを意味します。

REEFの利点は何ですか?

トレーニングは必要ありません: これは、モデルのパフォーマンスに影響を与えず、追加のトレーニング コストがかからないことを意味します。

強力な堅牢性: モデルの枝刈り、微調整、マージ、配置、スケーリング変換など、その後のさまざまな開発に対して堅牢です。 容疑者モデルが広範な微調整(最大 700B トークンのデータ)を受けている場合でも、REEF はそれが被害者モデルに由来するものであるかどうかを効果的に識別できます。

理論的保証: 研究者は、CKA が列の配置とスケーリング変換に対して不変であることを理論的に証明しました。

実験結果は、REEF が「シェル」モデルの識別において優れたパフォーマンスを発揮し、重みとセマンティック分析に基づく既存の方法を上回るパフォーマンスを示していることを示しています。

REEF の出現は、LLM の知的財産を保護するための新しいツールを提供し、モデルの不正使用やコピーなどの非倫理的または違法な行為と戦うのに役立ちます。

論文アドレス: https://arxiv.org/pdf/2410.14273

全体として、REEF 手法は、LLM オープンソース モデルの知的財産保護問題に対する効果的、堅牢かつ効率的なソリューションを提供し、より健全な AI 生態環境の構築に貢献します。