大規模言語モデル (LLM) のアーキテクチャ設計は大きな変化を遂げており、Transformer アーキテクチャの優位性は課題に直面しています。この課題に対処するために、MIT で設立された新興企業である Liquid AI は、AI モデル アーキテクチャの自動生成と最適化を目的とした STAR (Synthesis of Tailored Architectures) と呼ばれる革新的なフレームワークを立ち上げました。 STAR フレームワークは、進化的アルゴリズムと階層コーディング技術を使用して、特定のパフォーマンスとハードウェア要件に基づいてモデル アーキテクチャを合成および最適化し、効率とパフォーマンスの両方で大きな利点を示します。

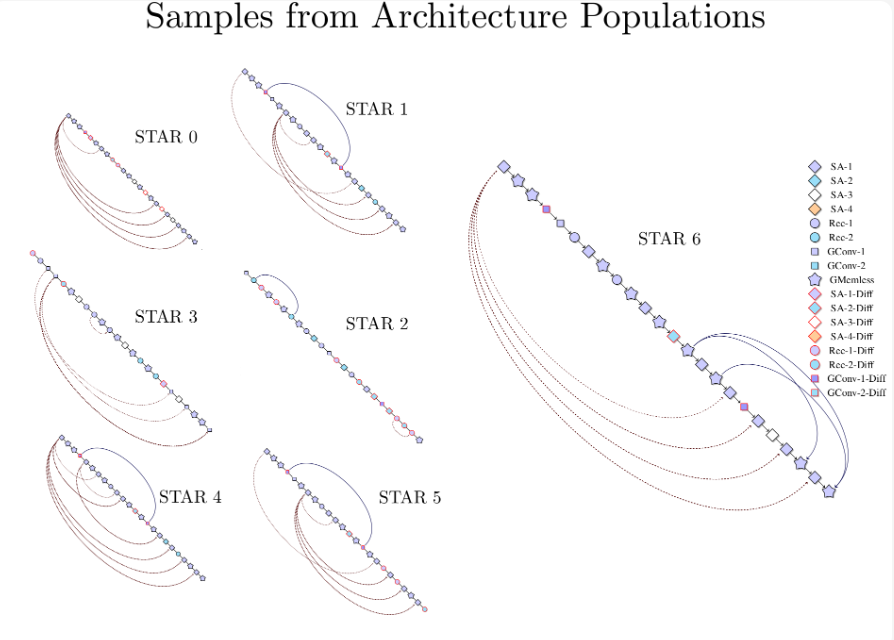

STAR フレームワークは、進化的アルゴリズムと数値コーディング システムを利用して、人工知能モデル アーキテクチャの生成と最適化を自動化します。 Liquid AIの研究チームは、STARの設計アプローチは、潜在的なアーキテクチャの広範な設計空間を探索するために「STAR Genome」と呼ばれる階層コーディング技術を採用することで、従来のアーキテクチャ設計とは異なると指摘した。ゲノムの組み合わせと突然変異を通じて、STAR は特定のパフォーマンスとハードウェア要件を満たすアーキテクチャを合成し、最適化することができます。

自己回帰言語モデリングを対象としたテストでは、STAR は従来の最適化された Transformer++ およびハイブリッド モデルよりも優れたパフォーマンスを示しました。最適化品質とキャッシュ サイズに関しては、STAR の進化したアーキテクチャにより、ハイブリッド モデルと比較してキャッシュ サイズが最大 37% 削減され、従来の Transformer と比較して 90% の削減が達成されています。この効率性によってモデルの予測パフォーマンスが犠牲になることはありませんが、場合によっては競合他社を上回るパフォーマンスを発揮します。

また、調査では、STAR のアーキテクチャが拡張性が高く、1 億 2,500 万パラメータから 10 億パラメータに拡張する STAR 進化モデルが、標準ベンチマークで既存の Transformer++ およびハイブリッド モデルと同等以上のパフォーマンスを発揮しながら、キャッシュ要件に関する推論を大幅に削減できることも示しています。

Liquid AIは、STARの設計コンセプトには、動的システム、信号処理、数値線形代数の原理が組み込まれており、柔軟なコンピューティングユニット検索空間を構築していると述べた。 STAR のユニークな機能は、そのモジュラー設計です。これにより、アーキテクチャを複数のレベルでエンコードおよび最適化できるため、研究者はアーキテクチャ コンポーネントの効果的な組み合わせについて洞察を得る機会を得ることができます。

Liquid AI は、STAR の効率的なアーキテクチャ合成機能がさまざまな分野、特に品質とコンピューティング効率のバランスが必要なシナリオに適用されると考えています。 Liquid AI は具体的な商用展開や料金プランを発表していませんが、その研究結果は自動アーキテクチャ設計の分野における大きな進歩を示しています。 AI の分野が進化し続けるにつれて、STAR のようなフレームワークは、次世代のインテリジェント システムを形成する上で重要な役割を果たす可能性があります。

公式ブログ: https://www.liquid.ai/research/automated-architecture-Synthetic-via-targeted-evolution

全体として、Liquid AI の STAR フレームワークは、AI モデル アーキテクチャ設計に新しい自動化手法を提供し、その効率とパフォーマンスにおける画期的な進歩は非常に重要であり、将来の AI システムの開発に新たな可能性をもたらします。 フレームワークのモジュール設計と拡張性により、さまざまな分野での幅広い応用の可能性も得られます。