視覚言語モデル (VLM) は人工知能の分野で大きな進歩を遂げてきましたが、高解像度の画像や多様なテキストの処理においては依然として課題に直面しています。既存のモデルでは多くの場合、静的ビジュアル エンコーダーが使用されますが、これは非効率的であり、さまざまなデータセットに対して精度が不足します。トレーニング データ セットには多様性とタスクの特異性が欠如しているため、特にチャートの解釈などの特殊なドメイン タスクのパフォーマンスも制限されます。

人工知能の急速な発展に伴い、視覚機能と言語機能の統合により、視覚言語モデル (VLM) が画期的な進歩を遂げました。これらのモデルは、視覚データとテキスト データを同時に処理して理解できるように設計されており、画像の説明、視覚的な質問応答、光学式文字認識、マルチモーダル コンテンツ分析などのシナリオで広く使用されています。

VLM は、自律システム、強化された人間とコンピューターの対話、効率的な文書処理ツールの開発において重要な役割を果たし、これら 2 つのデータ モダリティ間のギャップを埋めることに成功しました。しかし、高解像度のビジュアルデータや多様なテキスト入力の処理には、依然として多くの課題が存在します。

現在の研究ではこれらの制限に部分的に対処していますが、ほとんどのモデルで採用されている静的ビジュアル エンコーダは、高解像度や可変入力サイズでの適応性に欠けています。同時に、事前トレーニングされた言語モデルとビジュアル エンコーダーを組み合わせると、マルチモーダル タスク用に最適化されていないため、非効率が生じることがよくあります。一部のモデルでは、複雑さを管理するためにスパース コンピューティング技術が導入されていますが、さまざまなデータ セットでの精度はまだ不十分です。さらに、既存のモデルのトレーニング データ セットには多様性やタスクの特異性が欠けていることが多く、そのことがパフォーマンスをさらに制限します。たとえば、多くのモデルは、グラフの解釈や高密度のドキュメント分析などの特殊なタスクではパフォーマンスが低くなります。

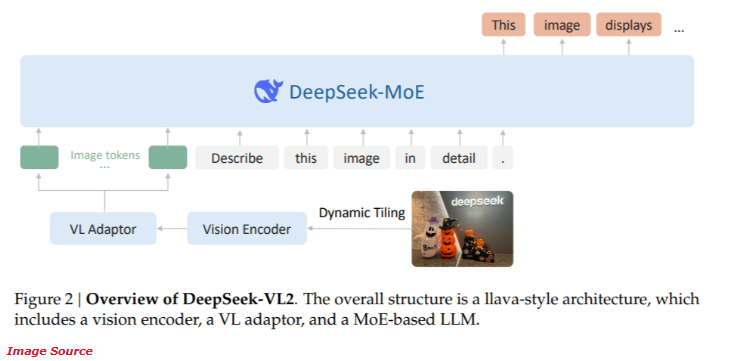

最近、DeepSeek-AI は、オープンソースのハイブリッド エキスパート (MoE) ビジュアル言語モデルの新しい DeepSeek-VL2 シリーズを開始しました。このシリーズのモデルは、ビジュアル エンコーディングのダイナミック スライシング、マルチヘッド潜在注意メカニズム、DeepSeek-MoE フレームワークなど、最先端の革新的なテクノロジーを組み合わせています。

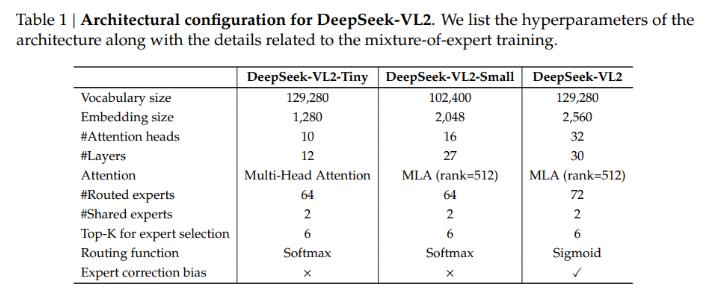

DeepSeek-VL2 シリーズには、次の 3 つの異なるパラメータ設定が用意されています。

- DeepSeek-VL2-Tiny: 33 億 7,000 万パラメータ (10 億のアクティベーション パラメータ)

- DeepSeek-VL2-Small: 161 億パラメータ (28 億アクティベーションパラメータ)

- DeepSeek-VL2: 275 億パラメータ (45 億アクティベーションパラメータ)

この拡張性により、さまざまなアプリケーションのニーズやコンピューティング予算に適応できることが保証されます。

DeepSeek-VL2 のアーキテクチャは、計算要件を削減しながらパフォーマンスを最適化するように設計されています。ダイナミック スライス手法により、重要な詳細を失うことなく高解像度画像が処理されるため、ドキュメント分析やビジュアル ローカリゼーション タスクに最適です。さらに、マルチヘッド潜在注意メカニズムにより、モデルが大量のテキスト データを効率的に処理できるようになり、高密度の言語入力の処理に通常伴う計算オーバーヘッドが削減されます。 DeepSeek-VL2 のトレーニングは多様なマルチモーダル データ セットをカバーしており、光学式文字認識、視覚的な質問応答、チャートの解釈などのさまざまなタスクで適切に実行できます。

性能テストによると、Small 構成は光学式文字認識タスクで 92.3% の精度を達成し、既存のモデルを大幅に上回りました。視覚測位ベンチマーク テストでは、前世代製品と比較して精度が 15% 向上しました。

同時に、DeepSeek-VL2 は、最先端の精度を維持しながら、コンピューティング リソース要件を 30% 削減します。これらの結果は、高解像度の画像およびテキスト処理におけるこのモデルの優位性を示しています。

プロジェクトの入り口: https://huggingface.co/collections/deepseek-ai/deepseek-vl2-675c22accc456d3beb4613ab

ハイライト:

DeepSeek-VL2 シリーズは、さまざまなアプリケーションのニーズに適応するさまざまなパラメータ構成を提供します。

ダイナミック スライシング テクノロジーにより、高解像度画像処理の効率が向上し、複雑な文書分析に適しています。

このモデルは、精度が大幅に向上し、光学式文字認識および視覚的位置特定タスクで優れたパフォーマンスを発揮します。

DeepSeek-VL2 シリーズ モデルは、革新的なアーキテクチャと優れたパフォーマンスにより、視覚言語モデルの分野に新たなブレークスルーをもたらしました。高解像度画像と複雑なテキスト処理における利点により、多くのアプリケーションシナリオで大きな可能性を示しており、さらなる注目と研究に値します。