近年、AI 仮想アバター技術は急速に発展していますが、その対話性は依然としてその応用を制限する重要なボトルネックとなっています。多くの AI 仮想アバターは、会話中に硬直した動作をし、現実性に欠け、ユーザーとの自然なインタラクションを実現できません。この目的のために、INFP と呼ばれる新しいテクノロジーが登場しました。これは、2 人での会話において AI 仮想アバター間のインタラクションが不十分であるという現状の問題を解決し、仮想キャラクターが会話中に本物の人間と同じように自然かつスムーズに感情や行動を表現できるようにすることを目的としています。人間とコンピューターの対話エクスペリエンスを完全に変えます。

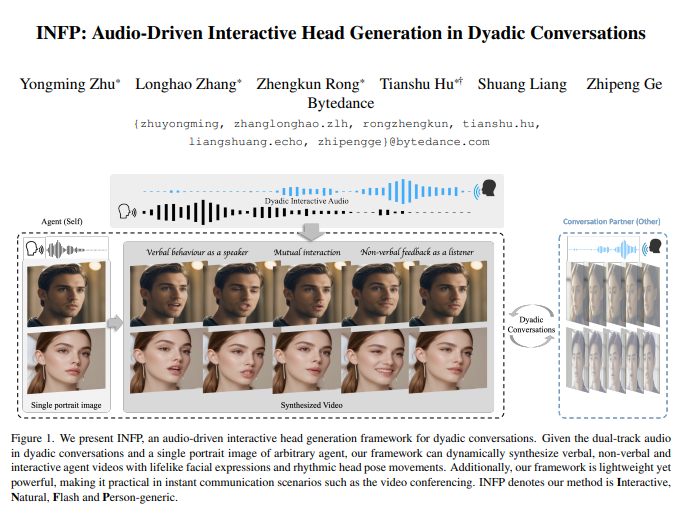

最近、INFP (Interactive、Natural、Flash、および person-generic) と呼ばれる新しいテクノロジーが広く注目を集めています。この技術は、現状の2人会話におけるAI仮想アバター間のインタラクションが不十分であるという問題を解決することを目的としており、仮想キャラクターが会話中に現実の人間のようにインタラクトし、会話内容に応じて表情や動作を動的に調整することが可能となります。

「スタンダップコメディー」に別れを告げ、「ダブルコーラス」を歓迎する

以前は、AI アバターは「スタンドアップ コメディアン」の俳優のように自分自身に話すことしかできず、あるいは「木の人間」のように何のフィードバックもなく愚かに聞くことしかできませんでした。しかし、私たち人間の会話はそうではありません。会話するとき、お互いに目を合わせ、うなずき、眉をひそめ、時には冗談を言うこともあります。これが本当のやりとりです。

INFPの登場は、この恥ずかしい状況を一変させる、まるであなたとAIとの会話音声をもとにAIアバターの表情や動きを動的に調整できる「ダブルコーラス」指揮者のような気分にさせてくれます。まるで本物の人間と話しているような感じです!

INFP の「ユニークな秘密」: 2 つのトリック、1 つは不可欠です!

INFP が非常に強力である理由は、主にその 2 つの「独自の秘密」によるものです。

モーションベースの頭の模倣:

まずは「動作模倣の達人」のように、実際の多数の会話動画から人間の表情や動作を学習し、その複雑な動作を「動作コード」に圧縮します。

動きをよりリアルにするため、目と口の「クローズアップ」と同じように、2つの「表情」にもこだわります。

また、顔のキーポイントを使用して表情の生成を支援し、動きの正確さと自然さを保証します。

次に、これらの「アクション コード」を静的なアバターに適用し、まるで魔法のように、アバターを瞬時に「生きた」ものにします。

音声ガイドによるモーション生成:

この「ジェネレーター」はさらに強力で、まるで「音を聞いて場所を特定する」マスターのように、あなたとAIとの会話音声を理解することができます。

音声で誰が話しているのか、誰が聞いているのかを分析し、手動で役割をまったく切り替えることなく、「話す」と「聞く」を自由に切り替えられるように、AI アバターのステータスを動的に調整します。

また、「話す」ときと「聞く」ときのさまざまな動作をそれぞれ記憶する「メモリーバンク」を2つ搭載し、まるで2つの「宝箱」のように、いつでも最適な動作を取り出すことができます。

また、あなたの声のスタイルに応じてAIアバターの気分や態度を調整することができ、会話をより活発で興味深いものにします。

さらに、「拡散モデル」と呼ばれる技術を使用して、これらの動きを滑らかで自然なアニメーションに変換し、遅延を感じさせません。

DyConv: 「噂話」が満載の膨大な会話データセット!

「スーパー AI」である INFP を訓練するために、研究者らは DyConv! と呼ばれる非常に大規模な会話データ セットも特別に収集しました。

このデータセットには200時間以上の会話動画が収録されており、その中の人々は世界中から集まっており、会話の内容も多岐にわたります。

DyConv データセットのビデオ品質は非常に高く、全員の顔がはっきりと見えます。

研究者らはまた、最先端の音声分離モデルを使用して各人の声を個別に抽出し、AI の学習を促進しました。

INFPの「十八の武道」:話せるだけでなく...

INFP は 2 人での会話でその才能を発揮できるだけでなく、他のシナリオでも輝きます。

「傾聴頭生成」モード:「よく聞く」優等生のように、相手の話に応じた表現や動作を行うことができます。

「トーキングヘッド生成」モード: まるで「腹話術師」のマスターのように、音声に基づいてアバターにリアルな口の形を作成させることができます。

INFP の力を証明するために、研究者たちは多数の実験を実施し、その結果は次のことを示しました。

INFP は、さまざまな指標において、ビデオ品質、リップシンク、アクションの多様性などの他の同様の手法を打ち破り、優れた結果を達成しました。

ユーザーエクスペリエンスの観点からは、参加者は、INFP によって生成されたビデオがより自然で鮮明で、オーディオとよりよく一致していることに同意しました。

研究者らはまた、INFPのすべてのモジュールが不可欠であることを証明するためにアブレーション実験も実施した。

プロジェクトアドレス: https://grisoon.github.io/INFP/

INFP テクノロジーの画期的な進歩により、AI 仮想アバターのインタラクティブ エクスペリエンスに革命的な変化がもたらされ、実際の人間のインタラクション方法に近づきました。将来的には、INFP テクノロジーは仮想アシスタント、オンライン教育、エンターテインメントなどの多くの分野で広く使用され、ユーザーにより自然で鮮明で没入型のインタラクティブ エクスペリエンスをもたらすことが期待されています。