ほんの数回のハム音やビートだけで高品質の音楽やサウンドエフェクトを生成できることを想像してみてください。これはもはや遠い夢ではありません。画期的な AI 研究の成果である Sketch2Sound は、音の模倣とテキスト プロンプトを組み合わせることで高品質のオーディオ生成を実現します。音の模倣から抽出された音量、明るさ、ピッチの 3 つの主要な制御信号を巧みに利用し、それらをテキストからオーディオへの潜在的な拡散モデルに統合することで、特定の要件を満たすサウンドを生成するように AI を誘導し、音楽の分野に大きな利益をもたらします。音作りに革命を起こす。

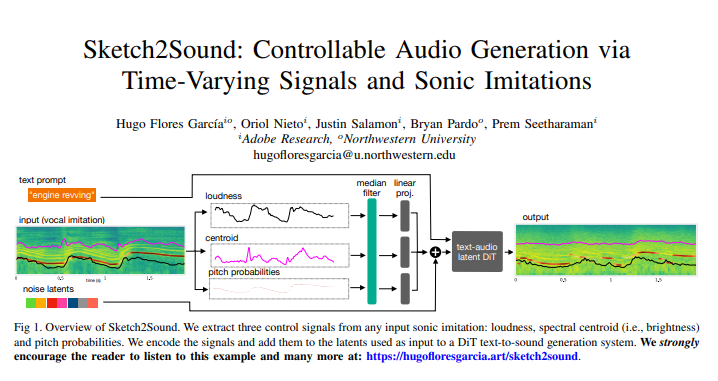

Sketch2Sound の中核テクノロジーは、任意のサウンド模倣 (ボーカル模倣やリファレンス サウンドなど) から 3 つの重要な時間変化する制御信号、ラウドネス、明るさ (スペクトル重心)、およびピッチを抽出する機能です。これらの制御信号がエンコードされると、テキストからサウンドの生成に使用される基礎となる拡散モデルに追加され、それによって AI が特定の要件を満たすサウンドを生成するように導きます。

このテクノロジーの最も印象的な点は、その軽量性と効率性です。 Sketch2Sound は、既存のテキストからオーディオへの潜在拡散モデルに基づいて構築されており、必要な微調整ステップは 40,000 ステップのみで、制御信号ごとに線形レイヤーが 1 つだけ必要なため、他の方法 (ControlNet など) よりも簡潔で効率的です。モデルが「スケッチ」のような音の模倣から合成できるようにするために、研究者らはトレーニング中に制御信号に確率的中央値フィルターを適用し、柔軟な時間特性を持つ制御信号に適応できるようにしました。実験結果は、Sketch2Sound が入力制御信号に準拠したサウンドを合成できるだけでなく、テキスト プロンプトへの準拠を維持し、プレーン テキストのベースラインに匹敵するオーディオ品質を達成できることを示しています。

Sketch2Sound は、サウンド アーティストに新しい作成方法を提供します。テキストプロンプトの意味論的な柔軟性と、音声ジェスチャーや模倣の表現力と正確さを組み合わせて、前例のないサウンド構成を作成できます。これは、オブジェクトを操作してサウンド効果を作成する従来の Foley アーティストに似ていますが、Sketch2Sound はサウンドの模倣を通じてサウンド生成をガイドし、サウンド作成に「人間味のある」タッチをもたらし、サウンド作品の芸術的価値を向上させます。

Sketch2Sound は、従来のテキストから音声へのインタラクション方法と比較して、その制限を克服できます。これまで、サウンド デザイナーは生成されたサウンドの時間特性を調整して視覚効果と同期させる必要がありましたが、Sketch2Sound では、人間の声の模倣に限らず、あらゆるタイプのサウンドを模倣することでこの同期を自然に実現できます。模倣を使用して、この生成モデルを推進できます。

研究者らはまた、トレーニング中にさまざまなウィンドウ サイズのメディアン フィルターを適用することで、制御信号の時間的な詳細を調整する手法も開発しました。これにより、サウンド アーティストは、生成モデルが制御信号のタイミング精度にどの程度準拠しているかを制御できるため、完全に模倣するのが難しいサウンドの品質が向上します。実際のアプリケーションでは、ユーザーはメディアン フィルターのサイズを調整することで、サウンドの模倣を厳密に遵守することとオーディオ品質を確保することの間のバランスを見つけることができます。

Sketch2Sound の動作原理は、まず入力オーディオ信号からラウドネス、スペクトル重心、ピッチの 3 つの制御信号を抽出することです。これらの制御信号は、テキストからサウンドへのモデルの潜在信号と調整され、単純な線形投影レイヤーを通じて潜在拡散モデルが調整されて、最終的に目的のサウンドが生成されます。実験結果は、信号の時変制御を通じてモデルを調整すると、オーディオ品質とテキスト準拠への影響を最小限に抑えながら、この信号への準拠を大幅に向上できることを示しています。

注目すべきことに、研究者らは、制御信号が生成された信号のセマンティクスを操作できることも発見しました。たとえば、テキスト プロンプト「forest ambience」を使用する場合、ランダムなラウドネス バーストが音の模倣に追加されている場合、モデルは追加のプロンプト「birds」なしでこれらのラウドネス バーストで鳥の鳴き声を合成できます。これは、モデルが相関関係を学習していることを示しています。爆発的な音量と鳥の存在の間。

もちろん、Sketch2Sound にはいくつかの制限があります。たとえば、重心コントロールが入力サウンドによってモデル化されたルーム トーンを生成されたオーディオに組み込む可能性があるという事実です。これはおそらく、ルーム トーンが重心によってエンコードされるためです。入力オーディオにサウンドイベントがありません。

全体として、Sketch2Sound は強力な生成サウンド モデルであり、テキスト プロンプトと時間変化するコントロール (音量、明るさ、ピッチ) を通じてサウンドを生成できます。サウンドの模倣とコントロール カーブの「スケッチ」を通じてサウンドを生成でき、柔軟なタイミングでサウンドを生成できる、軽量かつ効率的な、制御可能なジェスチャー ベースの表現力豊かなツールをサウンド アーティストに提供します。将来的には音楽制作やゲームサウンドデザインの分野での応用が期待されます。

論文アドレス: https://arxiv.org/pdf/2412.08550

Sketch2Sound の登場は、サウンド制作の分野に新時代の到来を告げ、アーティストにこれまでにない創造的な自由と可能性を提供し、音楽、ゲーム、映画などの分野に無限の想像力の余地をもたらします。 近い将来、この技術はさらに普及し、より多彩な音世界をもたらしてくれると信じています。