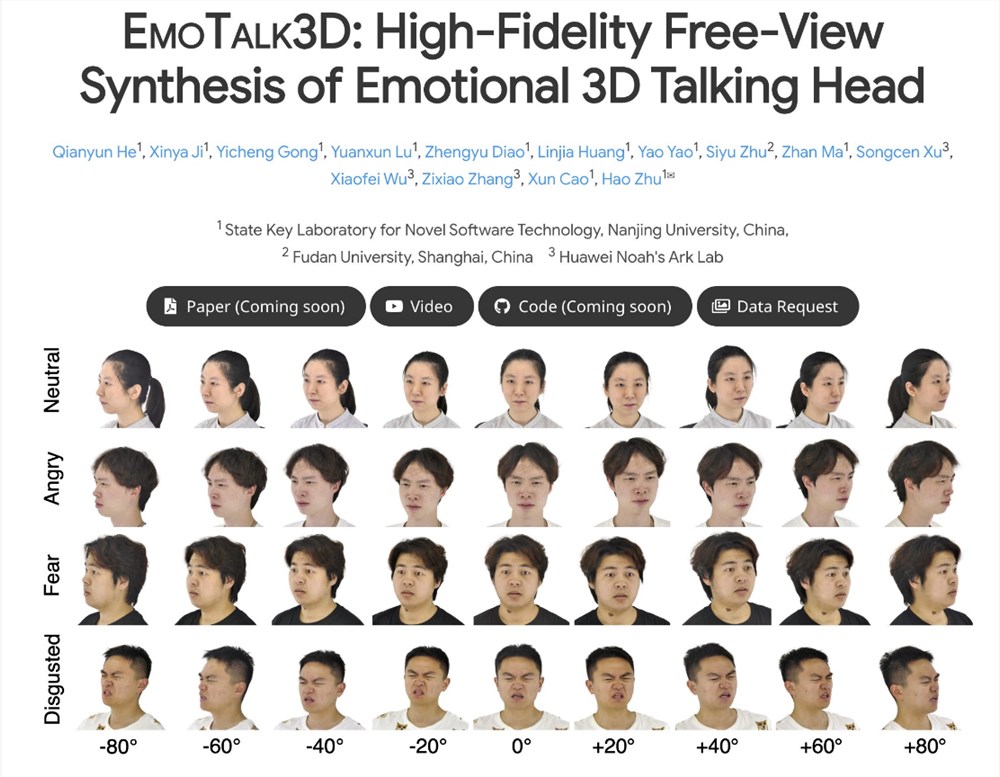

EmoTalk3D プロジェクトは、人工知能の分野で画期的な進歩を遂げました。その核心は、忠実度が高く、感情豊かな 3D 会話アバターの合成に成功したことにあります。このプロジェクトは、既存の技術が抱える多視点の一貫性と感情表現の不十分さを解決します。このフレームワークは、3D 幾何学的シーケンスを正確に予測し、4D ガウス表現に基づいて 3D アバターの外観を合成し、最終的には微妙な表情やシワもリアルに表現できるフリービューのトーキング アバター アニメーションを実現します。

EmoTalk3Dプロジェクトの研究チームが、マルチビューの一貫性と感情表現の点で現在の3Dトーキングアバター技術の欠点に対処するための新しい合成方法を提案したことがわかった。このアプローチにより、リップシンクとレンダリング品質の向上が可能になるだけでなく、生成された会話アバターでの制御可能な感情表現も可能になります。

研究チームは、「音声からジオメトリ、外観へ」のマッピング フレームワークを設計しました。このフレームワークは、最初にオーディオ特徴から忠実な 3D 幾何学的シーケンスを予測し、次にこれらの幾何学的形状に基づいて 4D ガウスで表される 3D トーキング ヘッドの外観を合成します。このプロセスでは、外観が標準ガウス コンポーネントと動的ガウス コンポーネントにさらに分解され、マルチビュー ビデオからの学習を通じて融合され、フリービューのトーキング アバター アニメーションがレンダリングされます。

EmoTalk3D プロジェクトの研究チームは、しわや微妙な表情の表現など、動的な顔の詳細をキャプチャする際のこれまでの方法の困難もうまく解決したことは、言及する価値があります。実験結果は、この方法が高忠実度で感情的に制御可能な 3D トーキング アバターを生成する上で大きな利点を持ち、同時に唇の動きの生成においてより優れたレンダリング品質と安定性を示すことを示しています。

現在、EmoTalk3D プロジェクトのコードとデータ セットは、世界中の研究者や開発者が参照および使用できるように、指定された HTTPS URL で公開されています。この革新的な技術的進歩は、間違いなく 3D トーキング アバターの分野の発展に新たな活力を注入するものであり、将来的には仮想現実、拡張現実、映画やテレビ制作などの多くの分野で使用されることが期待されています。

EmoTalk3D プロジェクトの成功は、3D デジタル キャラクターの制作に新たな可能性をもたらし、その忠実度の高い感情的な 3D アバター テクノロジーは、仮想現実、拡張現実、映画やテレビの制作の分野に革命的な変化をもたらすでしょう。将来的には、EmoTalk3D テクノロジーをベースにしたさらに多くの製品やアプリケーションが登場し、人々により没入型の体験をもたらすことが期待できます。