ディープフェイクは、急速に発展している敵対的な人工知能として、世界経済と安全保障にますます深刻な脅威を与えています。それによる経済的被害は大幅に拡大すると予想されており、銀行や金融サービス業界が主な標的となる。この記事では、ディープフェイク技術の急速な発展傾向、それが企業や個人にもたらすリスクと課題を分析し、この新たな脅威に対処する際に企業が直面するジレンマを探ります。

敵対的人工知能の最も急速に成長している形式の 1 つであるディープフェイクに関連する損失は、2023 年の 123 億ドルから 2027 年には 400 億ドルに急増すると予想されており、年間平均成長率は 32% という驚異的です。デロイトは、銀行や金融サービスが主な標的となり、今後数年間でディープフェイクが急増すると予想している。

ディープフェイクは敵対的な AI 攻撃の最前線にあり、昨年だけで 3,000% 増加しました。ディープフェイクは2024年までに50~60%増加すると予想されており、今年は世界中で同様の事件が14万~15万件発生すると予想されている。

最新世代の生成 AI アプリケーション、ツール、プラットフォームは、ディープフェイク ビデオ、なりすましの音声、不正な文書を迅速かつコスト効率よく作成するために必要なすべてを攻撃者に提供します。 Pindrops の 2024 年音声インテリジェンスおよびセキュリティ レポートでは、コンタクト センターをターゲットとしたディープフェイク詐欺の被害額は年間 50 億ドルと推定されています。彼らの報告書は、ディープフェイクが銀行や金融サービスにもたらす深刻な脅威を強調しています。

ブルームバーグは昨年、「20ドルから数千ドルの価格で詐欺師を販売する家内産業全体がダークウェブ上に出現した」と報じた。最近では、Sumsubの2023年アイデンティティ詐欺レポートに基づいたインフォグラフィックがAI詐欺の急速な成長に関する世界的な視点を提供している。 。

企業の 3 分の 1 は、敵対的な AI 攻撃のリスクに対処する戦略を持っていません。AI 攻撃は主要な経営陣のディープフェイクから始まる可能性が最も高いです。 Ivanti の新しい調査によると、企業の 30% には、敵対的な AI 攻撃を特定して防御する計画がないことがわかりました。

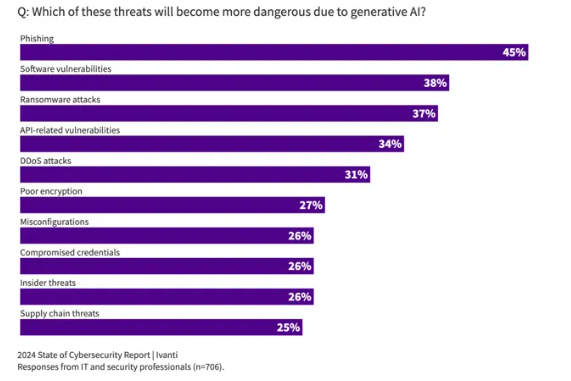

Ivanti の 2024 年サイバーセキュリティ現状レポートによると、調査対象の企業の 74% が AI の脅威の証拠を確認したことがあります。圧倒的多数 (89%) が、AI の脅威は始まったばかりだと信じています。 Ivanti がインタビューした CISO、CIO、IT リーダーの大多数のうち 60% が、組織が AI の脅威や攻撃に対して防御する準備ができていないことを懸念していました。フィッシング、ソフトウェア悪用、ランサムウェア、API 関連の脆弱性などを含む、組織化された戦略の一環としてディープフェイクを使用することがますます一般的になってきています。これは、セキュリティ専門家が新世代の人工知能により危険性が高まると予想している脅威と一致しています。

ディープフォージリ技術の急速な発展とそれがもたらす巨大なリスクに直面し、企業は損失を効果的に削減し自らの安全を確保するために、積極的に対策を講じ、セキュリティ保護を強化し、従業員のリスク認識を向上させる必要があります。 テクノロジーの進歩と同時に、テクノロジーの悪用を防ぐためのセキュリティ対策の強化も必要です。