Meta は最近、マルチモーダル モデル、テキスト生成音楽、音声透かし技術、データセットなどの複数の分野をカバーする 6 つの主要な AI 研究結果を静かに発表し、人工知能分野における継続的な革新と技術力を実証しました。これらの研究結果は、AI分野における応用の新たな可能性を提供するだけでなく、今後の技術開発の方向性に貴重な参考となるものです。これらの印象的な研究結果については、以下で詳しく説明します。

最近、Meta は 6 つの研究結果を密かに発表し、AI 分野に新しい応用と技術的ブレークスルーをもたらしました。これらには、マルチモーダル モデル、テキスト生成音楽モデル、オーディオ透かし技術、データ セット、その他のプロジェクトが含まれます。これらの研究の具体的な結果を見てみましょう。

メタカメレオン(「カメレオン」モデル)

まず、リリースされたマルチモーダルモデル「Chameleon」は、テキストと画像を同時に処理でき、入出力テキストの混合をサポートし、マルチモーダルデータを処理するための新しいソリューションを提供します。

現在の後期段階の融合モデルのほとんどは拡散ベースの学習を使用しますが、Meta Chameleon はテキストと画像のトークン化を使用します。これにより、より統一されたアプローチが可能になり、モデルの設計、保守、拡張が容易になります。

ビデオの例: 画像からクリエイティブなタイトルを生成するか、テキスト プロンプトと画像を組み合わせて使用して、まったく新しいシーンを作成します

Meta は今後、研究ライセンスに基づいて Chameleon7B および 34B モデルの主要コンポーネントを一般公開します。現在リリースされているモデルはセキュリティが調整されており、混合モード入力とプレーン テキスト出力をサポートしており、研究目的で使用できます。同関係者は、カメレオンイメージ生成モデルは発売されないと強調した。

製品入口:https://top.aibase.com/tool/meta-chameleon

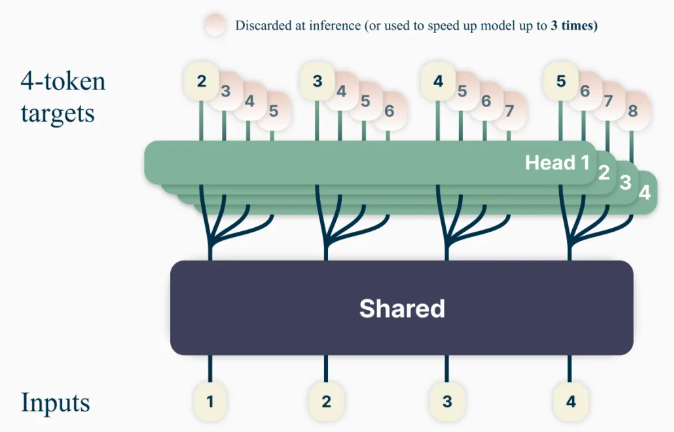

マルチトークン予測

新しい言語モデルのトレーニング方法「マルチトークン予測」は、モデルの機能とトレーニング効率を向上させることを目的としており、一度に複数の単語を予測するようにモデルをトレーニングし、モデルの予測精度を向上させます。

このアプローチを使用すると、一度に 1 つの単語を予測する以前の方法ではなく、複数の将来の単語を同時に予測するように言語モデルをトレーニングできます。これにより、速度が向上すると同時に、モデルの機能とトレーニングの効率が向上します。責任あるオープン サイエンスの精神に基づき、事前トレーニングされたモデルは非営利/研究専用ライセンスの下でコード補完用にリリースされます。

製品入口: https://top.aibase.com/tool/multi-token-prediction

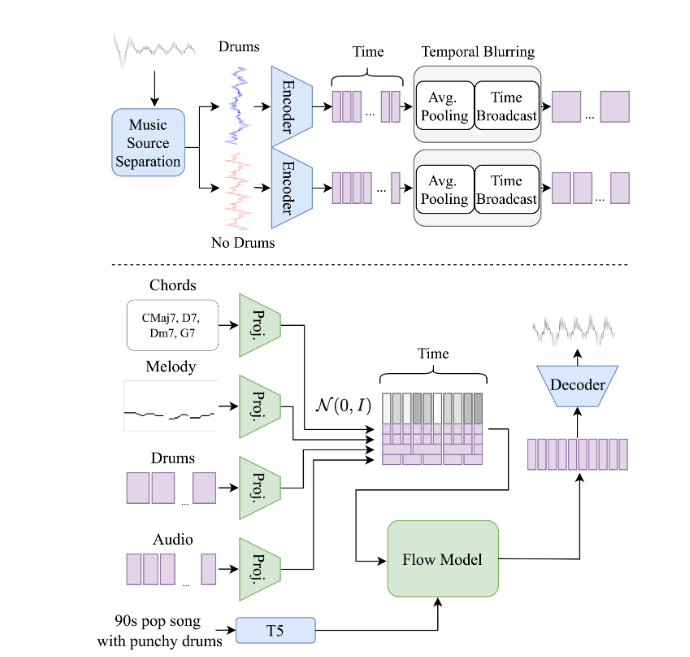

テキスト生成音楽モデル「JASCO」

MusicGen などの既存のテキスト音楽変換モデルは主にテキスト入力に依存して音楽を生成しますが、Meta の新しいモデルである Meta-Joint Audio and Symbol Conditioning for Temporally Controlled Text-to-Music Generation (JASCO) は、さまざまな入力を受け入れることができます。特定のコードやビートなどの条件入力を使用して、結果として得られる音楽出力の制御を向上させます。具体的には、情報ボトルネック層を時間的あいまいさと組み合わせて使用して、特定の制御に関連する情報を抽出できます。これにより、同じテキストから音楽への生成モデルで、記号条件とオーディオベースの条件を同時に組み合わせることができます。

JASCO は、生成された音楽をより適切かつ柔軟に制御しながら、生成品質の点で評価ベースラインに匹敵します。関係者は研究論文とサンプルページを公開し、今月後半には推論コードが MIT ライセンスに基づいて AudioCraft リポジトリの一部としてリリースされ、事前トレーニングされたモデルが CC-BY-NC に基づいてリリースされる予定です。

コードの入り口: https://top.aibase.com/tool/audiocraft

音声透かし技術「AudioSeal」

これは、AI が生成した音声のローカル検出用に特別に設計された初のオーディオ透かし技術であり、長いオーディオ クリップ内で AI が生成したセグメントの正確な位置特定を可能にします。 AudioSeal は、ステガノグラフィーではなく AI によって生成されたコンテンツの検出に重点を置くことで、従来のオーディオ ウォーターマークを改善します。

複雑なデコードアルゴリズムに依存する従来の方法とは異なり、AudioSeal のローカル検出アプローチにより、より高速で効率的な検出が可能になります。この設計により、以前の方法と比較して検出速度が 485 倍向上し、大規模なリアルタイム アプリケーションに最適です。私たちの方法は、オーディオ透かしの堅牢性と知覚不可能性の点で最先端のパフォーマンスを実現します。

AudioSeal は商用ライセンスに基づいてリリースされています。

製品入口:https://top.aibase.com/tool/audioseal

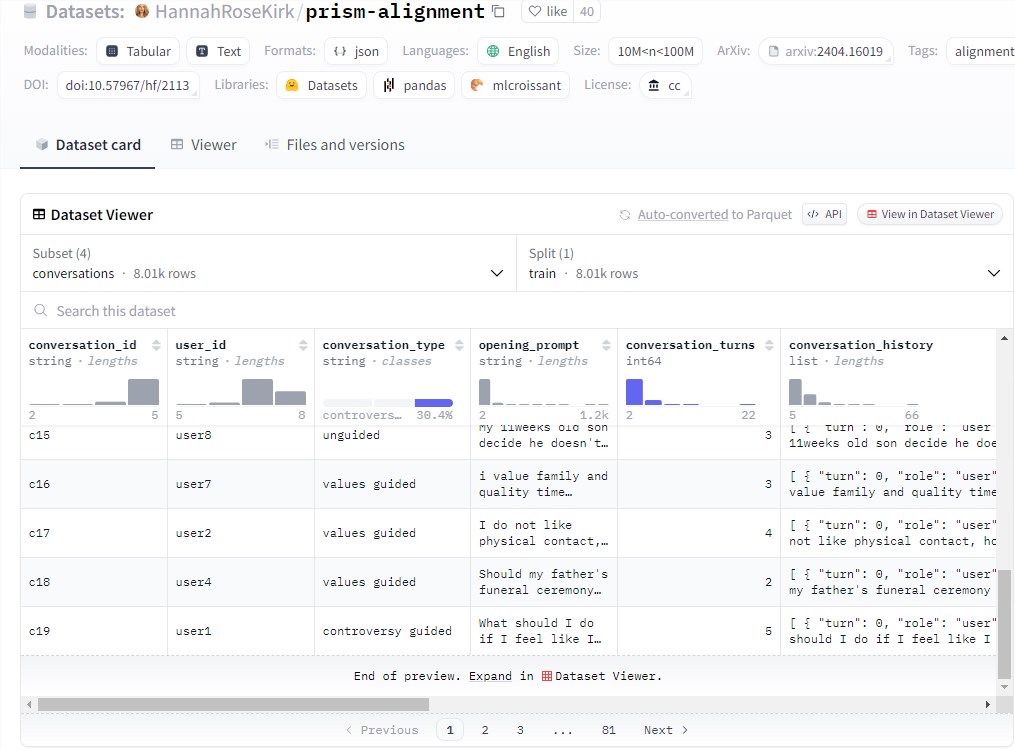

PRISM データセット

同時に、Meta は外部パートナーと協力して、世界中の 1,500 人の参加者の対話データと好みを含む PRISM データセットもリリースしました。これは、大規模な言語モデルを改善するために使用され、それによって対話の多様性と好みを改善します。モデルの多様性と社会的利益。

このデータセットは、各人の好みと詳細なフィードバックを、21 の異なる LLM との 8,011 のリアルタイム会話にマッピングします。

データセットの入り口: https://huggingface.co/datasets/HannahRoseKirk/prism-alignment

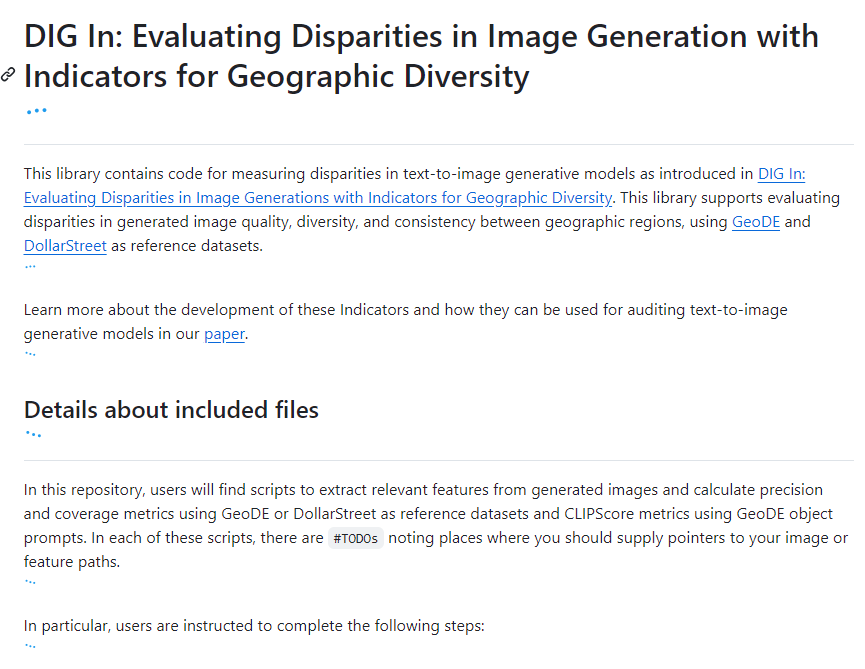

「DIG In」インジケーター

テキスト生成画像モデルの地理的な違いを評価するために使用され、モデル改善のためのより多くの参照データを提供します。さまざまな地域の人々が地理的表現をどのように異なる見方で見るかを理解するために、メタは大規模な注釈研究を実施しました。各例について 65,000 を超える注釈と 20 を超えるアンケート回答を収集し、魅力、類似性、一貫性を網羅し、テキストから画像へのモデルの自動および人間による評価を向上させるための推奨事項を共有しました。

コードの入り口: https://top.aibase.com/tool/dig-in

これらのプロジェクトの公開は、AI分野に新たな技術的ブレークスルーと応用の展望をもたらし、AI技術の開発と応用を促進する上で大きな意義がある。

全体として、今回 Meta が発表した 6 つの AI 研究結果は、マルチモダリティ、テキスト生成、音声処理、データセット構築における同社の最先端技術と先進的なレイアウトを示しています。これらの技術の進歩は、AI分野のさらなる発展を促進し、将来のアプリケーションにさらなる可能性をもたらします。