香港中文大学や中国科学院などの研究チームは最近、MiCoと呼ばれるフルモーダル事前トレーニングパラダイムを立ち上げました。これは、マルチモーダル学習の分野で画期的な進歩を遂げ、37の現状を更新しました。 -the-art パフォーマンス (SOTA) 記録。 MiCo は、あらゆるモダリティを理解し、普遍的な表現を学習できるフルモーダル インテリジェンスの構築を目指しており、より多くのモダリティ、データ量、モデル パラメーターを導入することで人間の脳のマルチモーダル認知プロセスをシミュレートします。その核心は、さまざまなモードを「知識モード」と「インターフェースモード」に分割し、対応するフルモーダル学習アーキテクチャを設計し、マルチモーダルコンテキストを使用してモダリティ間の相互強化を強化し、クロスモーダルコンテキスト関係を構築することです。この研究結果は、人工知能分野の発展に新たな方向性とアイデアを提供します。

6 月 17 日の ChinaZ.com からのニュース: 香港中文大学、中国科学院、その他の機関の研究チームは、MiCo (マルチモーダル コンテキスト) と呼ばれるフルモーダル事前トレーニング パラダイムを提案しました。この方法は注目すべき結果をもたらしました。マルチモーダル学習の分野で達成され、37 件の最先端パフォーマンス (SOTA) 記録を樹立しました。

主要な機能:

フルモーダル理解: MiCo は、あらゆるモダリティを理解し、普遍的な表現を学習できるフルモーダル インテリジェンスの構築を目指しています。

大規模な事前トレーニング: より多くのモダリティ、データ量、モデル パラメーターを導入することで、MiCo は事前トレーニング プロセス中に人間の脳のマルチモーダルな認知プロセスをシミュレートします。

ニューラル ネットワーク構造の設計: MiCo は、さまざまなモードを「知識モード」と「インターフェイス モード」に分割し、対応するフルモーダル学習アーキテクチャを設計します。これは、生成推論手法によって調整されます。

マルチモーダル コンテキストとスケーリング則: MiCo はマルチモーダル コンテキストを使用して、モダリティ間の相互強化を強化し、クロスモーダル コンテキスト関係を構築します。

実験結果は次のことを示しています。

10 の異なるモードのシングルモーダル知覚ベンチマーク テストで、MiCo は 7 つの SOTA 結果を達成しました。

検索、質問と回答、説明などを含む 25 のクロスモーダル理解タスクで、MiCo は 20 の SOTA 結果を達成しました。

18 回のマルチモーダル大規模言語モデル ベンチマーク テストで、MiCo は合計 10 回の SOTA 結果を達成しました。

MiCo の事前トレーニング方法:

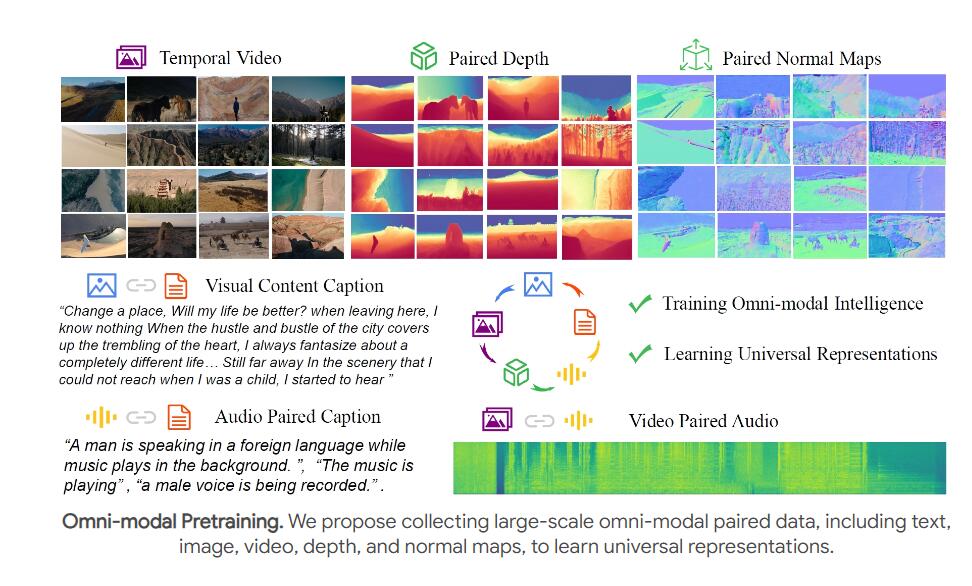

チームは、人間の脳の視覚、聴覚、時空間の知覚能力をシミュレートするための共同事前トレーニングにビデオとペアの音声、テキストの説明、深度、法線を使用しました。

マルチモーダル コンテキスト関係は、オールモーダル エンコーダー (ViT など) を使用してマルチモーダル特徴を抽出し、テキスト エンコーダーを使用してテキスト特徴を抽出することによって構築されます。

結論と今後の課題:

MiCo プロジェクトは、人間の脳のマルチモーダル認知をシミュレートする人工知能による重要な試みであり、チームはこれが将来の研究に刺激を与え、より強力なフルモーダル基本モデルを開発することを期待しています。

今後の作業計画には、オプティカル フロー、IMU データ、イベント ファイルなどのより多くのモダリティを組み合わせて、フルモーダル共同事前トレーニングを引き続き強化することが含まれています。

MiCo の優れたパフォーマンスは、マルチモーダル学習の分野で新たな基準を設定しており、その将来の発展の可能性は非常に大きく、引き続き注目に値します。今後の研究の方向性も楽しみであり、MiCoは今後も人工知能技術の進歩を推進していくものと思います。