年末に、Beijing Zhipu Huazhang Technology Co., Ltd. は、拡張強化学習テクノロジに基づいてトレーニングされた最初の推論モデルである GLM-Zero の最初のバージョン、GLM-Zero-Preview を発売しました。このモデルは、数理論理学、コード記述、複雑な問題の推論において優れた能力を実証しており、複数の信頼できる評価において同様の OpenAI モデルと同等の結果を達成しています。 GLM-Zero-Preview は、エキスパート タスクの能力を向上させるだけでなく、一般的なタスクでも優れたパフォーマンスを維持し、人工知能の推論能力の向上に対する新たなベンチマークを設定します。

年末に、Beijing Zhipu Huazhang Technology Co., Ltd. は、拡張強化学習テクノロジーに基づいてトレーニングされた最初の推論モデル、つまり GLM-Zero の最初のバージョンである GLM-Zero-Preview をリリースしました。このモデルは、人工知能の推論能力、特に深い推論を必要とする数理論理学、コード記述、複雑な問題の処理の向上に焦点を当てています。基本モデルと比較して、GLM-Zero-Preview は、AIME2024、MATH500、および LiveCodeBench の評価におけるパフォーマンスは OpenAI o1-preview と同等でありながら、エキスパート タスク機能を大幅に向上させています。

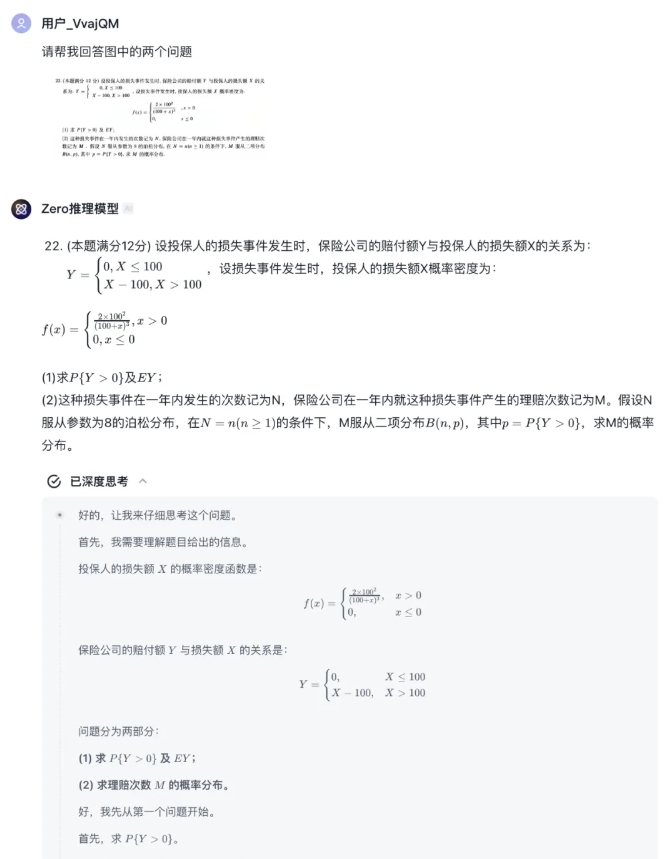

ユーザーは、Zhipu Qingyan プラットフォームの「Zero Inference Model」エージェントで GLM-Zero-Preview を無料で体験できるようになりました。このプラットフォームはテキストと画像のアップロードをサポートしており、モデルは完全な推論プロセスを出力します。同時に、開発者は Zhipu オープン プラットフォームの API を通じてこのモデルを呼び出すこともできます。

GLM-Zero-Preview と OpenAI の o3 モデルの間にはまだ一定のギャップがありますが、Zhipu Huazhang Technology Co., Ltd. は反復強化学習テクノロジーの最適化を継続する予定であり、機能を拡張するために間もなく GLM-Zero の正式バージョンをリリースする予定です。数理論理学からより一般的なテクノロジー領域に至るまで、深い思考を学びます。

モデルのパフォーマンスの観点から、GLM-Zero-Preview は、モデルの深い推論能力を強化する際の強化学習の重要性を示しています。トレーニングの量が増加するにつれて、深い推論などの側面におけるモデルのパフォーマンスは着実に向上しました。推論段階におけるモデルのスケーリング則も検証されています。つまり、モデルが考慮できるトークンの数が増加し、より多くの計算が必要になるにつれて、モデルによって得られる結果の品質も着実に向上します。 GLM-Zero-Preview は、人間の思考と意思決定のプロセスに似た推論プロセスで、自律的な意思決定、問題の分解を実現し、複数の方法で問題を解決することを試みることができます。

実際のテスト ケースでは、GLM-Zero-Preview は論理的な抜け穴を特定し、論理的推論の観点から複数の仮定をシミュレートする機能を実証しました。数学に関しては、このモデルは強力な帰納的および演繹能力を備えており、複雑な数学的演算を迅速に処理でき、2025 年の大学院数学 I 試験において優秀な大学院生のレベルに達しています。プログラミングの面では、GLM-Zero-Preview は複数のプログラミング言語を上手に使用でき、開発者がコードを迅速に作成できるようにします。

知恵のスペクトルの明確な言葉:

https://chatglm.cn/main/gdetail/676411c38945bbc58a905d31?lang=zh

Zhipuオープンプラットフォーム:

https://bigmodel.cn/dev/api/normal-model/glm-zero-preview

GLM-Zero-Preview の開始は、Zhipu Huazhang が人工知能推論の分野で大きな進歩を遂げたことを示しており、その自由でオープンな戦略により、開発者とユーザーのエクスペリエンスとフィードバックが促進され、将来のモデルの反復最適化に貴重なデータが提供されます。 人工知能技術のさらなる進歩を促進するために、GLM-Zero の正式版のリリースを楽しみにしています。