OpenAI のテキストからビデオへの AI モデル Sora が論争を巻き起こしました。 Sora の初期テストに参加したアーティストのグループは、OpenAI の使用に不満を抱き、モデルへの早期アクセスを漏洩し、抗議する公開書簡を Hugging Face プラットフォームに公開しました。彼らは、OpenAIがアーティストを無償の研究開発や広報ツールとして利用し、彼らの創造性を利用して無給労働を行っていると非難し、OpenAIの厳格なコンテンツ審査システムに不満を表明した。この事件は、AI モデルの開発におけるアーティストの権利に関する議論を引き起こしました。

OpenAIは今年2月にテキストからビデオへのAIモデル「Sora」を初めてプレビューして以来、具体的なアップデートを提供していない。最近、OpenAI の新しいテキスト-ビデオ AI モデル Sora に参加しているテスト アーティストのグループが、同社への不満を理由にモデルへの早期アクセスを漏洩しました。

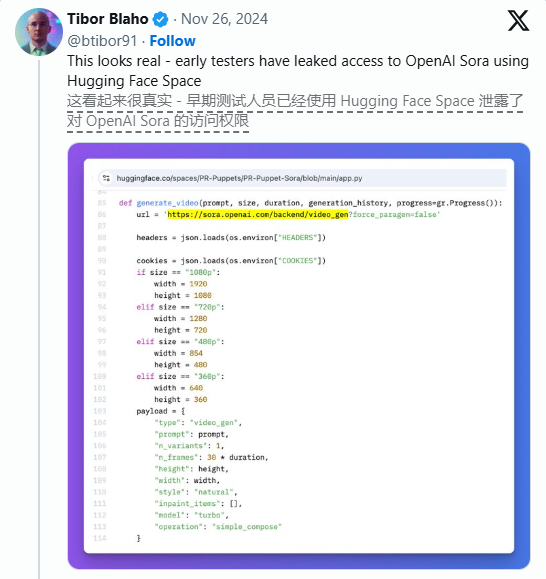

AI開発プラットフォームHugging Faceを通じてSora APIに関連するプロジェクトをリリースし、早期アクセス認証トークンを使用してユーザーがビデオを生成できるフロントエンドインターフェイスを作成しました。このフロントエンドを通じて、ユーザーは短いテキストの説明を入力し、最大 1080p の解像度で最大 10 秒のビデオを生成できます。

その後、多くのユーザーが生成されたビデオの例をソーシャル メディアで共有しましたが、そのほとんどには OpenAI の視覚的なウォーターマークが含まれていました。しかし、約 1 時間開いた後、フロントエンド インターフェイスが動作しなくなり、OpenAI と Hugging Face がアクセス権を取り消した可能性があると推測されています。

ネチズンが生成した事件: 「フロリダの私道でバスケットボールをしている 10 代の男性。晴れた午後」

ネットユーザーが生成したケース: "0": "柔らかいクリーム色の枕の上に座っている、印象的な青い目をしたふわふわの子猫のクローズアップ。子猫は頭をわずかに片側に傾け、耳を注意深く立てています。背景はヒントが詰まった、暖かく柔らかな照明の部屋

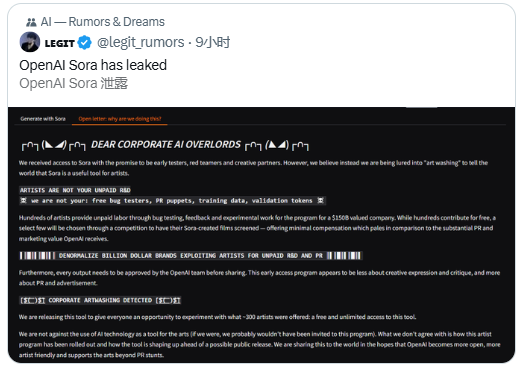

アーティストらは公開AIモデルプラットフォーム「Hugging Face」上で抗議文を公開し、AIモデルがテスト過程で同社に使用され「無給の研究開発および広報ツール」になったと主張した。

アーティストらは公開書簡の中で、「エンタープライズ AI の主の皆様、Sora へのアクセスが与えられたとき、私たちは初期テスターおよびクリエイティブ パートナーになることが約束されました。しかし、私たちは単に『芸術』に誘惑されただけだと信じています」と述べています。ソラのホワイトウォッシングとプロモーションの行為だ」とし、アーティストは同社の「無料のバグテスター、プロモーションツール、トレーニングデータ、検証トークン」ではないと強調した。

これらのアーティストは、芸術創作のツールとして AI テクノロジーを使用することに反対しているわけではありませんが、OpenAI の早期アクセス プログラムには不満を抱いており、このプログラムはアーティストの創造性を無償労働として悪用していると考えられています。

彼らは、OpenAIが作品に見返りを与えずにプロジェクトの「芸術的功績」を提供したとして批判した。特に彼らは、Sora のコンテンツに対する OpenAI のモデレーション要件に反対し、生成された各コンテンツは共有する前に OpenAI チームの承認が必要であると述べました。

メディアからの問い合わせに対し、OpenAIはSoraリークの信憑性を確認しなかったが、「リサーチプレビュー」に参加するアーティストは自主的なものであり、フィードバックを提供したりツールを使用したりする必要はないと強調した。 OpenAIの広報担当者は、「Soraはまだ研究段階にあり、クリエイティビティと安全対策のバランスをとるために懸命に取り組んでいる。数百人のアーティストの参加により、新機能と安全対策の優先順位付けに役立つ。さらに、OpenAIはサポートを続けることを約束する」と述べた。助成金、イベントを通じて会社に貢献し、その他の方法で参加アーティストをサポートします。

これに先立ち、OpenAIの元最高技術責任者ミラ・ムラティ氏は、Soraは年末までにリリースされる予定だが、モデルの影響に確信が持てないものはリリースしないつもりだと述べた。

最近の Reddit の Q&A で、最高製品責任者の Kevin Weil 氏は、Sora がまだリリースされていない理由は、機能を拡張し、セキュリティを確保し、詐欺師の問題を防ぐ必要があるからであると述べました。

ハイライト:

アーティストたちは、Sora モデルをリークすることで、OpenAI によるそれらの自由な使用に抗議しました。

彼らはOpenAIの初期テストプログラムを批判し、同社が創造性を宣伝に利用していると主張した。

OpenAIはテストへの参加は任意であると回答し、アーティストをサポートし続けることを約束した。

この事件は、AI技術の開発における倫理と権利の課題を浮き彫りにするとともに、AI企業とアーティストとの協力モデルについて人々が熟考するきっかけとなった。今後のAIの発展においては、技術の進歩とアーティストの利益をどう両立させるかが真剣に考えられる課題となるだろう。 OpenAIの回答ではアーティスト支援を継続するとしているが、具体的な施策や効果はまだ分からない。