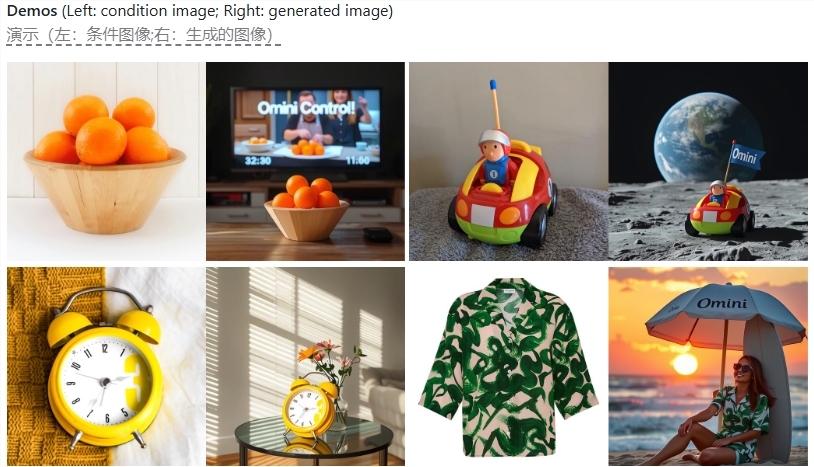

シンガポール国立大学の研究チームは、OminiControl と呼ばれる新しい画像生成フレームワークを開発しました。これは、独創的なパラメータ再利用メカニズムによって画像生成の柔軟性と効率を大幅に向上させます。 OminiControl は、事前にトレーニングされた拡散トランスフォーマー モデル (DiT) を画像条件と組み合わせて使用し、強力なテーマ統合と空間調整機能を実現します。追加パラメーターがわずかでも、驚くべき結果を達成できます。 被写体ベースの生成や、エッジや深度マップなどの情報を使用した空間位置合わせなど、さまざまな画像調整タスクを処理できます。これは、被写体主導の画像生成タスクにおいて大きな利点を示します。

今日のデジタル時代において、画像生成技術は驚くべきペースで進歩しています。最近、シンガポール国立大学の研究チームは、画像生成の柔軟性と効率の向上を目的とした新しいフレームワーク OminiControl を提案しました。このフレームワークは、画像条件を組み合わせ、学習済みの拡散変換器 (DiT) モデルを最大限に活用することで、これまでにない制御機能を実現します。

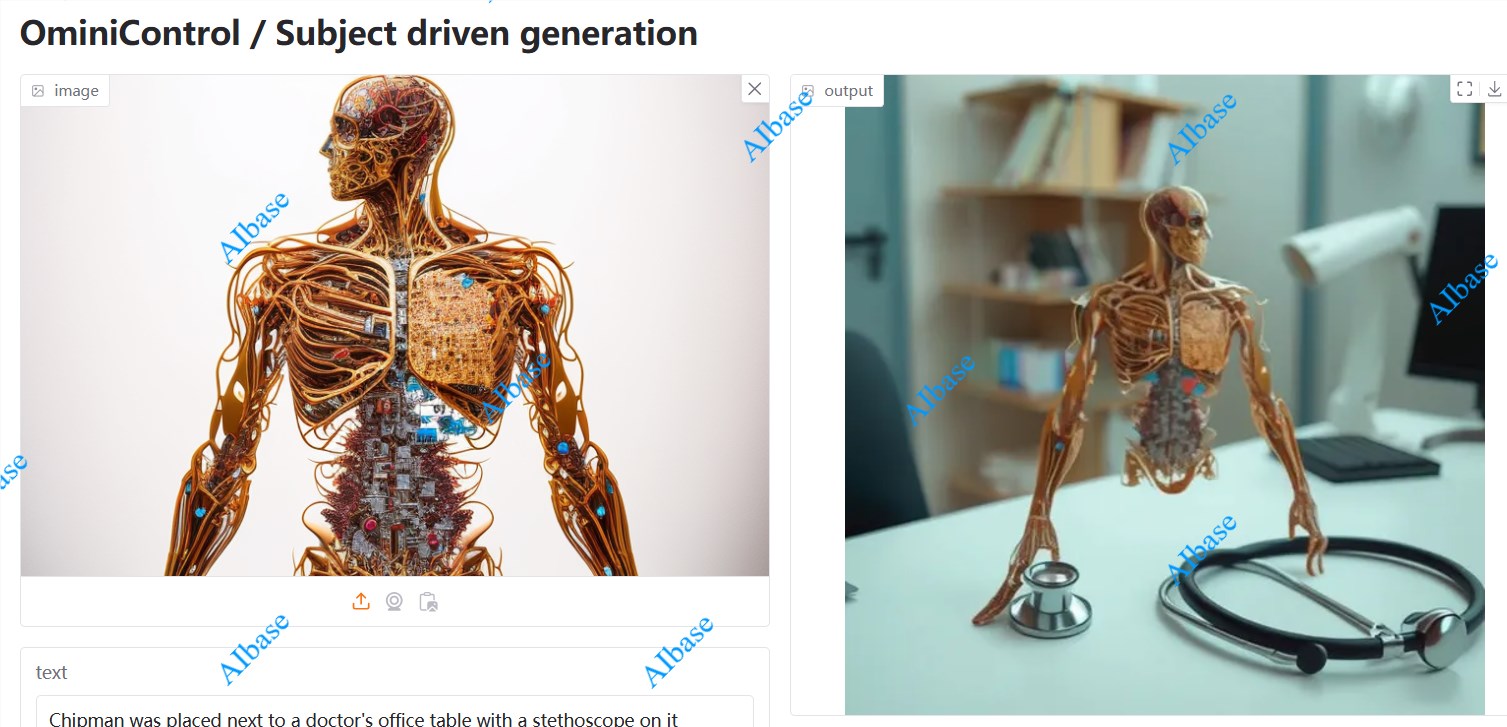

簡単に言えば、素材画像を提供すれば、OminiControlを使用して素材画像のテーマを生成された画像に統合できます。たとえば、編集者が左の素材画像をアップロードし、「チップマンが診察室のテーブルの隣に置かれ、テーブルに聴診器が置かれています。」というプロンプトワードを入力すると、次のような比較的一般的なエフェクトが生成されます。 :

OminiControl の中核は、その「パラメータ再利用メカニズム」にあります。このメカニズムにより、DiT モデルは、より少ない追加パラメータで画像条件を効果的に処理できるようになります。これは、既存のメソッドと比較して、OminiControl が強力な機能を実現するために必要なパラメーターは 0.1% ~ 0.1% だけであることを意味します。さらに、被写体ベースの生成や、エッジや深度マップなどの空間位置合わせ条件の適用など、複数の画像調整タスクを均一に処理できます。この柔軟性は、トピック主導の生成タスクに特に役立ちます。

研究チームはまた、OminiControl が生成された画像をトレーニングすることでこれらの機能を実現しており、これはトピック駆動型の生成にとって特に重要であることも強調しました。広範な評価の結果、OminiControl は、トピック駆動型生成タスクと空間的に調整された条件付き生成タスクの両方において、既存の UNet モデルおよび DiT 適応モデルを大幅に上回りました。この研究結果はクリエイティブ分野に新たな可能性をもたらします。

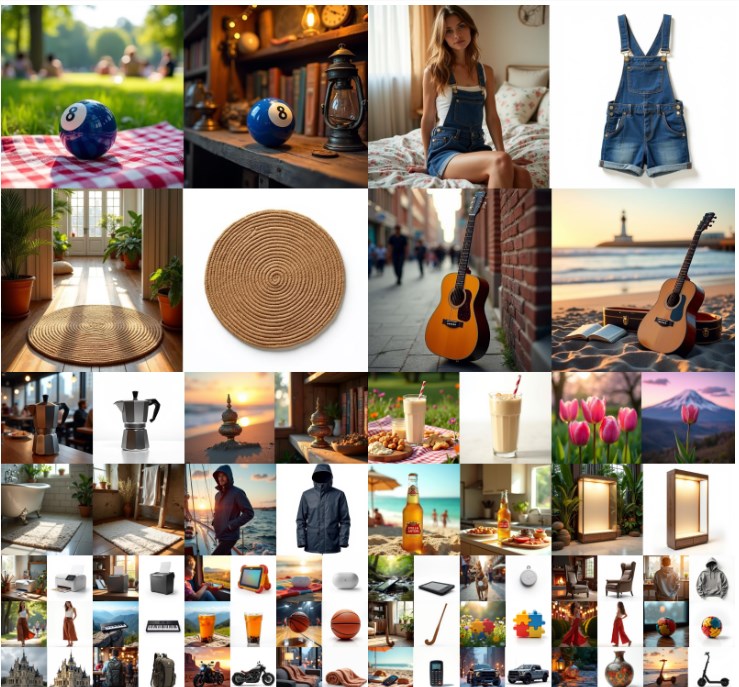

より広範な研究をサポートするために、チームは Subjects200K と呼ばれるトレーニング データセットもリリースしました。これには 200,000 を超える同一性の一貫した画像が含まれており、効率的なデータ合成パイプラインを提供します。このデータセットは、研究者がトピックのコンセンサス生成タスクをさらに調査するのに役立つ貴重なリソースを提供します。

Omini の発売により、画像生成の効率と効果が向上するだけでなく、芸術的創作の可能性も広がります。テクノロジーが進化し続けるにつれて、将来の画像生成はよりインテリジェントでパーソナライズされたものになるでしょう。

オンライン体験: https://huggingface.co/spaces/Yuanshi/OminiControl

github:https://github.com/Yuanshi9815/OminiControl

論文: https://arxiv.org/html/2411.15098v2

ハイライト:

OminiControl はパラメータ再利用メカニズムを使用して、画像生成制御をより強力かつ効率的にします。

このフレームワークは、エッジ、深度マップなどの複数の画像条件タスクを同時に処理して、さまざまなクリエイティブのニーズに適応できます。

チームは、さらなる研究と探索を促進するために、200,000 枚を超える画像のデータセットである Subjects200K をリリースしました。

OminiControl の登場は、画像生成テクノロジーにおける新たなマイルストーンを示します。その効率的なパラメータ再利用メカニズムと強力なマルチタスク機能は、アーティストや研究者に強力なツールを提供し、将来の画像生成テクノロジーの無限の可能性を予告します。 詳細を確認し、OminiControl を体験するには、提供されているリンクに気軽にアクセスしてください。