Google Gemini AI は最近、実験的アプリケーション AnyChat を通じて複数のビジュアル ストリームを同時に処理する驚くべき能力を実証しました。これは人工知能の分野では初めてです。 AnyChat を使用すると、Gemini AI はリアルタイムのビデオと静止画像を同時に処理できるようになり、従来の AI が単一の視覚入力しか処理できないという制限を打ち破り、複数の分野で人工知能を応用する新たな可能性が開かれます。このテクノロジーはユーザー エクスペリエンスを向上させるだけでなく、より重要なことに、より強力なビジュアル AI アプリケーションの構築に役立つ新しいツールを開発者に提供します。

Google の Gemini AI は最近、目覚ましい技術的進歩を遂げ、複数のビジュアル ストリームを同時に処理できるようになりました。これは、人工知能の分野において前例のない成果です。この機能のデビューは、Google の主流プラットフォームではなく、「AnyChat」と呼ばれる実験的アプリケーションを通じて行われます。

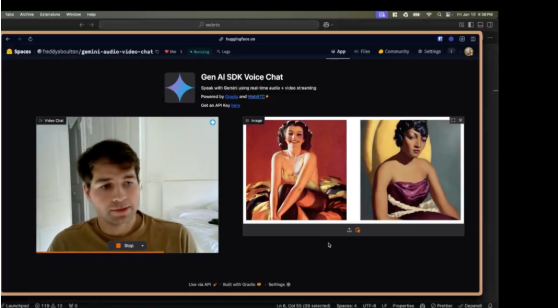

Gemini AI のこの新しい機能により、ビデオをリアルタイムで視聴できるだけでなく、静止画像も同時に分析できるようになり、人工知能が単一の視覚入力しか処理できないという以前の制限が打ち破られました。 Gradio の機械学習責任者、Ahsen Khaliq 氏はインタビューで、「AI と会話して、ライブビデオや共有したい画像を AI に処理させることができるようになりました」と語った。

AnyChat がこのマルチストリーム処理機能の実現に成功したのは、Gemini AI の高度なニューラル ネットワーク アーキテクチャのおかげです。この機能は Gemini の API にすでに存在していますが、Google の公式アプリケーションではまだ一般ユーザーに公開されていません。 ChatGPT を含む多くの AI プラットフォームは現在、単一ストリームからの入力のみを処理できるため、画像をアップロードする際のライブ ビデオ ストリーミングが無効になります。

このテクノロジーの潜在的な用途は膨大です。生徒はリアルタイムで数学の問題を提示し、Gemini に教科書を見せて段階的に指導することができます。アーティストは進行中の作品や参照画像を共有して、構成やテクニックに関するリアルタイムのフィードバックを得ることができます。

AnyChat の技術的進歩は偶然ではなく、開発チームは Gemini の技術アーキテクチャと緊密に連携してその機能を拡張することに成功しました。これらの特別な権限により、AnyChat は会話の一貫性に影響を与えることなく、複数の視覚入力を同時に追跡および分析できます。開発者は、単純なコードでこの機能を複製し、ビデオ ストリーミングと画像のアップロードをサポートするカスタム プラットフォームを作成できます。

AnyChat はまだ実験段階にありますが、マルチストリーム AI ビジョン処理の現実世界の可能性を実証することに成功しました。医学、工学、教育などの分野であっても、双子座の新しい能力は破壊的な変化をもたらすでしょう。

AnyChat プロジェクト:AnyChathttps://huggingface.co/spaces/akhaliq/anychat

ハイライト:

Gemini AI は、これまでの限界を打ち破り、リアルタイムの動画と静止画の同時処理を実現します。

AnyChat プラットフォームは、教育、芸術、その他の分野における AI の幅広い応用可能性を実証しています。

開発者は、Gemini のテクノロジーを簡単に活用して、独自のビジュアル AI アプリケーションを構築できます。

全体として、Gemini AI のマルチストリーム視覚処理機能は、人工知能テクノロジーにおける大きな進歩を示しており、AnyChat の応用の成功は、AI 開発の将来の方向性に対する新たな参考となります。テクノロジーが成熟し続けるにつれて、Gemini AI はより多くの分野でその大きな可能性を発揮し、より便利でインテリジェントな生活体験を人間社会にもたらすと考えられています。