Deepseekは、2025年1月20日の学習トレーニングの強化に基づいて、最初のDeepSeek-R1をリリースしました。このモデルは、複数のベンチマークテストでOpenai-O1-1217よりもかなりまたはさらに優れたパフォーマンスを示しています。 DeepSeek-R1は直接トレーニングされていませんが、DeepSeek-V3-Baseモデルに基づいて、マルチステージトレーニングとコールドスタートアップデータを通じて、DeepSeek-R1-Zero)読み取り可能な混合言語およびその他の使用を克服しました問題は、最終的に大幅なパフォーマンス改善を達成しました。このモデルはオープンソースであり、競争力のあるAPIアクセス価格を提供し、ユーザーにより便利で経済的な選択を提供します。

2025年1月20日、Deepseekは、学習の強化(RL)トレーニングを通じて訓練された最初の推論モデルDeepSeek-R1の発売を発表しました。 DeepSeek-R1は、DeepSeek-V3-Baseモデルに基づいており、マルチステージトレーニングとコールドスタートアップデータを使用して、推論機能を改善します。

Deepseekの研究者は、最初にDeepseek-R1-Zeroを開発しました。これは、微調整を監督する準備ステップなしで、大規模な強化学習トレーニングによって完全に強化されるモデルです。 DeepSeek-R1-Zeroは、たとえば、AIME2024テストでは、そのパス@1スコアが15.6%から71.0%に増加したことを示しています。ただし、DeepSeek-R1-Zeroには、読みやすさや混合言語など、いくつかの問題があります。

これらの問題を解決し、推論のパフォーマンスをさらに向上させるために、DeepSeekチームはDeepSeek-R1を開発しました。 DeepSeek-R1は、学習を強化する前に、マルチステージトレーニングとコールドスタートアップデータを導入しました。 具体的には、研究者は最初に数千のコールドスタートアップデータを収集して、DeepSeek-V3ベースモデルを微調整しました。 その後、彼らはdeepseek-r1-zeroのトレーニングのような推論の合理的な学習を実施しました。 学習プロセスを強化することは収束に近い場合、学習チェックポイントを強化するためにサンプルを拒否することにより、新しい微調整データを作成し、執筆分野のDeepSeek-V3の分野の監視データと組み合わせて作成しました。自己認知、そしてDeepSeek-V3ベースモデルの再トレーニング。 最後に、すべてのシナリオのプロンプトを使用して、微細なチェックポイントを強化します。

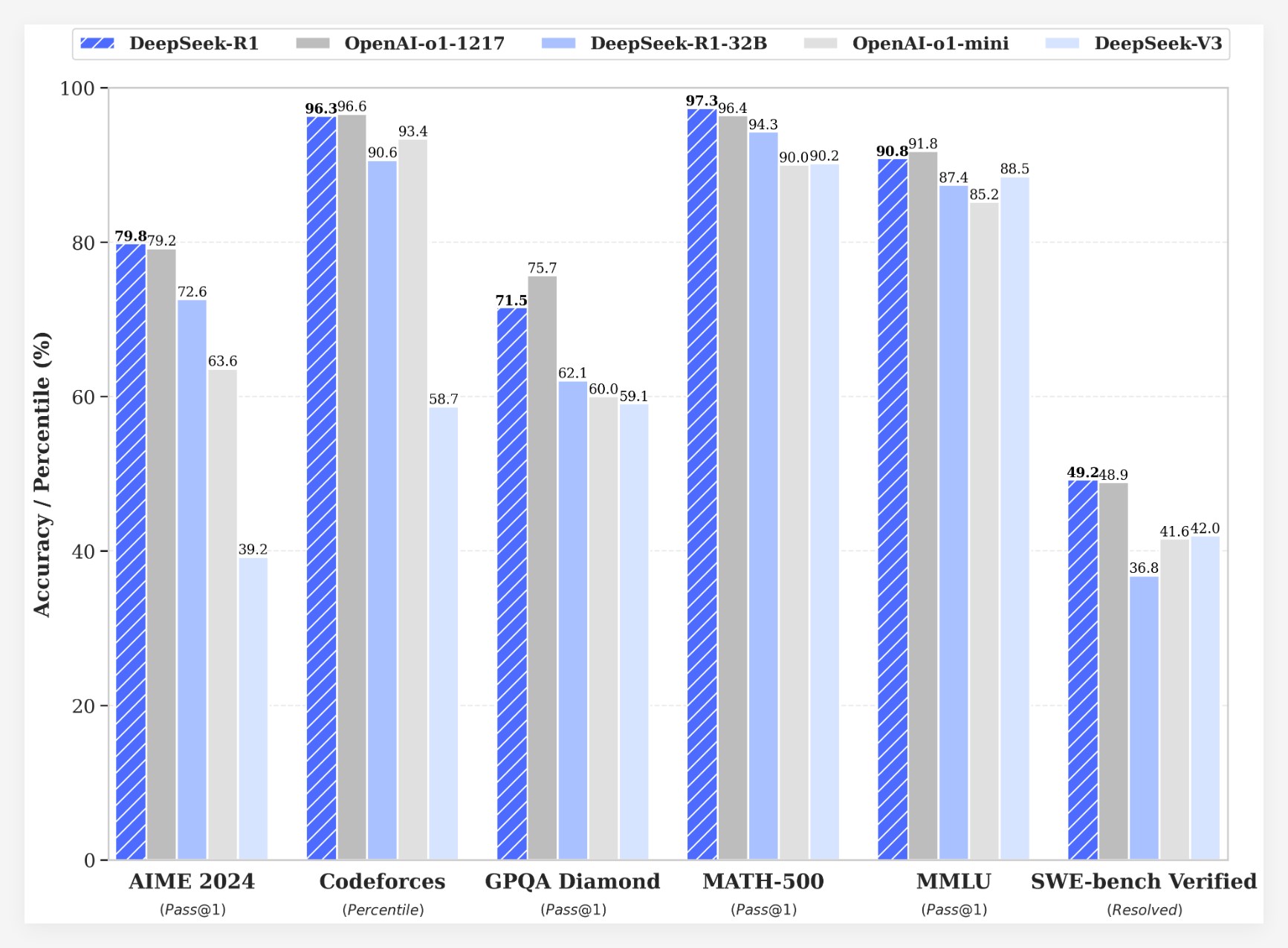

DeepSeek-R1は、複数のベンチマークテストで顕著な結果を達成しました。

•AIME2024テストでは、DeepSeek-R1のパス@1スコアは79.8%に達し、OpenAI-O1-1217よりわずかに高くなりました。

•Math-500試験では、Deepseek-R1のパス@1スコアは97.3%に達しました。これはOpenai-O1-1217と同じです。

•コード競争タスクでは、DeepSeek-R1は、人間の出場者の96.3%以上であるCodeForCessで2029年のELO評価を受けました。

•ナレッジベンチマークテスト(MMLU、MMLU-PRO、GPQAダイヤモンドなど)では、DeepSeek-R1のスコアは90.8%、84.0%、71.5%であり、DeepSeek-V3よりも大幅に優れています。

•DeepSeek-R1は、他のタスク(クリエイティブライティング、一般的なQ&A、編集、概要など)でもうまく機能しています。

さらに、DeepSeekは、DeepSeek-R1の推論能力を小さなモデルに調査しました。研究では、小さなモデルで強化された学習を適用するよりも、DeepSeek-R1から直接蒸留する方が良いことがわかっています。 これは、推論能力を改善するために、大きな基本モデルの発見の推論モードが不可欠であることを示しています。 Deepseekには、オープンソースのDeepSeek-R1-Zero、Deepseek-R1、およびQwenおよびLlamaベースの集中モデル(1.5b、7b、8b、14b、32b、70b)があります。 DeepSeek-R1の発売は、大規模な言語モデルの推論能力を向上させる際の学習を強化する上で大きな進歩を示しています。

アドバンテージコストに関しては、DeepSeek-R1は非常に競争力のある価格設定戦略を提供します。 APIアクセス価格は0.14ドル(キャッシュヒット)および入力トークンあたり0.55ドル(キャッシュ)で、出力トークンは100万ドルあたり2.19ドルです。この価格戦略は、他の同様の製品よりも魅力的であり、ユーザーによって「ゲームルールの変更」と呼ばれています。現在、公式のウェブサイトとAPIがオンラインになっています! https://chat.deepseek.comにアクセスして、DeepHinkを体験してください!

DeepSeek-R1のリリースは、コミュニティでの激しい議論を引き起こしました。多くのユーザーは、モデルのオープンソースの特性とコストの利点を賞賛し、開発者により多くの選択肢と自由を提供すると考えています。ただし、一部のユーザーは、将来のバージョンをさらに最適化できることを期待して、モデルのコンテキストウィンドウのサイズに疑問を呈しています。

Deepseekチームは、AGI(一般的な人工知能)に対するユーザーの期待を満たすための高度なデータ分析など、将来より多くの機能を立ち上げることを計画しながら、モデルのパフォーマンスとユーザーエクスペリエンスを改善するために懸命に努力し続けると述べました。

DeepSeek-R1の発売は、大規模な言語モデルの推論能力を向上させる学習を強化する大きな可能性を示しているだけでなく、AIフィールドの開発に新しい方向性と可能性をもたらします。そのオープンソースの特性と競争力のある価格設定戦略は、AIテクノロジーの普及と適用をさらに促進します。