抱きしめるフェイスチームは、2億5600万と5億のパラメーターであるSmolvlm-256mとSmolvlm-500mの2つの軽量AIモデルをリリースしました。 これらの2つのモデルは、1GB未満のメモリを持つデバイスに特に適しており、開発者に低コストで高効率のデータ処理ソリューションを提供します。その効率的なパフォーマンスは、特に小学校の科学チャートを扱う際に、さまざまなベンチマークで多くの大規模なモデルを上回り、教育と研究における大きな可能性を示しています。

最近、人工知能開発プラットフォームであるHugging Faceのチームが、2つの新しいAIモデル、Smolvlm-256MとSmolvlm-500mをリリースしました。彼らは、2つのモデルは、ラップトップなどの1GB未満のメモリを持つデバイスに特に適した画像、短いビデオ、テキストデータを同時に処理できる最小のAIモデルであると自信を持って主張しています。このイノベーションにより、開発者は大量のデータを処理する際に、より高いコストでより高い効率を達成できます。

これら2つのモデルのパラメーターは、それぞれ2億5600万と5億です。つまり、問題を解決する能力もそれに応じて改善されます。 Smolvlmシリーズが実行できるタスクには、画像やビデオクリップの説明、スキャンテキストやチャートなどのPDFドキュメントとそのコンテンツに関する質問に答えることが含まれます。これにより、教育や研究などの多くの分野で幅広いアプリケーションの見通しがあります。

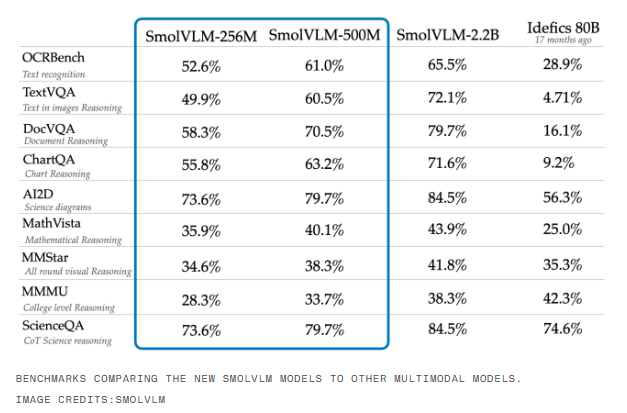

モデルのトレーニング中、ハグするフェイスチームは、「大釜」と呼ばれる50の高品質の画像とテキストデータセットを活用し、Docmatixと呼ばれるファイルスキャンと詳細なペアリングデータセットを活用しました。両方のデータセットは、FaceのM4チームを抱き締めることで開発され、マルチモーダルAIテクノロジーの開発に焦点を当てました。 Smolvlm-256mとSmolvlm-500mは、IDEFICS80Bなどのさまざまなベンチマークテストで多くの大規模なモデルを上回っており、特にAI2Dテストでは、小学生向けの科学チャートを分析する能力で際立って実行することは注目に値します。

ただし、手頃な価格で用途の広いものの、小さなモデルは、複雑な推論タスク上の大きなモデルと同様に機能しない場合があります。 Google Deepmind、Microsoft Research Institute、およびケベックのMILA Instituteの調査では、多くの小さなモデルがこれらの複雑なタスクで失望して機能したことが示されました。研究者たちは、これは小さなモデルがデータの表面特徴を特定する傾向があるためである可能性があると推測しており、新しい状況でこの知識を適用する際には不cru慎なように見えます。

FaceのSmolvlmファミリーのモデルを抱きしめることは、小さなAIツールであるだけでなく、さまざまなタスクを扱う際に印象的な能力を示しています。これは間違いなく、低コストで効率的なデータ処理を実現したい開発者にとって良い選択です。

Smolvlmシリーズのモデルの出現により、リソース制約のあるデバイスでの優れたパフォーマンスがAIテクノロジーの開発に新しい方向性を提供します。複雑なタスクの改善の余地はまだありますが、その低いしきい値と高効率により、多くの開発者が注目を集めることができます。 将来的には、より多くの分野でのSmolvlmシリーズモデルのアプリケーションとさらなる最適化を見ることを楽しみにしています。