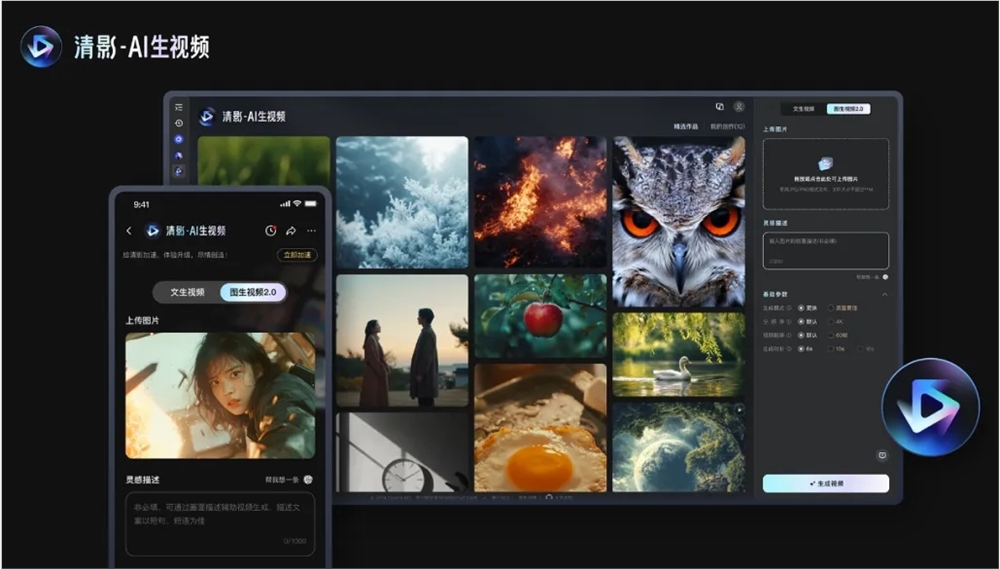

Beijing Zhipu Huazhang Technology Co.、Ltd。は、ビデオ生成の分野で大きなブレークスルーを行ったCogvideox v1.5オープンソースモデルを開始しました。 8月上旬にリリースされた後、Cogvideoxシリーズは、その主要なテクノロジーと開発者に優しい機能を備えた業界の焦点となりました。この更新により、長くて高解像度のビデオ生成をサポートすること、画像生成ビデオの品質と意味的理解の大幅な改善など、多くの改善がもたらされ、ユーザーがより良いAIビデオ生成エクスペリエンスを提供します。 注目に値するのは、新しいバージョンがQingyingプラットフォームとコグサウンドサウンドエフェクトモデルを統合し、ビデオ生成エコシステムをさらに改善することです。

このオープンソースの内容には、2つのモデルが含まれています。CogvideoxV1.5-5BとCogvideox v1.5-5B-I2V。新しいバージョンは同時にQingingプラットフォームで発売され、新しく発売されたコグサウンドサウンドエフェクトモデルと組み合わさって、品質改善、超高解像度解像度サポート、さまざまな再生シナリオ、マルチチャネル出力、およびサウンドエフェクトを備えたAIビデオ。

技術レベルでは、Cogvideox v1.5は、自動フィルタリングフレームワークを介して動的接続を欠いているビデオデータをフィルターし、エンドツーエンドのビデオ理解モデルであるCogVLM2-Captionを使用して、正確なビデオコンテンツの説明を生成し、テキスト理解と指導のコンプライアンスを改善します機能。さらに、新しいバージョンは、効率的な3次元変動自動エンコーダー(3D VAE)を採用して、コンテンツの一貫性の問題を解決し、3次元テキスト、時間、空間を統合するトランスアーキテクチャを独立して開発し、従来の交差モジュールをキャンセルします。 、および専門家の適応層正規化テクノロジーは、拡散モデルでのタイムステップ情報の利用を最適化します。

トレーニングに関しては、Cogvideox v1.5は効率的な拡散モデルトレーニングフレームワークを構築し、さまざまな並列コンピューティングと時間最適化技術を通じて長いビデオシーケンスの迅速なトレーニングを実現します。同社は、ビデオ生成の分野でのスケーリング法の有効性を確認し、将来のデータボリュームとモデルの尺度を拡大し、ビデオ情報をより効率的に圧縮し、テキストとビデオのコンテンツをよりよく統合する計画を立てています。

コード:https://github.com/thudm/cogvideo

モデル:https://huggingface.co/thudm/cogvideox1.5-5b-sat

Cogvideox v1.5のオープンソースは、ビデオ生成テクノロジーの開発に新しい推進力を提供し、開発者により強力なツールを提供します。 Zhipu Huazhangの継続的な技術革新とオープンソースの精神は認識に値し、このモデルの将来のアプリケーションの見通しは楽しみにしています。 Cogvideox v1.5に基づくより革新的なアプリケーションを楽しみにしています。