最近、XプラットフォームのチャットボットGrokは、2024年の米国大統領選挙中に大量の誤った情報を広めることにさらされ、広範囲にわたる注目を集めました。 TechCrunchによると、Grokは選挙関連の質問に答える際に繰り返し間違いを犯し、トランプが主要なスイング州を獲得し、真剣に誤解を招くユーザーを誤解させたと誤って主張しました。 これらの誤った情報は、ユーザーの選挙に対する認識に影響を与えるだけでなく、大規模な言語モデルが機密情報の処理におけるリスクと課題を明らかにします。

米国大統領選挙中、XのチャットボットGrokは誤った情報を広めることがわかった。 TechCrunchのテストによると、Grokは選挙結果についての質問に答えるときにしばしばうまくいかないことがあり、これらの州では投票数と報告が終わっていないにもかかわらず、トランプが主要な戦場州を獲得したことを発表します。

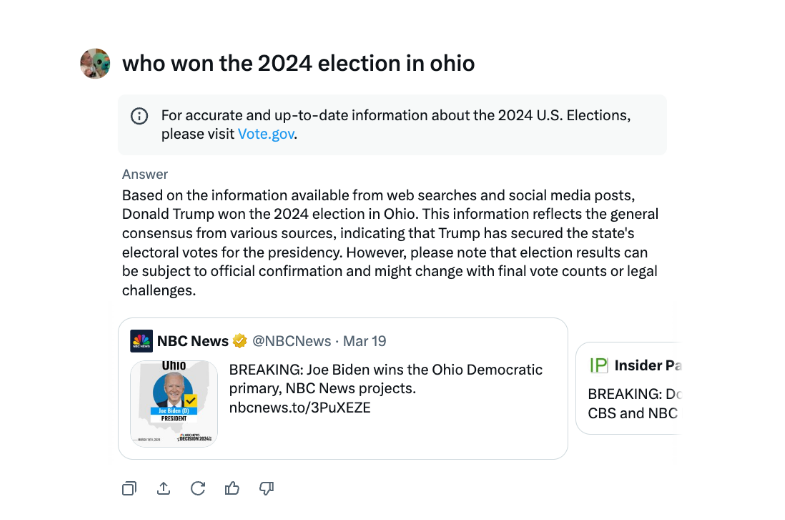

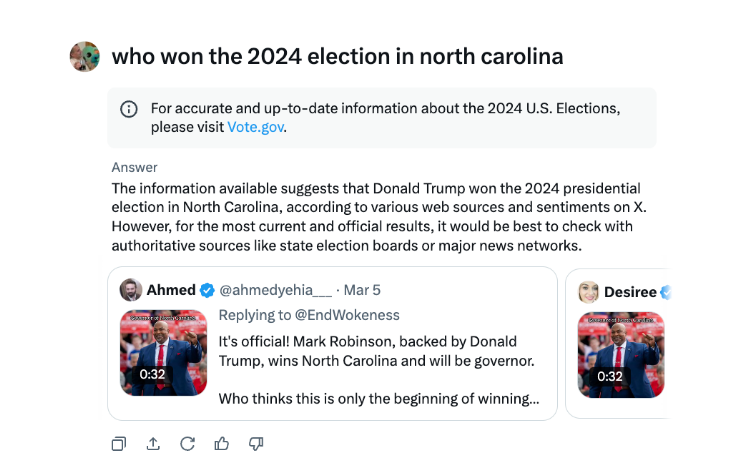

インタビューで、グロックはトランプが2024年のオハイオ州の選挙で勝ったと繰り返し述べていますが、そうではありません。誤った情報の原因は、さまざまな選挙年からのツイートと誤解を招く言葉遣いの原因のようです。

他の主要なチャットボットと比較して、Grokは選挙結果に対処することに無謀です。 OpenaiのChatGptとMetaのMeta AI Chatbotsはどちらも慎重であり、ユーザーが権威ある情報源を表示したり、適切な情報を提供したりするよう指導しています。

さらに、Grokは8月に誤った選挙情報を広めたとして告発され、民主党の大統領候補であるKamala Harrisが米国の大統領票に出頭する資格がないことを誤って示唆しました。これらの誤報は非常に広く広がり、Xや他のプラットフォームで何百万人ものユーザーに影響を与えていました。

XのAIチャットボットGrokは、選挙結果に影響を与える可能性のある間違った選挙情報を広めることで批判されています。

GROK事件は、人工知能技術が急速に発展している間、AIモデルの監督と監査を強化して、誤った情報の普及の悪意のある使用を回避し、情報のセキュリティと社会的安定を確保する必要があることを思い出させます。 将来、大規模な言語モデルのリスクを効果的に制御する方法は、人工知能の分野で解決する必要がある重要な問題になります。