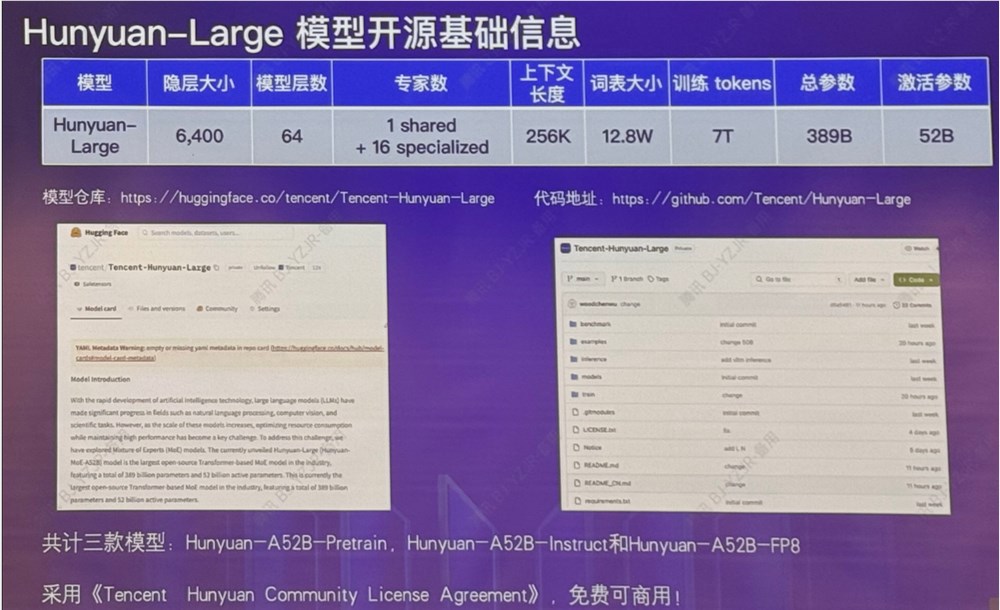

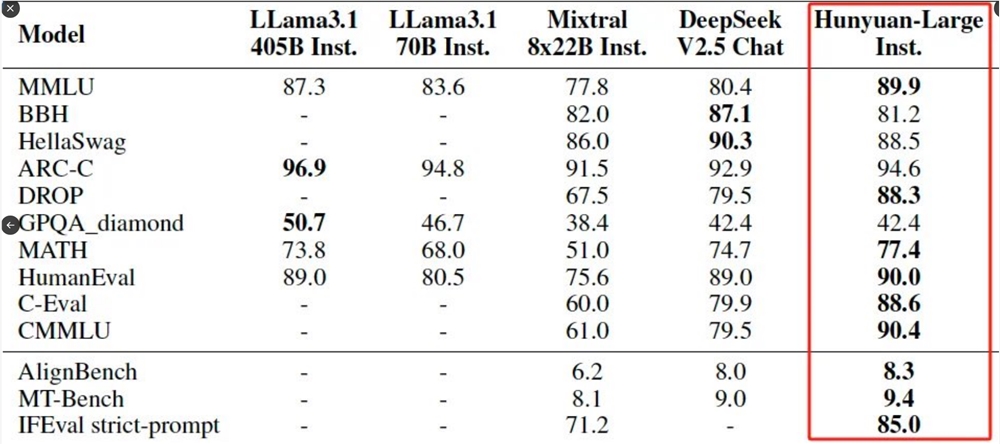

Tencentは本日、Hunyuan-Largeと呼ばれる大規模な言語モデルのオープンソースを発表し、398Bのパラメータースケールと52Bのアクティベーションパラメーターボリュームを発表しました。このモデルは、複数の権威あるベンチマークでうまく機能し、Llama 3.1やMixtralなどの同様のオープンソースモデルを上回ります。 その技術革新には、高品質の合成データの適用が含まれます。これは、自然データが不十分な問題を効果的に解決し、最大256kのテキストシーケンスをサポートし、長いテキスト処理機能を大幅に改善します。 さらに、Tencentは「Penguin Scroll」と呼ばれる評価データセットも開設しており、業界での高品質の長いテキスト評価セットの欠如を補うことを目指しており、大きなモデル技術の開発を促進しています。

Tencentは本日、オープンソースのMoe Large Language Model Hunyuan-Largeをリリースし、合計パラメーターボリュームは398bと52bのアクティベーションパラメーターボリュームをリリースしました。公的評価の結果は、Tencent Hunyuan LargeがCMMLU、MMLU、CEVA1、MATH、その他の包括的な評価セット、および中国および英語のNLPタスク、コード、数学などの9つの次元が、そのようなファーストクラスのオープンソースを表す9つの次元であることを示しています。 llama3.1およびmixtral。

このモデルは、技術革新において高品質の合成データを達成し、合成データを使用して自然データの欠点を効果的に扱うことができることが理解されています。コンテキスト処理機能の観点から、事前に訓練されたモデルは、最大256kのテキストシーケンスをサポートし、長いコンテキストタスクを処理する能力を大幅に向上させます。

同時に、Tencent Hunyuanは、業界での実際の長い記事のレビューセットの欠点を埋めるために、Tencent HunyuanがすぐにオープンソースのPenguin Scroll Reviewセットを産業応用研究を支援することを発表しました。自己開発のペンギン巻物は、財政、法律、学術論文などのさまざまな自然な長いテキストに基づいています。

Tencent Hunyuanの大規模な言語モデルのリリースとペンギンスクロール評価セットのオープンソースは、自然言語処理と人工知能の開発を促進するためのより強力な言語モデルと評価ツールを業界に提供します。

公式ウェブサイトの住所:https://llm.hunyuan.tencent.com

Hunyuan-LargeのオープンソースとPenguin Scroll Reviewの同時リリースは、大規模な言語モデルの分野におけるTencentのもう1つの大きなブレークスルーをマークし、学術研究と産業用アプリケーションに強力なサポートを提供します。人工知能の開発。