Nvidiaは、その研究チームが、ヒューマノイドロボットの動きと動作を制御することに特化した150万のパラメーターしかない小規模だが効率的なニューラルネットワークであるHover(Humanoid Multifunction Controller)と呼ばれる新しいニューラルネットワークを開発したことを発表しました。ホバーのユニークな点は、人間の動きで潜在意識のプロセスをキャプチャする能力であり、ロボットが扱いにくいプログラミングなしで複雑なタスクを実行できるようにすることです。これは、ロボット制御の分野での大きなブレークスルーです。その効率的なトレーニングプロセスも印象的です。

研究チームは、Hover(ヒューマノイド多機能コントローラー)と呼ばれる新しいニューラルネットワークの開発におけるエキサイティングな進歩を発表しました。このニューラルネットワークには150万のパラメーターがあり、ヒューマノイドロボットの動きと動作を調整するために特別に設計されています。

「すべての基本モデルが巨大である必要はありません。1.5Mパラメーターニューラルネットワークは、ヒューマノイドロボットの本体を制御するように設計されています。」面倒なプログラミングなしで複雑なタスクを実行するロボット。彼は、「人間には、歩行、バランスを維持し、手足を柔軟に操作するときに、多くの潜在意識処理が必要です」と述べました。

トレーニングプロセス中、ホバーはNVIDIAのISAACシミュレーションプラットフォームを使用しました。これにより、物理シミュレーションはリアルタイムの10,000倍の速度で加速できます。

ジムファンは、このモデルが1年間仮想環境でトレーニングされており、実際には1つのGPUで行われる約50分間のリアルタイムしかかからないことを明らかにしました。彼は、この効率的なトレーニングにより、ニューラルネットワークを微調整せずに実際のアプリケーションにスムーズに転送できると述べました。

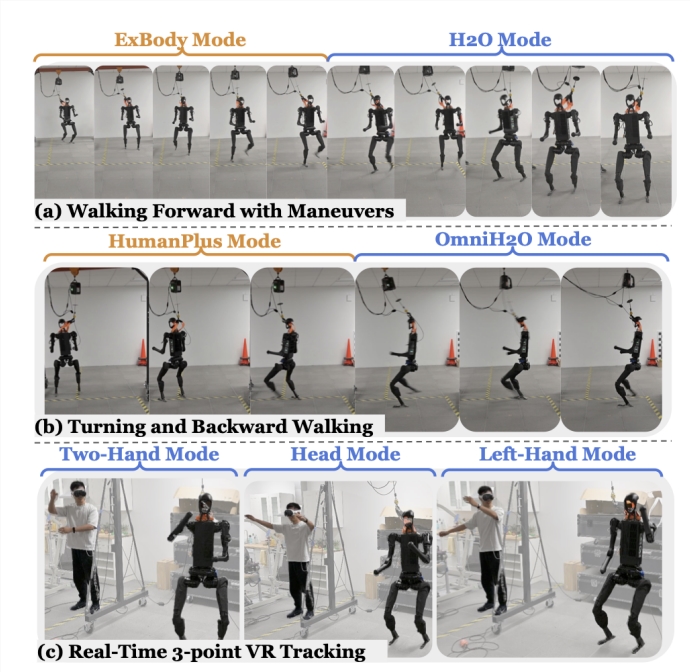

Hoverには、AppleのVision ProなどのXRデバイスを使用したヘッドおよびハンドポスチャーの制御、モーションキャプチャやRGBカメラ、さらにはExoskeletonsからのジョイントを介して全身姿勢を取得するなど、さまざまな高レベルのモーション命令に応答する能力があります。 。ファンは、Hoverが異なる入力デバイスを制御するロボットに統一されたインターフェイスを提供し、それによりトレーニング用のリモート運用データの収集を促進することを強調しました。

さらに、ホバーは上流の視覚言語アクションモデルと統合されており、モーション命令を高周波で低レベルのモーター信号に変換できるようにします。このモデルは、ISAACでシミュレートできるヒューマノイドロボットと互換性があり、ユーザーがロボットの寿命を簡単に提供できるようにします。

今年初めに、Nvidiaはヒューマノイドロボット向けに設計された汎用モデルであるGR00Tと呼ばれるプロジェクトも発表しました。 GR00T(Generalist Robot00Technology)パワーロボットは、アクションを観察することで自然言語を理解し、人間の動きを模倣し、現実世界で効果的に対話するために必要な調整、柔軟性、およびその他のスキルを迅速に学ぶことができます。

Paper URL:https://arxiv.org/pdf/2410.21229

キーポイント:

-NVIDIAは、ヒューマノイドロボットの動きと動作を制御するために設計された150万のパラメーターニューラルネットワークであるHoverを起動します。

- ⏳ホバーは仮想環境で1年間トレーニングし、実際のトレーニング時間はわずか50分で、実際のアプリケーションの効率が向上しました。

-Hoverは、さまざまな高レベルのモーション命令をサポートし、さまざまな入力デバイスと共同で動作し、ロボット制御用の統一インターフェイスを提供します。

ホバーの出現は、ヒューマノイドロボットの制御技術と多機能制御機能の主要な跳躍を示しています。 このテクノロジーが将来、よりエキサイティングなアプリケーションと革新をもたらすことを楽しみにしています。