最近、VITA-MLLMチームは、特にマルチモーダル相互作用のリアルタイムと精度で、VITA-1.0に基づいて完全にアップグレードされました。 VITA-1.5は、英語と中国語の2つの言語をサポートするだけでなく、複数のパフォーマンスインジケーターで定性的な飛躍を達成し、ユーザーがよりスムーズで効率的なインタラクティブエクスペリエンスをもたらします。

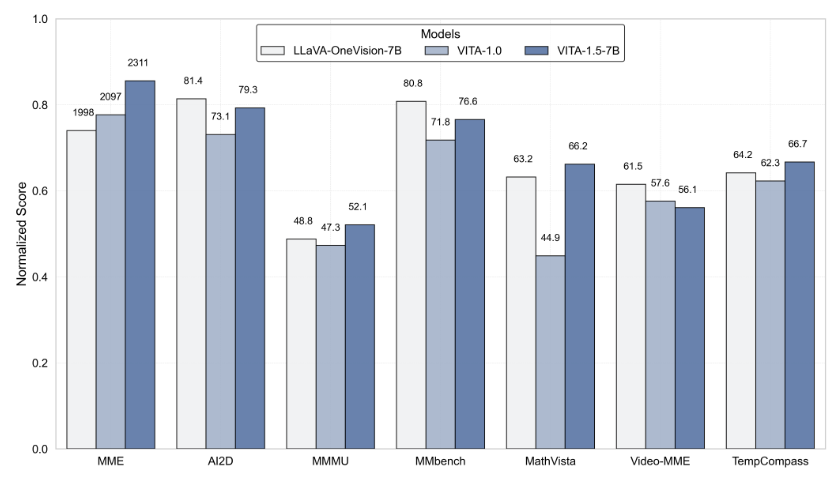

VITA-1.5は、相互作用の遅延で大きなブレークスルーを行い、元の4秒の遅延をわずか1.5秒に短縮しました。この改善により、ユーザーは音声相互作用中にほとんど遅延を延ばすことができなくなり、ユーザーエクスペリエンスが大幅に向上します。さらに、VITA-1.5は、MME、MMBench、Mathvistaなどの複数のベンチマークテストの後、マルチモーダルパフォーマンスも大幅に改善されました。

音声処理に関しては、VITA-1.5も深く最適化されています。自動音声認識(ASR)システムのエラー率は18.4から7.5に低下し、音声コマンドの理解と応答の精度が大幅に向上しました。同時に、VITA-1.5は新しいエンドツーエンドのテキストからスピーチ(TTS)モジュールを導入します。これは、入力として大規模な言語モデル(LLMS)から埋め込みを直接受信し、音声統合の自然性と一貫性を大幅に改善することができます。 。

マルチモーダル機能のバランスを確保するために、VITA-1.5は進歩的なトレーニング戦略を採用します。これにより、新たに追加された音声処理モジュールが視覚言語のパフォーマンスに与える影響を最小限に抑え、画像理解パフォーマンスは71.3から70.8にわずかに減少しました。これらの技術革新を通じて、VITA-1.5はリアルタイムの視覚と音声の相互作用の境界をさらに促進し、将来のインテリジェントな相互作用アプリケーションの強固な基盤を築きます。

開発者にとって、VITA-1.5は非常に便利です。開発者は、シンプルなコマンドライン操作をすぐに開始でき、チームはユーザーがシステムをよりよく理解して使用できるように、基本的でリアルタイムのインタラクティブなデモを提供します。リアルタイムインタラクティブエクスペリエンスをさらに改善するために、ユーザーは音声アクティビティ検出(VAD)モジュールなどの必要なモジュールを準備する必要があります。さらに、VITA-1.5のコードは完全にオープンソースになり、開発者が参加して貢献し、この技術の進歩を共同で促進することができます。

VITA-1.5の発売は、インタラクティブなマルチモーダル大手言語モデルの分野におけるもう1つの重要なマイルストーンであり、技術革新とユーザーエクスペリエンスにおけるVITA-MLLMチームの絶え間ない追求を示しています。このバージョンのリリースは、ユーザーがよりインテリジェントなインタラクティブなエクスペリエンスをもたらすだけでなく、マルチモーダルテクノロジーの将来の開発の方向性を指摘しています。

プロジェクトの入り口:https://github.com/vita-mllm/vita?tab=readme-ov-file

キーポイント:

VITA-1.5は、相互作用の遅延を大幅に削減し、4秒から1.5秒に短縮し、ユーザーエクスペリエンスを大幅に改善します。

マルチモーダルのパフォーマンスが向上し、複数のベンチマークの平均パフォーマンスが59.8から70.8に増加しました。

音声処理機能が強化され、ASRエラー率が18.4から7.5に低下し、音声認識がより正確になります。