다운코드 편집자는 Google ReCapture 기술과 이 파괴적인 기술이 비디오 편집을 어떻게 변화시킬 것인지 이해하도록 안내합니다! ReCapture를 사용하면 일반 사용자가 전문가 수준의 카메라 동작 조정을 쉽게 실현하고 비디오 렌즈 언어를 재설계하며 비디오 후반 작업에 혁신적인 변화를 가져올 수 있습니다. 이 기술은 더 이상 전통적인 4D 중간 표현 방법에 의존하지 않고 생성 비디오 모델의 모션 지식을 교묘하게 활용하여 비디오 편집을 비디오-비디오 변환 프로세스로 전환하여 작업 프로세스를 크게 단순화하고 비디오의 세부 사항을 유지합니다. 그리고 화질.

Google 연구팀이 출시한 최신 ReCapture 기술은 기존의 동영상 편집 방식을 뒤바꾸고 있습니다. 이러한 혁신을 통해 일반 사용자는 쉽게 전문가 수준의 카메라 움직임 조정을 구현하고 이미 캡처한 비디오에 대한 렌즈 언어를 재설계할 수 있습니다.

기존 비디오 후반 작업에서는 캡처된 비디오의 카메라 각도를 변경하는 것이 항상 기술적인 문제였습니다. 기존 솔루션이 다양한 유형의 비디오 콘텐츠를 처리할 때 복잡한 카메라 움직임 효과와 사진 디테일을 동시에 유지하기 어려운 경우가 많습니다. ReCapture는 다른 접근 방식을 취하며 기존의 4D 중간 표현 방법을 사용하지 않고 생성 비디오 모델에 저장된 모션 지식을 교묘하게 사용하고 Stable Video Diffusion을 통해 작업을 비디오-비디오 변환 프로세스로 재정의합니다.

시스템은 2단계 작업 흐름을 사용합니다. 첫 번째 단계에서는 새 카메라 위치의 초기 출력 버전인 앵커 비디오를 생성합니다. 이 단계는 CAT3D와 같은 확산 모델을 통해 다중 각도 비디오를 생성하거나 프레임별 깊이 추정 및 포인트 클라우드 렌더링을 통해 달성할 수 있습니다. 이 버전에는 타이밍 불일치와 시각적 결함이 있을 수 있지만 2단계의 기반을 마련했습니다.

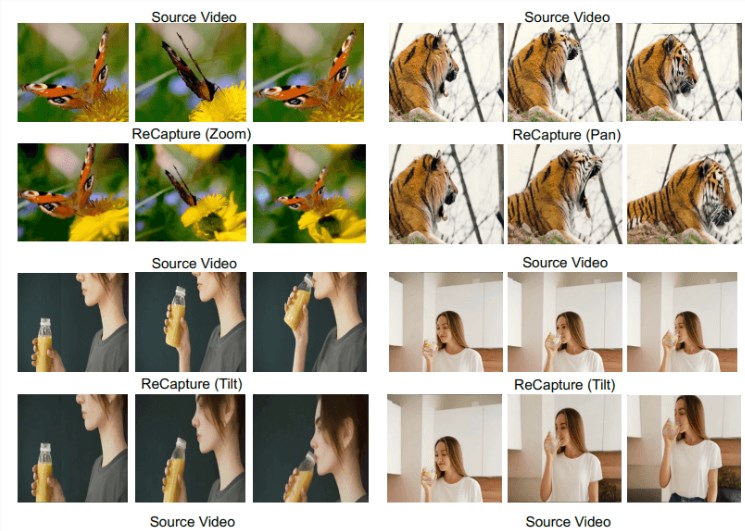

두 번째 단계에서는 마스크된 비디오 미세 조정을 적용하고 기존 영상에 대해 훈련된 생성 비디오 모델을 활용하여 사실적인 모션 효과와 타이밍 변경을 만듭니다. 시스템은 전체 모델을 재교육하지 않고도 앵커 비디오의 특정 동적 특성을 이해하고 복제할 수 있도록 모델을 최적화하기 위해 임시 LoRA(Low Rank Adaptation) 레이어를 도입합니다. 동시에 공간 LoRA 레이어는 사진 세부 정보와 콘텐츠가 새로운 카메라 움직임과 일치하도록 보장합니다. 이를 통해 생성 비디오 모델은 원본 비디오의 특징적인 모션을 유지하면서 확대/축소, 패닝, 틸팅과 같은 작업을 완료할 수 있습니다.

ReCapture는 사용자 친화적인 비디오 처리 분야에서 중요한 진전을 이루었지만 아직 연구 단계에 있으며 상용 적용과는 거리가 멀습니다. Google에는 많은 비디오 AI 프로젝트가 있지만 아직 시장에 출시되지 않았다는 점은 주목할 가치가 있습니다. 그 중 Veo 프로젝트는 상업적 용도에 가장 가깝습니다. 마찬가지로 메타가 최근 출시한 무비젠(Movie-Gen) 모델과 올해 초 출시된 오픈AI의 소라(Sora)도 아직 상용화되지 않았다. 현재 영상 AI 시장은 지난해 여름 최신 Gen-3Alpha 모델을 출시한 Runway 등 스타트업이 주도하고 있다.

ReCapture 기술의 등장은 영상 편집 분야의 미래 발전 방향을 제시합니다. 비록 아직 연구 단계이지만, ReCapture 기술의 강력한 기능과 편리한 작동 방법은 의심할 여지 없이 영상 제작에 더 많은 가능성을 가져다줄 것입니다. 우리는 앞으로 이 기술이 조기에 성숙되고 상업적으로 적용되어 대다수 사용자에게 보다 편리하고 효율적인 비디오 편집 경험을 제공할 수 있기를 기대합니다.