상하이 인공 지능 연구소는 2024년 7월 4일 WAIC 사이언스 프론티어 메인 포럼에서 Scholar Puyu 시리즈 모델 InternLM2.5의 최신 버전을 출시했습니다. 이 버전의 복잡한 시나리오에서의 추론 능력은 크게 향상되었으며, 1M의 초장문맥락을 지원하고, 인터넷 검색과 정보 통합을 독립적으로 수행할 수 있다는 점은 획기적인 발전입니다. 다운코드 편집자가 InternLM2.5의 기능과 오픈소스 정보를 자세히 설명합니다.

상하이 인공 지능 연구소는 2024년 7월 4일 WAIC Science Frontier 메인 포럼에서 Scholar Puyu 시리즈 모델 InternLM2.5의 새 버전을 출시했습니다. 이 버전의 복잡한 시나리오에 대한 추론 능력은 전반적으로 향상되었으며, 1M의 초장문맥락을 지원하고, 독립적으로 인터넷 검색을 수행하고 수백 개의 웹페이지 정보를 통합할 수 있습니다.

InternLM2.5는 다양한 애플리케이션 시나리오와 개발자 요구 사항에 맞게 모델의 세 가지 매개 변수 버전, 즉 1.8B, 7B 및 20B를 출시했습니다. 1.8B 버전은 초경량 모델인 반면, 20B 버전은 더욱 강력하고 포괄적인 성능을 제공하며 보다 복잡한 실제 시나리오를 지원합니다. 해당 모델은 모두 오픈소스로, Scholar·Puyu 시리즈 대형모델 홈페이지, ModelScope 홈페이지, Hugging Face 홈페이지에서 만나보실 수 있습니다.

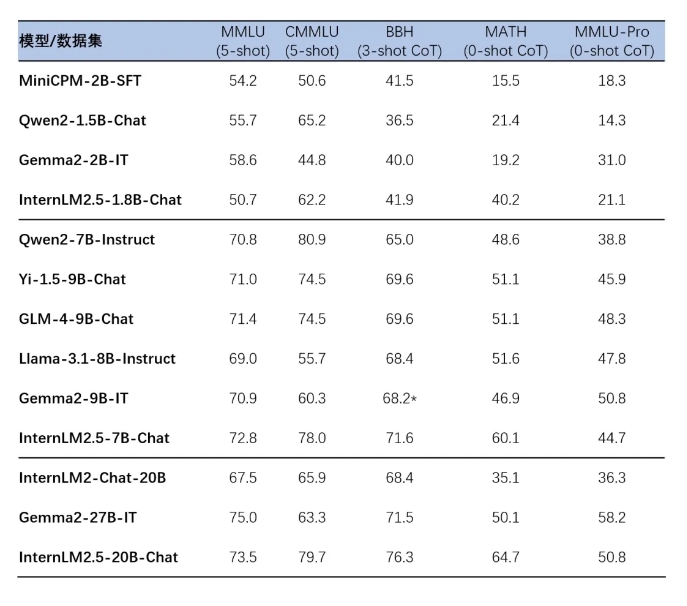

InternLM2.5는 다중 데이터 합성 기술을 반복하여 모델의 추론 능력을 크게 향상시켰습니다. 특히 수학 평가 세트 MATH의 정확도는 64.7%에 달했습니다. 또한, 모델은 사전 훈련 단계에서 효율적인 훈련을 통해 컨텍스트 길이 처리 능력을 향상시킵니다.

InternLM2.5 시리즈 모델은 또한 Shanghai Artificial Intelligence Laboratory에서 독립적으로 개발한 XTuner 미세 조정 프레임워크 및 LMDeploy 추론 프레임워크는 물론 광범위한 사용자 기반을 갖춘 기타 프레임워크를 포함한 다운스트림 추론 및 미세 조정 프레임워크와 원활하게 통합됩니다. vLLM, Ollama 및 llama.cpp와 같은 커뮤니티. Moda 커뮤니티에서 출시한 SWIFT 도구는 InternLM2.5 시리즈 모델의 추론, 미세 조정 및 배포도 지원합니다.

이러한 모델의 적용 경험에는 다단계 복잡한 추론, 다단계 대화 의도에 대한 정확한 이해, 유연한 형식 제어 작업 및 복잡한 지침을 따르는 능력이 포함됩니다. 개발자가 빠르게 시작할 수 있도록 자세한 설치 및 사용 가이드가 제공됩니다.

학자·푸유 시리즈 대형 모델 홈페이지:

https://internlm.intern-ai.org.cn

ModelScope 홈 페이지:

https://www.modelscope.cn/organization/Shanghai_AI_Laboratory?tab=model

포옹 얼굴 홈 페이지:

https://huggingface.co/internlm

InternLM2.5 오픈 소스 링크:

https://github.com/InternLM/InternLM

InternLM2.5의 오픈 소스 릴리스는 인공 지능 분야의 연구 및 응용에 새로운 가능성을 제공합니다. InternLM2.5의 강력한 성능과 사용 용이성은 많은 개발자가 탐색하고 혁신하도록 유도할 것으로 믿어집니다. Downcodes 편집자는 InternLM2.5를 기반으로 한 더욱 뛰어난 애플리케이션을 기대합니다!